Musk investiert satte 4 Milliarden US-Dollar in 100.000 H100-Chips, um xAIs Grok3 zu trainieren! Der „Iron Man“ der Technologiebranche, der bereits in der Raketen- und Elektromobilität Erfolge feiert, sorgt nun auch im Bereich der KI für Aufsehen.

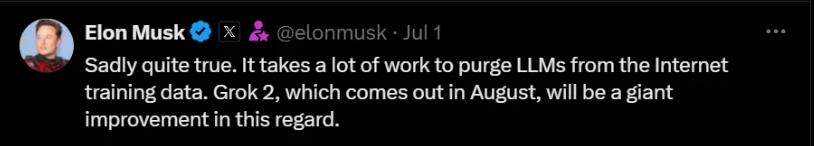

Musk bewarb xAI in zwei aufeinanderfolgenden Tweets und kündigte die Veröffentlichung von Grok2 im August und Grok3 Ende des Jahres an, trainiert auf 100.000 H100-Chips. Dies ist ein innovatives Datentraining mit enormer Rechenleistung, das direkt auf OpenAIs GPT abzielt und ein neues großes Sprachmodell schaffen soll.

Seit der Veröffentlichung von Grok1.5 wirbt Musk unermüdlich für xAI, sein KI-Startup. Grok ist Musks Einstieg in den Bereich der generativen KI und ein KI-Chatbot, der von xAI, einem Startup, das mit Giganten wie OpenAI, Google und Meta konkurriert, entwickelt wird. xAI setzt auf Open Source und baut eigene Supercomputer-Zentren – ein klares Zeichen für große Ambitionen.

Seit März dieses Jahres hat xAI nacheinander das große Sprachmodell Grok1.5 und das erste multimodale Modell Grok1.5 Vision veröffentlicht. xAI erklärte, dass Grok1.5V in verschiedenen Bereichen wie wissenschaftlichem Schlussfolgern, Dokumentenverständnis, wissenschaftlichen Diagrammen und Tabellenverarbeitung „mit den aktuell führenden multimodalen Modellen mithalten kann“.

Musk sagte im Mai, dass xAI ein junges Unternehmen sei und Grok noch viel Vorarbeit leisten müsse, um mit Google Deepmind und OpenAI konkurrieren zu können. Aber xAI arbeitet intensiv an der Modellleistung und will den großen Unternehmen Druck machen.

Nun kündigte Musk die Veröffentlichung von Grok2 im August an – ein großer Fortschritt im Bereich des Datentrainings, der möglicherweise das Problem des „Körper-auf-Körper-Effekts“ (gemeint ist die Tendenz, gleiche Ergebnisse zu produzieren) lösen könnte. Das sind gute Nachrichten für Nutzer großer Sprachmodelle.

Musk enthüllte außerdem, dass Grok3 Ende des Jahres erscheinen wird und nach dem Training auf 100.000 Nvidia H100 GPUs zu etwas „Besonderem“ werden soll. Dieser Auftrag hat einen Wert von 3 bis 4 Milliarden US-Dollar und zeigt Musks Engagement und Investitionen im Bereich der KI.

Die Einsatzmöglichkeiten von xAIs Grok2 und Grok3 werden mit Spannung erwartet, und die Nutzer sind gespannt auf das Ergebnis des Trainings mit 100.000 H100-Chips. Obwohl andere Technologiekonzerne wie Meta ebenfalls mehr GPUs kaufen, unterstreicht der Schritt von xAI seine Ambitionen im KI-Bereich deutlich.

Zusätzlich überwacht Musk persönlich das xAI-Rechenzentrum und setzt auf Flüssigkühlung, um dem sprunghaften Anstieg des Rechenbedarfs der KI gerecht zu werden. Flüssigkühlung bietet eine hohe Kühlleistung, ist energieeffizient und stabil und hat sich als bevorzugte Lösung für KI-Rechenzentren etabliert.