Das israelische KI-Startup aiOla hat kürzlich mit der Einführung seines neuen Open-Source-Spracherkennungsmodells Whisper-Medusa für Aufsehen gesorgt.

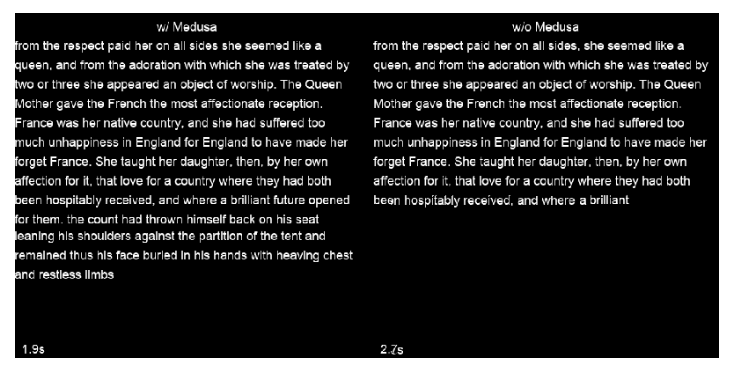

Dieses Modell ist nicht zu unterschätzen: Es ist ganze 50 % schneller als OpenAIs berühmtes Whisper! Es basiert auf Whisper, verwendet aber eine neuartige „Multi-Head-Attention“-Architektur, die deutlich mehr Tokens gleichzeitig vorhersagen kann als das OpenAI-Produkt. Der Code und die Gewichte wurden unter der MIT-Lizenz auf Hugging Face veröffentlicht und stehen somit für Forschungs- und kommerzielle Zwecke zur Verfügung.

Gill Hetz, Vizepräsident für Forschung bei aiOla, erklärte, dass Open Source die Zusammenarbeit und Innovation in der Community fördern und zu schnelleren und besseren Ergebnissen führen wird. Diese Arbeit ebnet den Weg für komplexe KI-Systeme, die Benutzerfragen nahezu in Echtzeit verstehen und beantworten können.

In einer Zeit, in der große Sprachmodelle eine Vielzahl von Inhalten generieren können, ist eine hochentwickelte Spracherkennung unerlässlich. Whisper beispielsweise, das verschiedene Sprachen und Akzente verarbeiten kann, verzeichnet über 5 Millionen Downloads pro Monat und dient als Goldstandard für viele Anwendungen.

Was macht aiOla's Whisper-Medusa also so besonders?

Das Unternehmen hat die Architektur von Whisper modifiziert und einen Multi-Head-Attention-Mechanismus hinzugefügt, der 10 Tokens gleichzeitig vorhersagen kann. Dies führt zu einer 50%igen Geschwindigkeitssteigerung ohne Einbußen bei der Genauigkeit. Das Modell wurde mit einer schwach überwachten Methode des maschinellen Lernens trainiert und zukünftige Versionen werden noch leistungsfähiger sein. Wichtig ist, dass die Geschwindigkeitsverbesserung bei Whisper-Medusa nicht auf Kosten der Leistung geht, da das Grundgerüst auf Whisper basiert.

Auf die Frage, ob Unternehmen Whisper-Medusa bereits im Vorfeld erhalten hätten, antwortete Hetz, dass das Modell in realen Unternehmensdaten-Szenarien getestet wurde und dort präzise funktioniert. Es soll die Reaktionszeiten von Sprach-Anwendungen verbessern. Letztendlich ist er überzeugt, dass die verbesserte Erkennungs- und Transkriptionsgeschwindigkeit die Bearbeitungszeit von Sprach-Anwendungen verkürzt und den Weg für Echtzeit-Antworten ebnet.

Highlights:

💥50% schneller: aiOlas Whisper-Medusa ist deutlich schneller als OpenAIs Whisper Spracherkennung.

🎯Genauigkeit unbeeinträchtigt: Die Geschwindigkeitssteigerung geht nicht zu Lasten der Genauigkeit.

📈Vielversprechende Anwendungsmöglichkeiten: Schnellere Reaktionszeiten, höhere Effizienz und niedrigere Kosten in Sprach-Anwendungen.