Kürzlich gab Google bekannt, eine neue Funktion in seinen Suchergebnissen einzuführen, die Nutzern helfen soll, das Erstellen und Bearbeiten von Inhalten besser zu verstehen. Diese Maßnahme erfolgt im Anschluss an Googles Beitritt zur „Content Authenticity Initiative“ (C2PA), einem Bündnis, dem große Marken wie Amazon, Adobe und Microsoft angehören und das sich der Bekämpfung von Falschinformationen im Internet verschrieben hat.

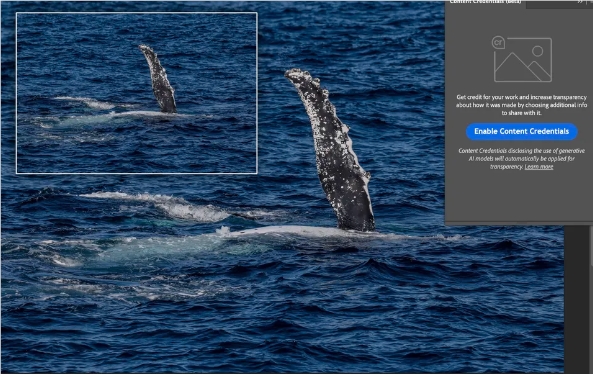

Google erklärte, dass diese neue Funktion in den kommenden Monaten schrittweise eingeführt wird. Sie nutzt aktuelle Content-Credentials-Standards (d. h. Metadaten von Bildern), um in der Suche AI-generierte oder -bearbeitete Bilder zu kennzeichnen und so die Transparenz für die Nutzer zu erhöhen.

Nutzer können durch Anklicken der drei Punkte über einem Bild die Option „Über dieses Bild“ auswählen, um zu überprüfen, ob es von KI generiert wurde. Diese Funktion wird auch über Google Lens und die „Circle to Search“-Funktion von Android bereitgestellt. Es ist jedoch zu beachten, dass dieses Label nicht sehr auffällig ist und die Nutzer zusätzliche Schritte unternehmen müssen, um die Herkunft eines Bildes zu bestätigen.

In den letzten Jahren haben sich mit der Entwicklung der KI-Technologie auch Probleme mit Deepfakes und KI-generierten Bildern verstärkt. So veröffentlichte beispielsweise Donald Trump ein gefälschtes Bild, das Taylor Swift als Unterstützerin seines Wahlkampfs zeigte, was zu vielen Missverständnissen und Kontroversen führte. Darüber hinaus war Taylor Swift Ziel von böswilligen, KI-generierten Bildern, was bei vielen Menschen Zweifel an der Authentizität von KI-Bildern aufkommen ließ.

Obwohl die Einführung dieser Funktion durch Google ein guter Anfang ist, bleiben Bedenken bestehen, ob dieses versteckte Label effektiv genug ist. Viele Nutzer wissen möglicherweise nicht von der Funktion „Über dieses Bild“ und können daher dieses neue Tool nicht optimal nutzen. Darüber hinaus unterstützen derzeit nur wenige Kameramodelle und einige Softwareprogramme die Content-Credentials-Funktion, was die Effektivität des Systems einschränkt.

Eine Studie der Universität Waterloo ergab, dass nur 61 % der Menschen in der Lage sind, KI-generierte Bilder von echten Bildern zu unterscheiden. Das bedeutet, dass Googles Kennzeichnungssystem, wenn es nicht effektiv genutzt wird, den Nutzern keine echte Transparenz bieten kann.

Wichtigste Punkte:

🌟 Google wird eine neue Funktion einführen, um KI-generierte und -bearbeitete Bilder zu kennzeichnen und die Transparenz für die Nutzer zu erhöhen.

🔍 Nutzer können über die Funktion „Über dieses Bild“ überprüfen, ob ein Bild von KI generiert wurde, aber das Label ist nicht sehr auffällig.

📉 Studien zeigen, dass nur 61 % der Menschen KI-Bilder von echten Bildern unterscheiden können. Google muss die Sichtbarkeit des Labels verbessern.