Forscher des Microsoft Research in Zusammenarbeit mit der University of Washington, der Stanford University, der University of Southern California, der University of California, Davis und der University of California, San Francisco, haben kürzlich LLaVA-Rad vorgestellt, ein neues kleines multimodales Modell (SMM), das die Effizienz der Erstellung von radiologischen Berichten in der Klinik verbessern soll. Die Einführung dieses Modells stellt nicht nur einen großen Fortschritt in der medizinischen Bildverarbeitung dar, sondern eröffnet auch neue Möglichkeiten für die klinische Anwendung der Radiologie.

Im biomedizinischen Bereich haben Studien auf der Basis großer Basismodelle vielversprechende Anwendungsmöglichkeiten gezeigt, insbesondere im Bereich der multimodalen KI, die Text und Bilder gleichzeitig verarbeiten kann und so Aufgaben wie visuelle Frage-Antwort-Systeme und die Erstellung radiologischer Berichte unterstützt. Es gibt jedoch weiterhin Herausforderungen, wie z. B. den hohen Ressourcenbedarf großer Modelle, der eine breite Implementierung im klinischen Umfeld erschwert. Kleine multimodale Modelle sind zwar effizienter, weisen aber im Vergleich zu großen Modellen immer noch erhebliche Leistungsunterschiede auf. Darüber hinaus behindern das Fehlen von Open-Source-Modellen und zuverlässigen Methoden zur Bewertung der Faktenrichtigkeit die klinische Anwendung.

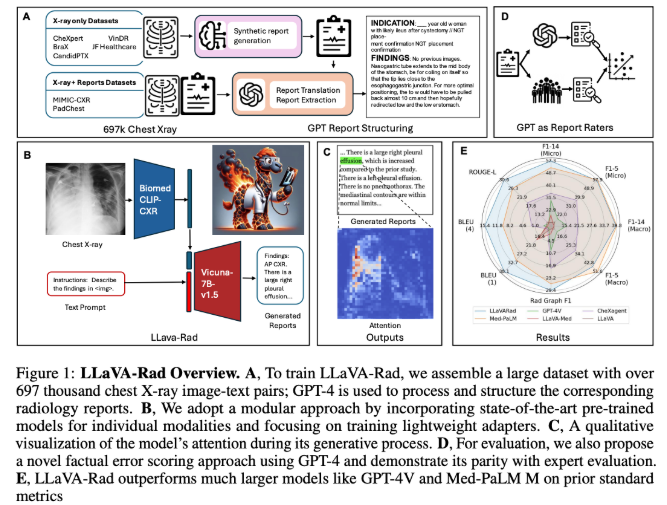

Das LLaVA-Rad-Modell wurde mit einem Datensatz von 697.435 Paaren aus radiologischen Bildern und Berichten aus sieben verschiedenen Quellen trainiert und konzentriert sich auf Röntgenaufnahmen des Brustkorbs (CXR), die häufigste Art der medizinischen Bildgebung. Das Modell wurde mit einer modularen Trainingsmethode entwickelt, die aus drei Phasen besteht: unimodales Pretraining, Alignment und Fine-Tuning. Es verwendet einen effizienten Adaptermechanismus, um nicht-textuelle Modalitäten in den Textebettungsraum einzubetten. Obwohl LLaVA-Rad kleiner ist als einige große Modelle wie Med-PaLM M, zeigt es eine überragende Leistung, insbesondere bei wichtigen Kennzahlen wie ROUGE-L und F1-RadGraph, mit einer Verbesserung von 12,1 % bzw. 10,1 % im Vergleich zu anderen ähnlichen Modellen.

Es ist erwähnenswert, dass LLaVA-Rad auf mehreren Datensätzen eine überragende Leistung gezeigt hat und auch bei Tests mit unbekannten Daten stabil geblieben ist. Dies ist auf das modulare Design und die effiziente Datenverarbeitungsarchitektur zurückzuführen. Darüber hinaus hat das Forschungsteam CheXprompt vorgestellt, eine Metrik zur automatischen Bewertung der Faktenrichtigkeit, die die Bewertungsprobleme in der klinischen Anwendung weiter angeht.

Die Veröffentlichung von LLaVA-Rad ist ein großer Schritt zur Förderung der Anwendung von Basismodellen im klinischen Umfeld und bietet eine leichte und effiziente Lösung für die Erstellung radiologischer Berichte. Sie markiert eine weitere Annäherung von Technologie und klinischen Bedürfnissen.

Projekt-Adresse: https://github.com/microsoft/LLaVA-Med

Wichtigste Punkte:

🌟 LLaVA-Rad ist ein kleines multimodales Modell von Microsoft Research, das sich auf die Erstellung radiologischer Berichte konzentriert.

💻 Das Modell wurde mit 697.435 Paaren von Röntgenaufnahmen des Brustkorbs und Berichten trainiert und erreicht eine effiziente und überragende Leistung.

🔍 CheXprompt ist eine begleitend entwickelte Metrik zur automatischen Bewertung, die hilft, Bewertungsprobleme in der klinischen Anwendung zu lösen.