Das Alibaba Tongyi-Labor gab kürzlich die Open-Source-Veröffentlichung seines neuesten Forschungsergebnisses bekannt – ViDoRAG, ein speziell für das Verständnis visueller Dokumente entwickeltes Retrieval Augmented Generation (RAG) System. Tests von ViDoRAG auf dem GPT-4o-Modell zeigten eine bemerkenswerte Genauigkeit von 79,4 %, eine Steigerung von über 10 % gegenüber herkömmlichen RAG-Systemen. Dieser Durchbruch markiert einen wichtigen Schritt im Bereich der visuellen Dokumentenverarbeitung und eröffnet neue Möglichkeiten für den Einsatz von künstlicher Intelligenz beim Verständnis komplexer Dokumente.

Multi-Agenten-Framework ermöglicht das Verständnis visueller Dokumente

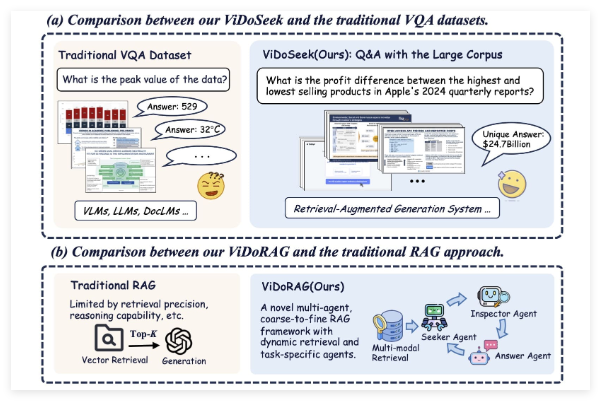

ViDoRAG ist kein herkömmliches Einzelmodell, sondern basiert auf einem innovativen Multi-Agenten-Framework. Das System kombiniert dynamische iterative Inferenzagenten (Dynamic Iterative Reasoning Agents) und eine auf dem GMM (Gauß-Gemisch-Modell) basierende hybride Retrieval-Technik. Dieser Ansatz ermöglicht es ViDoRAG, bei der Verarbeitung von visuellen Dokumenten mit Bildern und Texten, wichtige Informationen präziser zu extrahieren und zu erschließen. Im Gegensatz zu herkömmlichen RAG-Systemen, die auf die textbasierte Suche beschränkt sind, verbessert ViDoRAG die Leistung durch die Fusion multimodaler Daten deutlich.

Das Tongyi-Labor beschreibt in seiner veröffentlichten Arbeit und im Code-Repository detailliert die Funktionsweise von ViDoRAG. Der Kern liegt in der Zusammenarbeit mehrerer Agenten, die den Retrieval- und Generierungsprozess dynamisch anpassen, um in komplexen Szenarien „Halluzinationen“ (d. h. ungenaue oder frei erfundene Inhalte des Modells) zu reduzieren und die Zuverlässigkeit und Kontextrelevanz der Antworten zu verbessern.

Leistungssteigerung: Genauigkeit um über 10 % verbessert

Das System erreicht auf GPT-4o eine Genauigkeit von 79,4 %. Diese Zahl zeigt nicht nur die hervorragende Leistung, sondern ermöglicht auch einen Vergleich mit herkömmlichen RAG-Systemen. Herkömmliche RAG-Systeme zeigen zwar bei der Textgenerierung eine gute Leistung, sind aber bei der Verarbeitung visueller Dokumente oft durch die einmodale Retrievalfähigkeit eingeschränkt und erreichen meist eine geringere Genauigkeit. Durch die Integration von visuellen und textbasierten Informationen verbessert ViDoRAG die Genauigkeit um über 10 Prozentpunkte. Dieser Fortschritt ist für Anwendungen mit hohen Anforderungen an die Genauigkeit des Dokumentenverständnisses, wie z. B. die Analyse von Rechtsdokumenten, die Interpretation von medizinischen Berichten und die Verarbeitung von Unternehmensdaten, von großer Bedeutung.

Die Open-Source-Veröffentlichung von ViDoRAG durch das Alibaba Tongyi-Labor hat auf Twitter für viel Diskussion gesorgt. Nutzer sehen in der Veröffentlichung nicht nur einen Beweis für die technologische Stärke von Alibaba im Bereich KI, sondern auch eine wertvolle Ressource für Entwickler und Forscher weltweit. Durch die Veröffentlichung der Arbeit und des Codes (die entsprechenden Links wurden im Twitter-Post geteilt) dürfte ViDoRAG die Forschung und Anwendung der RAG-Technologie für visuelle Dokumente beschleunigen und die Weiterentwicklung multimodaler KI-Systeme fördern.

Die Veröffentlichung und Open-Source-Verfügbarkeit von ViDoRAG eröffnet der RAG-Technologie zweifellos neue Wege. Angesichts des steigenden Bedarfs an der Verarbeitung visueller Dokumente ist ViDoRAG möglicherweise nur der Anfang, und in Zukunft werden wir wahrscheinlich weitere ähnliche innovative Systeme erleben.