En el campo de la inteligencia artificial, la potencia de cálculo y el tiempo siempre han sido factores clave que limitan el progreso tecnológico. Sin embargo, los últimos resultados de investigación del equipo de DeepMind ofrecen una solución a este problema.

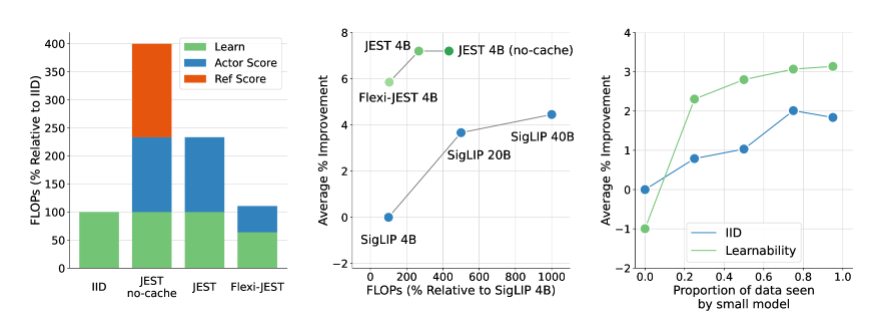

Han propuesto un nuevo método de selección de datos llamado JEST, que mediante la selección inteligente de los mejores lotes de datos para el entrenamiento, logra una reducción significativa del tiempo de entrenamiento de la IA y de las necesidades de potencia de cálculo. Se afirma que puede reducir el tiempo de entrenamiento de la IA en 13 veces y reducir las necesidades de potencia de cálculo en un 90%.

El núcleo del método JEST radica en la selección conjunta de los mejores lotes de datos, en lugar de muestras individuales. Esta estrategia ha demostrado ser especialmente eficaz para acelerar el aprendizaje multimodal. En comparación con los métodos tradicionales de selección de datos de preentrenamiento a gran escala, JEST no solo reduce drásticamente el número de iteraciones y el número de operaciones de punto flotante, sino que también supera el estado del arte anterior utilizando solo el 10% del presupuesto de FLOP.

La investigación del equipo de DeepMind revela tres conclusiones clave: seleccionar buenos lotes de datos es más eficaz que seleccionar puntos de datos individualmente; la aproximación de modelos online se puede utilizar para filtrar datos de forma más eficiente; y se pueden guiar conjuntos de datos pequeños y de alta calidad para aprovechar conjuntos de datos más grandes no seleccionados. Estos hallazgos proporcionan una base teórica para el alto rendimiento del método JEST.

El funcionamiento de JEST se basa en la investigación previa sobre la pérdida RHO, combinando la pérdida del modelo de aprendizaje y el modelo de referencia preentrenado para evaluar la capacidad de aprendizaje de los puntos de datos. Selecciona aquellos puntos de datos que son más fáciles para el modelo preentrenado, pero más difíciles para el modelo de aprendizaje actual, con el fin de mejorar la eficiencia y los resultados del entrenamiento.

Además, JEST utiliza un método iterativo basado en el muestreo de Gibbs bloqueado para construir lotes gradualmente. En cada iteración, se selecciona un nuevo subconjunto de muestras según la puntuación de capacidad de aprendizaje condicional. Este método mejora continuamente al filtrar más datos, incluyendo el uso de un modelo de referencia preentrenado únicamente para puntuar los datos.

Esta investigación de DeepMind no solo aporta un avance revolucionario al campo del entrenamiento de IA, sino que también ofrece nuevas ideas y métodos para el futuro desarrollo de la tecnología de IA. Con la optimización y aplicación adicionales del método JEST, tenemos razones para creer que el desarrollo de la inteligencia artificial tendrá un futuro aún más prometedor.

Artículo:https://arxiv.org/abs/2406.17711

Puntos clave:

🚀 **Revolución en la eficiencia del entrenamiento**: El método JEST de DeepMind reduce el tiempo de entrenamiento de la IA en 13 veces y las necesidades de potencia de cálculo en un 90%.

🔍 **Selección de lotes de datos**: JEST mejora significativamente la eficiencia del aprendizaje multimodal mediante la selección conjunta de los mejores lotes de datos, en lugar de muestras individuales.

🛠️ **Método de entrenamiento innovador**: JEST utiliza la aproximación de modelos online y la guía de conjuntos de datos de alta calidad para optimizar la distribución de datos de preentrenamiento a gran escala y la capacidad de generalización del modelo.