El equipo de modelos grandes de ByteDance ha vuelto a lograr un gran éxito: su modelo Depth Anything V2 ha sido incluido en la biblioteca Core ML de Apple. Este logro no solo representa un avance tecnológico significativo, sino que también destaca el hecho de que el líder del proyecto es un estudiante en prácticas.

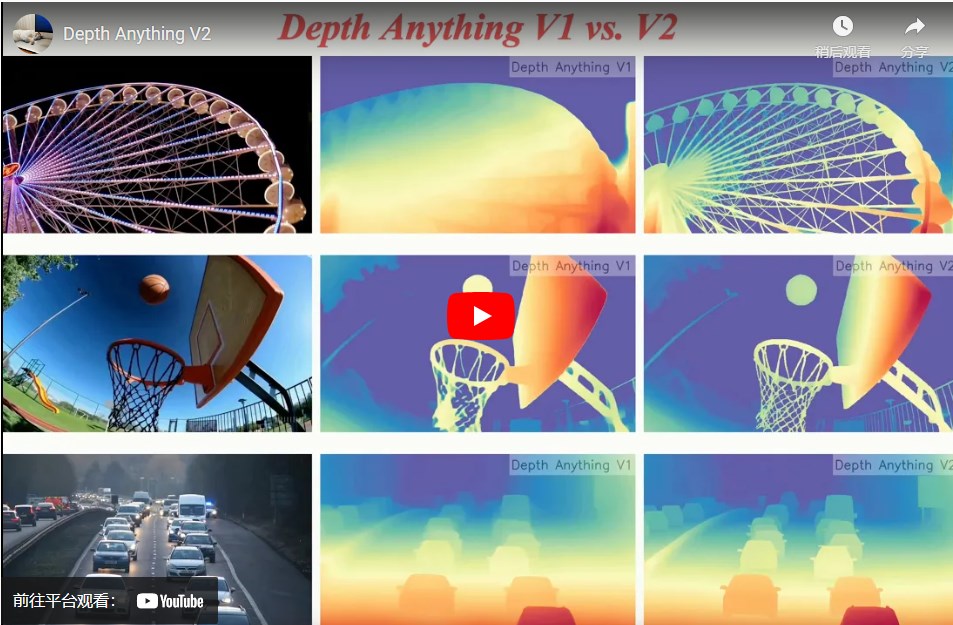

Depth Anything V2 es un modelo de estimación de profundidad monocular que puede calcular la información de profundidad de una escena a partir de una sola imagen. Desde su versión V1 de principios de 2024 hasta la actual V2, la cantidad de parámetros se ha expandido de 25M a 1.3B, cubriendo áreas de aplicación como efectos de video, conducción autónoma, modelado 3D y realidad aumentada.

Este modelo ha obtenido 8.7k estrellas en GitHub. La versión V2, recientemente lanzada, ya cuenta con 2.3k estrellas, mientras que la V1 acumuló 6.4k. Este éxito es motivo de orgullo para cualquier equipo técnico, especialmente considerando que la fuerza impulsora detrás del proyecto es un estudiante en prácticas.

La inclusión de Depth Anything V2 en la biblioteca Core ML de Apple es un gran reconocimiento al rendimiento del modelo y a sus perspectivas de aplicación. Core ML, el framework de aprendizaje automático de Apple, permite que los modelos de aprendizaje automático se ejecuten de manera eficiente en dispositivos iOS y macOS, incluso sin conexión a internet, permitiendo la ejecución de tareas de IA complejas.

La versión Core ML de Depth Anything V2 utiliza al menos un modelo de 25M, optimizado por HuggingFace, alcanzando una velocidad de inferencia de 31.1 milisegundos en un iPhone 12 Pro Max. Junto con otros modelos seleccionados como FastViT, ResNet50 y YOLOv3, cubre áreas que van desde el procesamiento del lenguaje natural hasta el reconocimiento de imágenes.

En la ola de los modelos grandes, el valor de las Leyes de Escalado (Scaling Laws) es cada vez más reconocido. El equipo de Depth Anything optó por construir un modelo base simple pero potente, logrando mejores resultados en una sola tarea. Creen que aplicar las Leyes de Escalado para resolver problemas fundamentales tiene un valor práctico mayor. La estimación de profundidad, una tarea importante en el campo de la visión por computadora, que infiere la distancia de los objetos en una escena a partir de imágenes, es crucial para aplicaciones como la conducción autónoma, el modelado 3D y la realidad aumentada. Depth Anything V2 no solo tiene un amplio potencial de aplicación en estas áreas, sino que también puede integrarse como middleware en plataformas de video o software de edición, para admitir la creación de efectos especiales y la edición de video. El autor principal del proyecto Depth Anything es un estudiante en prácticas del equipo, quien, bajo la guía de su mentor, completó la mayor parte del trabajo, desde la concepción del proyecto hasta la redacción del artículo, en menos de un año. La empresa y el equipo proporcionaron un entorno de investigación libre y apoyo total, animando a los estudiantes en prácticas a investigar problemas más difíciles y fundamentales.

El crecimiento de este estudiante en prácticas y el éxito de Depth Anything V2 no solo demuestran el esfuerzo y el talento individual, sino también la profunda exploración de ByteDance en el campo de la generación visual y los modelos grandes, así como su dedicación a la formación de talento.

Dirección del proyecto: https://top.aibase.com/tool/depth-anything-v2