Recientemente, varios académicos de diferentes instituciones han descubierto una nueva tecnología: las redes neuronales físicas (PNNs). No se trata de los algoritmos digitales que conocemos y que se ejecutan en computadoras, sino de una forma completamente nueva de computación inteligente basada en sistemas físicos.

Las PNNs, como su nombre indica, utilizan las propiedades de los sistemas físicos para realizar cálculos de redes neuronales. Aunque actualmente se encuentra en un nicho de investigación, podrían representar una de las oportunidades más subestimadas en la IA moderna.

Potencial de las PNNs: Modelos grandes, bajo consumo de energía y computación perimetral

Imagine que pudiéramos entrenar modelos de IA 1000 veces más grandes que los actuales y, además, realizar inferencias locales y privadas en dispositivos periféricos, como teléfonos inteligentes o sensores. Suena a ciencia ficción, pero las investigaciones indican que no es imposible.

Para lograr el entrenamiento a gran escala de las PNNs, los investigadores están explorando métodos basados en retropropagación y sin retropropagación. Estos métodos tienen sus ventajas y desventajas, y actualmente ninguno alcanza la misma escala y rendimiento que el algoritmo de retropropagación ampliamente utilizado en el aprendizaje profundo. Sin embargo, la situación está cambiando rápidamente, y un ecosistema diverso de técnicas de entrenamiento proporciona pistas para la utilización de las PNNs.

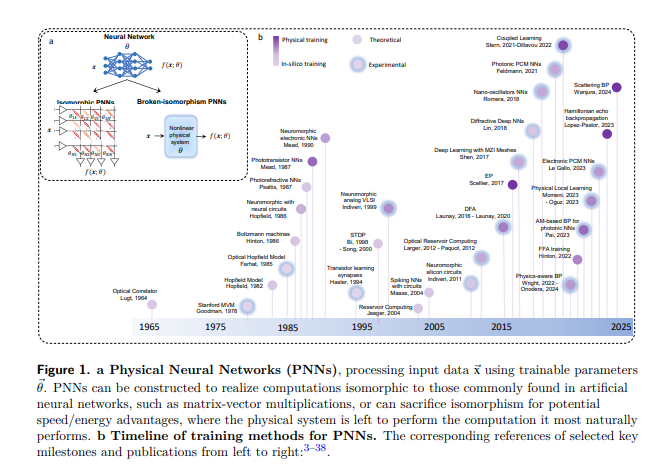

La implementación de las PNNs abarca múltiples campos, incluyendo la óptica, la electrónica y la computación neuromórfica. Pueden realizar cálculos como la multiplicación matriz-vector de forma similar a las estructuras de las redes neuronales digitales, o sacrificar esta similitud estructural para obtener una potencial ventaja en velocidad/energía, permitiendo que el sistema físico realice el cálculo de la forma más natural.

El futuro de las PNNs: Superando el rendimiento del hardware digital

Las futuras aplicaciones de las PNNs podrían ser muy amplias, desde grandes modelos generativos hasta tareas de clasificación en sensores inteligentes. Necesitarán ser entrenadas, pero las restricciones de entrenamiento pueden variar según la aplicación. El método de entrenamiento ideal sería independiente del modelo, rápido, energéticamente eficiente y robusto a las variaciones, la deriva y el ruido del hardware.

A pesar del gran potencial de las PNNs, también enfrentan desafíos. ¿Cómo asegurar la estabilidad de las PNNs durante el entrenamiento y la inferencia? ¿Cómo integrar estos sistemas físicos con la infraestructura de hardware y software digital existente? Estas son preguntas que necesitan respuesta.

Dirección del artículo: https://arxiv.org/pdf/2406.03372