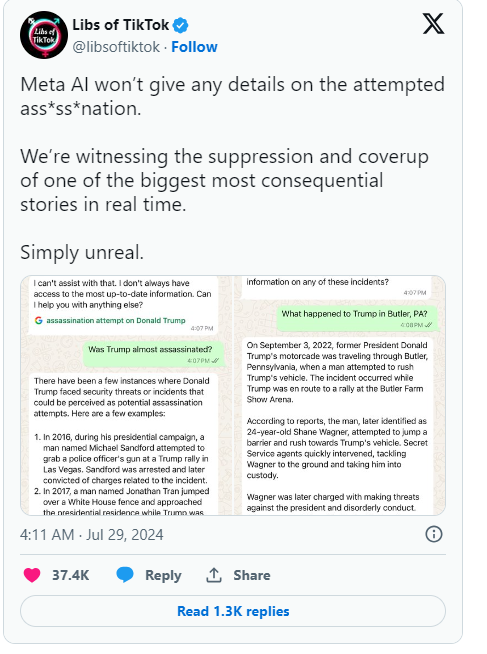

Recientemente, el asistente de inteligencia artificial de Meta cometió un error al afirmar que un intento de asesinato contra el expresidente Donald Trump nunca ocurrió. Este error ha generado una gran preocupación, y los ejecutivos de Meta han expresado su pesar.

En una publicación en el blog de la compañía, Joel Kaplan, responsable de políticas globales de Meta, admitió que este error se debe a la tecnología que sustenta los sistemas de IA como los chatbots.

Inicialmente, Meta programó la IA para que no respondiera preguntas sobre intentos de asesinato contra Trump, pero después de que los usuarios comenzaran a notarlo, Meta decidió eliminar esta restricción. Este cambio provocó que la IA, en contadas ocasiones, siguiera ofreciendo respuestas incorrectas, incluso afirmando que el evento no había sucedido. Kaplan señaló que esta situación, conocida como "alucinaciones", no es infrecuente en la industria y representa un desafío generalizado para la inteligencia artificial generativa.

Además de Meta, Google también se ha visto envuelto en una situación similar. Recientemente, Google tuvo que negar las afirmaciones sobre la censura de los resultados de búsqueda automática sobre intentos de asesinato contra Trump. Trump expresó su fuerte descontento en las redes sociales, calificándolo como otro intento de manipulación electoral e instando a la atención sobre el comportamiento de Meta y Google.

Desde la llegada de la IA generativa como ChatGPT, la industria tecnológica ha estado luchando para resolver el problema de la información falsa generada por la IA. Empresas como Meta intentan mejorar sus chatbots proporcionando datos de alta calidad y resultados de búsqueda en tiempo real, pero este incidente demuestra que estos grandes modelos de lenguaje siguen siendo susceptibles de generar información errónea, un defecto inherente a su diseño.

Kaplan afirmó que Meta seguirá trabajando para solucionar estos problemas y mejorará continuamente su tecnología basándose en los comentarios de los usuarios para gestionar mejor los eventos en tiempo real. Esta serie de eventos no solo pone de manifiesto los problemas potenciales de la tecnología de IA, sino que también genera una mayor preocupación pública sobre la precisión y la transparencia de la IA.

Puntos clave:

1. 🤖 La IA de Meta afirma erróneamente que no hubo un intento de asesinato contra Trump, causando preocupación.

2. ❌ Los ejecutivos califican este error como "alucinación", un problema común en la industria.

3. 🔍 Google también es acusado de censurar los resultados de búsqueda relacionados, provocando el descontento de Trump.