La empresa israelí de inteligencia artificial aiOla ha realizado un gran avance, anunciando el lanzamiento de un nuevo modelo de reconocimiento de voz de código abierto: Whisper-Medusa.

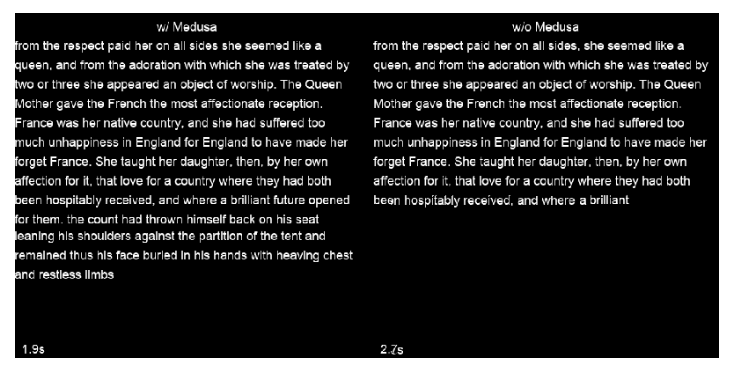

Este modelo no es cualquier cosa; ¡es un 50% más rápido que el famoso Whisper de OpenAI! Se basa en Whisper, pero utiliza una novedosa arquitectura de "atención multi-cabeza" que permite predecir una cantidad de tokens significativamente mayor que la del producto de OpenAI. Además, el código y los pesos se han publicado en Hugging Face bajo la licencia del MIT, permitiendo su uso tanto para investigación como para fines comerciales.

Gill Hetz, vicepresidente de investigación de aiOla, afirmó que la naturaleza de código abierto fomenta la innovación y la colaboración dentro de la comunidad, lo que lleva a un desarrollo más rápido y a un producto más refinado. Este trabajo allana el camino para sistemas de inteligencia artificial compuestos que puedan comprender y responder a las preguntas de los usuarios prácticamente en tiempo real.

En una era donde los modelos básicos pueden generar una variedad de contenido, un reconocimiento de voz avanzado sigue siendo crucial. Whisper, capaz de manejar la complejidad del habla en diferentes idiomas y acentos, con más de 5 millones de descargas mensuales, ha establecido un estándar de oro en el campo, apoyando una gran cantidad de aplicaciones.

Entonces, ¿qué hace que Whisper-Medusa de aiOla sea tan especial?

La compañía modificó la arquitectura de Whisper, incorporando un mecanismo de atención multi-cabeza que permite predecir 10 tokens a la vez, logrando un aumento del 50% en la velocidad sin comprometer la precisión. El modelo se entrenó utilizando un método de aprendizaje automático de supervisión débil, y se esperan versiones aún más potentes en el futuro. Lo que es más importante, dado que la red troncal de Whisper-Medusa se basa en Whisper, el aumento de velocidad no se produce a expensas del rendimiento.

Durante el entrenamiento de Whisper-Medusa, aiOla empleó un método de aprendizaje automático llamado supervisión débil. Como parte de este proceso, se congelaron los componentes principales de Whisper y se utilizaron las transcripciones de audio generadas por el modelo como etiquetas para entrenar el módulo adicional de predicción de tokens.

Cuando se le preguntó si alguna empresa había tenido acceso anticipado a Whisper-Medusa, Hetz respondió que lo habían probado en casos de uso de datos empresariales reales, demostrando su funcionamiento preciso en escenarios del mundo real y allanando el camino para aplicaciones de voz más rápidas en el futuro. En última instancia, cree que la mejora en la velocidad de reconocimiento y transcripción reducirá el tiempo de respuesta de las aplicaciones de voz y permitirá respuestas en tiempo real.

Puntos clave:

💥50% más rápido: Whisper-Medusa de aiOla ofrece una mejora significativa en la velocidad de reconocimiento de voz en comparación con Whisper de OpenAI.

🎯Precisión inalterada: El aumento de velocidad se mantiene sin afectar la precisión del modelo original.

📈Amplias perspectivas de aplicación: Se espera que acelere las respuestas, mejore la eficiencia y reduzca los costos en las aplicaciones de voz.