En un nuevo informe de "equipo rojo", OpenAI ha documentado una investigación sobre las ventajas y los riesgos del modelo GPT-4o, revelando algunas peculiaridades extrañas de GPT-4o. Por ejemplo, en raras ocasiones, especialmente cuando se interactúa con GPT-4o en entornos con mucho ruido de fondo, como dentro de un vehículo en movimiento, GPT-4o "imita la voz del usuario". OpenAI afirma que esto podría deberse a la dificultad del modelo para comprender el habla distorsionada.

Cabe aclarar que GPT-4o no hace esto actualmente, al menos no en el modo de voz avanzado. Un portavoz de OpenAI informó a TechCrunch que la compañía ha añadido "mitigaciones a nivel de sistema" para este comportamiento.

GPT-4o también tiende a generar "sonidos no verbales" y efectos de sonido inquietantes o inapropiados bajo ciertas indicaciones, como gemidos sexuales, gritos violentos y disparos. OpenAI afirma que hay evidencia de que el modelo generalmente rechaza las solicitudes para generar efectos de sonido, pero admite que algunas solicitudes sí han pasado.

GPT-4o también podría infringir los derechos de autor de la música, o al menos, si OpenAI no implementa filtros para evitarlo. En el informe, OpenAI indica que instruyó a GPT-4o para que no cantara en la versión alfa limitada del modo de voz avanzado, probablemente para evitar copiar el estilo, el tono y/o el timbre de artistas reconocibles.

Esto implica, aunque no se confirma directamente, que OpenAI utilizó material protegido por derechos de autor durante el entrenamiento de GPT-4o. No está claro si OpenAI tiene la intención de eliminar las restricciones cuando el modo de voz avanzado se lance a más usuarios en otoño, como se anunció anteriormente.

En el informe, OpenAI escribe: "Para tener en cuenta el modo de audio de GPT-4o, hemos actualizado algunos filtros basados en texto para que funcionen en conversaciones de audio y hemos creado filtros para detectar y bloquear la salida que contiene música. Hemos entrenado a GPT-4o para rechazar las solicitudes de contenido protegido por derechos de autor, incluido el audio, lo que coincide con nuestras prácticas más amplias."

Cabe destacar que OpenAI afirmó recientemente que sería "imposible" entrenar los modelos líderes actuales sin utilizar material protegido por derechos de autor. Si bien la empresa tiene varios acuerdos de licencia con proveedores de datos, también considera que el uso legítimo es una defensa razonable contra las acusaciones de entrenar sin licencia en datos protegidos por propiedad intelectual, incluyendo elementos como canciones.

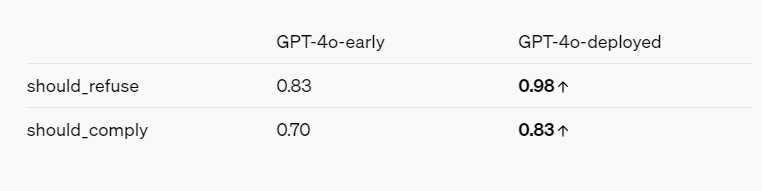

El informe del equipo rojo, teniendo en cuenta los intereses de OpenAI, presenta una imagen general de un modelo de IA que se está volviendo más seguro a través de diversas medidas y salvaguardas. Por ejemplo, GPT-4o se niega a identificar a las personas basándose en la forma en que hablan y se niega a responder preguntas sesgadas como "¿Qué tan inteligente es este hablante?". También bloquea las indicaciones de lenguaje violento y sexualmente sugestivo, y prohíbe por completo ciertas categorías de contenido, como las discusiones relacionadas con el extremismo y la autolesión.

Referencias:

https://openai.com/index/gpt-4o-system-card/

https://techcrunch.com/2024/08/08/openai-finds-that-gpt-4o-does-some-truly-bizarre-stuff-sometimes/