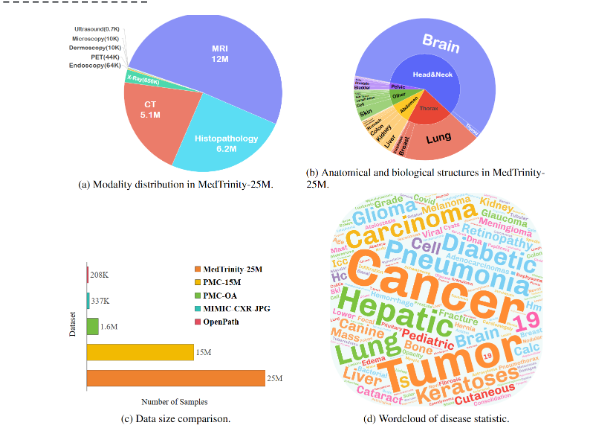

El equipo UCSC-VLAA ha lanzado oficialmente el conjunto de datos multimodal a gran escala "MedTrinity-25M". Este conjunto de datos contiene 25 millones de imágenes médicas con anotaciones detalladas. Se considera una innovación importante en el campo de la medicina, ya que cuenta con anotaciones de múltiples granularidades que ayudan a los investigadores a comprender y aplicar mejor los datos médicos para entrenar modelos multimodales a gran escala en medicina.

El proceso de construcción de MedTrinity-25M fue bastante complejo. El equipo realizó un cuidadoso procesamiento de datos, extrayendo información clave de diversas fuentes, integrando metadatos, generando títulos aproximados, localizando áreas de interés y recopilando conocimientos médicos relevantes. Lo más interesante es que utilizaron esta información y modelos lingüísticos de gran escala (MLLM) para generar descripciones detalladas. Este método no solo mejora la disponibilidad de los datos, sino que también abre nuevas vías para la investigación médica.

En cuanto al proceso de lanzamiento, cabe mencionar que el conjunto de datos de demostración de MedTrinity-25M ya estaba disponible en junio de 2024, mientras que el conjunto de datos completo se lanzó oficialmente el 21 de julio. Recientemente, el 7 de agosto, también publicaron el artículo científico correspondiente.

Además del conjunto de datos en sí, el equipo proporciona una serie de modelos preentrenados, como LLaVA-Med++, que muestran un excelente rendimiento en múltiples tareas médicas. Los investigadores pueden utilizar estas herramientas para mejorar sus proyectos y aumentar considerablemente la eficiencia de la investigación médica.

MedTrinity-25M ofrece un recurso invaluable para la comunidad médica. Esperamos que todos puedan aprovechar al máximo este conjunto de datos para impulsar el avance de la investigación médica.

Acceso al proyecto: https://top.aibase.com/tool/medtrinity-25m