El modelo de generación de imágenes a partir de texto HunyuanDiT de Tencent ha lanzado recientemente, en colaboración con la comunidad, tres nuevos plugins de control ControlNet: tile (ampliación de alta definición), inpainting (reparación y ampliación de imágenes) y lineart (generación de imágenes a partir de bocetos). Esto amplía aún más la matriz ControlNet de HunyuanDiT. La incorporación de estos plugins permite que el modelo HunyuanDiT cubra una gama más amplia de aplicaciones, incluyendo arte, creatividad, arquitectura, fotografía, belleza y comercio electrónico, abarcando el 80% de los casos y escenarios. Esto proporciona a empresas y desarrolladores/creadores individuales de todo el mundo una capacidad de generación de imágenes más precisa y una mayor libertad creativa.

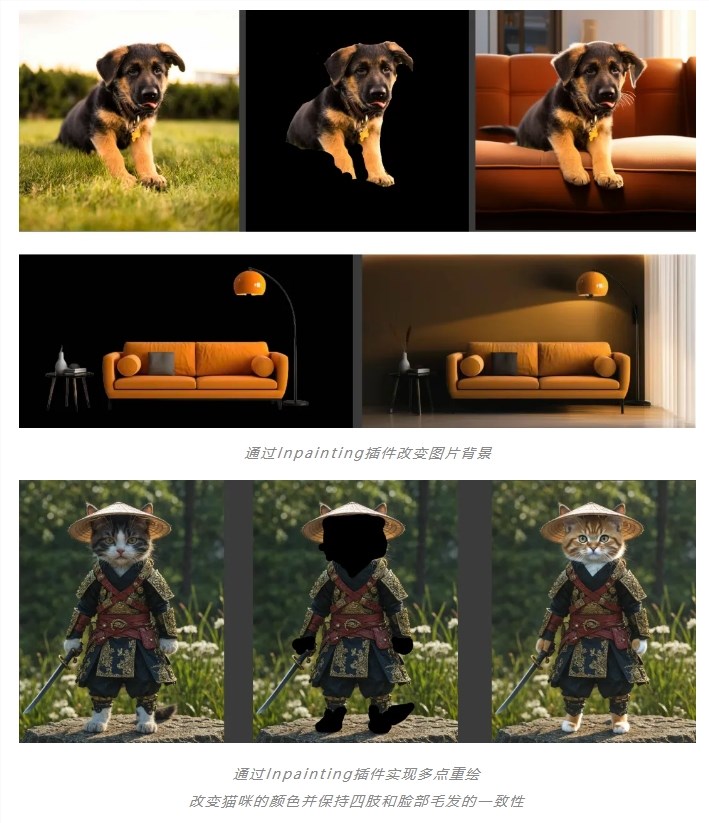

El plugin Tile permite ampliar la información de la imagen, logrando una ampliación de alta definición, incluso hasta una resolución de 4K a 8K, ideal para escenarios que requieren un nivel extremo de detalle. El plugin Inpainting permite rellenar las partes borrosas o dañadas de una imagen según las necesidades del creador, permitiendo cambiar el fondo, modificar el sujeto principal, etc., gestionando la repintado de grandes áreas de la imagen. El plugin Lineart utiliza diferentes tipos de líneas para crear imágenes de personas, anime y arquitectura, siendo adecuado para la generación de renders arquitectónicos y el coloreado de bocetos.

Además, Tencent HunyuanDiT ya había lanzado modelos ControlNet condicionales como canny (bordes), depth (profundidad) y pose (postura corporal), que permiten a los desarrolladores realizar inferencias. También se ha publicado el esquema de entrenamiento de ControlNet, permitiendo a los desarrolladores y creadores entrenar modelos ControlNet personalizados.

Desde su anuncio de actualización completa y publicación de código abierto en mayo, HunyuanDiT, como el primer modelo de generación de imágenes a partir de texto de código abierto nativo en chino, ha continuado construyendo su ecosistema de desarrolladores. Se ha lanzado una biblioteca de aceleración exclusiva que mejora la eficiencia de la inferencia, reduciendo el tiempo de generación de imágenes, y se ha publicado el código de inferencia. En julio, HunyuanDiT se actualizó a la versión 1.2, lanzando una versión para tarjetas gráficas con poca memoria, que solo requiere 6 GB de VRAM, lo que resulta más amigable para los desarrolladores que implementan el modelo localmente en sus computadoras personales.

Actualmente, HunyuanDiT cuenta con más de 3.1k estrellas en Github, convirtiéndose en el modelo de código abierto DiT nacional más popular.

Sitio web oficial

https://dit.hunyuan.tencent.com/

Código

https://github.com/Tencent/HunyuanDiT

Modelo

https://huggingface.co/Tencent-Hunyuan/HunyuanDiT

Artículo científico

https://tencent.github.io/HunyuanDiT/asset/Hunyuan_DiT_Tech_Report_05140553.pdf