La empresa emergente de IA Cosine, con sede en San Francisco, ha lanzado un nuevo modelo de IA llamado Genie, diseñado para ayudar a los desarrolladores de software. Según la empresa, Genie ha superado con creces a sus competidores en pruebas de referencia, demostrando una capacidad excepcional.

Cosine colaboró con OpenAI para entrenar una variante de GPT-4o con datos de alta calidad, logrando impresionantes resultados en las pruebas de referencia. La empresa afirma que la clave del éxito de Genie radica en su capacidad de "razonamiento humano en la codificación", una habilidad que podría extenderse más allá del desarrollo de software.

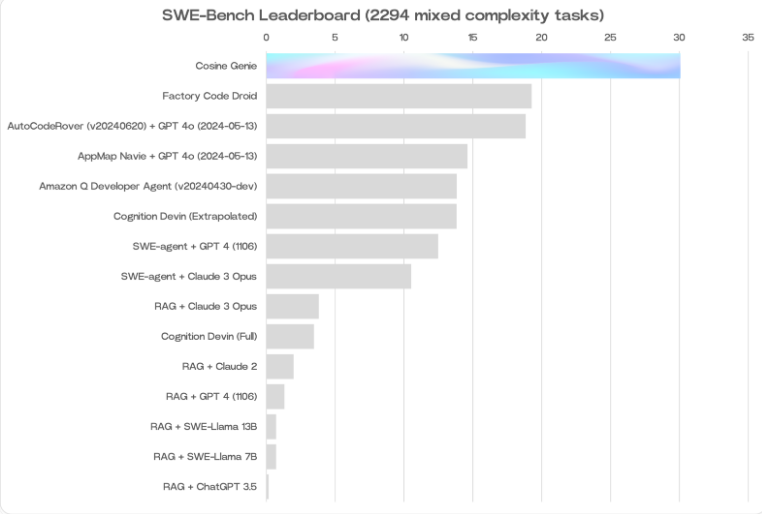

Genie lidera en el campo de SWE

Alistair Pullen, cofundador y CEO de Cosine, reveló que Genie obtuvo una puntuación del 30% en la prueba SWE-Bench, la puntuación más alta jamás alcanzada por un modelo de IA en este campo. Este resultado supera a otros modelos de lenguaje centrados en la codificación, como el modelo de Amazon (19%) y Devin de Cognition (13,8% en algunas pruebas de SWE-Bench).

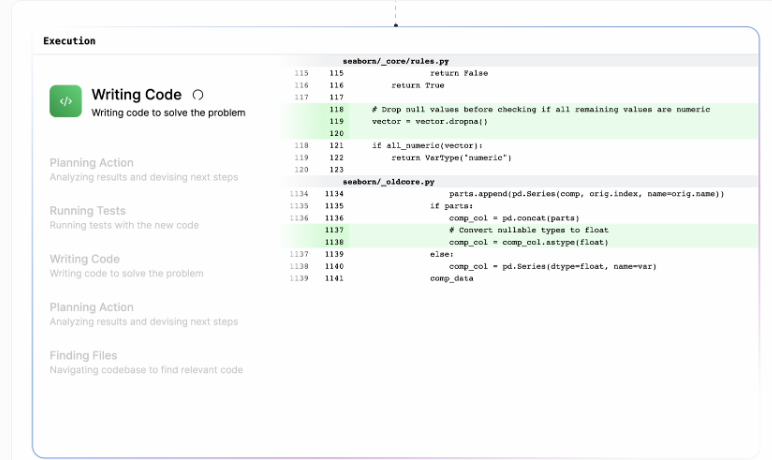

La arquitectura de Genie está diseñada para imitar el proceso cognitivo de un desarrollador humano. Puede corregir errores, desarrollar nuevas funciones, refactorizar código y realizar diversas tareas de programación de forma autónoma o colaborativa.

Automejora a través de datos sintéticos

El desarrollo de Genie empleó un proceso patentado que entrenó y ajustó una variante no revelada de GPT-40 con miles de millones de datos de alta calidad. Con la ayuda de desarrolladores experimentados, Cosine pasó casi un año compilando estos datos, que incluyen un 21% de JavaScript y Python, un 14% de TypeScript y TSX, y un 3% de otros lenguajes (incluidos Java, C++ y Ruby).

El rendimiento excepcional de Genie se debe en parte a su entrenamiento de automejora. Inicialmente, el modelo aprendió principalmente de código perfecto y eficiente, pero se mostraba confundido al gestionar sus propios errores. Cosine resolvió este problema utilizando datos sintéticos: si la solución inicial de Genie era incorrecta, se mostraba al modelo cómo mejorarla con el resultado correcto. Con cada iteración, las soluciones de Genie fueron mejorando gradualmente, reduciendo el número de correcciones necesarias.

Superando las limitaciones tecnológicas

Pullen ya vio a principios de 2022 el potencial de los grandes modelos de lenguaje para apoyar el desarrollo de software humano. Sin embargo, la tecnología de entonces no estaba a la altura de la visión de Genie. La capacidad de tokens de la ventana de contexto solía estar limitada a 4000 tokens, un importante cuello de botella. Hoy en día, modelos como Gemini 1.5 Pro pueden procesar hasta 2 millones de tokens en una sola solicitud. Aunque Cosine no ha revelado la capacidad de tokens específica de Genie, este avance tecnológico sin duda ha sentado las bases para el éxito de Genie.