La reconocida empresa china de inteligencia artificial, Unisound, anunció el 23 de agosto de 2024 en Beijing el lanzamiento de su último desarrollo: el modelo multimodal Shanhai.

El modelo multimodal Shanhai es parte de la infraestructura de inteligencia artificial Atlas de Unisound. Puede recibir y procesar entradas de múltiples modalidades, como texto, audio e imágenes, y generar en tiempo real cualquier combinación de salida de texto, audio e imágenes. Esta capacidad permite que el modelo Shanhai no solo realice interacciones de voz eficientes, sino que también ofrezca una experiencia fluida de conversación cercana a la naturalidad humana.

Este modelo cuenta con una capacidad de interacción de voz inteligente de alto nivel. Puede responder en tiempo real a las instrucciones del usuario, admite la interrupción de la conversación en cualquier momento, y puede percibir y expresar emociones, creando una conexión emocional con el usuario. Además, el modelo Shanhai puede cambiar libremente el timbre de voz, creando una voz personalizada según las necesidades individuales del usuario.

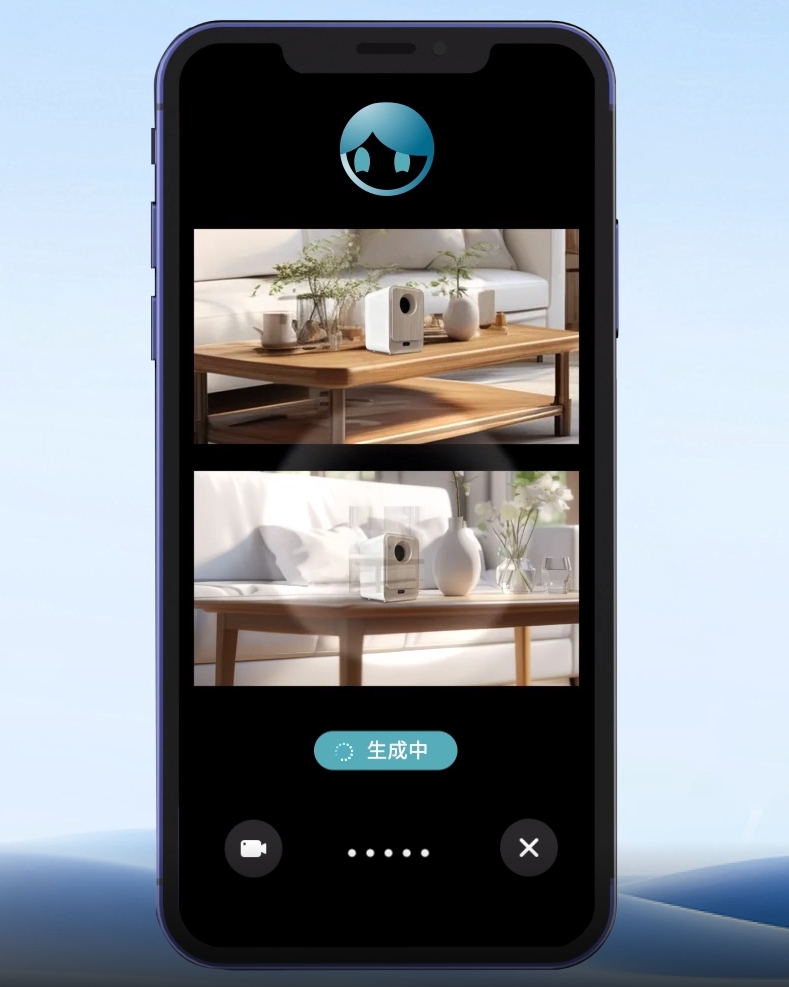

En cuanto a la interacción visual, el modelo Shanhai puede comprender y describir el entorno a través de una cámara, logrando una identificación precisa de objetos y un análisis de escenas. También puede crear contenido visual rápidamente según las instrucciones del usuario, ofreciendo una experiencia visual personalizada.

Unisound afirma que el lanzamiento del modelo multimodal Shanhai representa el nuevo núcleo de su plataforma tecnológica Yunzhi Brain, y proporcionará productos y soluciones más ricas y eficientes para los dos principales campos de la vida inteligente y la atención médica inteligente. Desde su lanzamiento en mayo de 2023, el modelo Shanhai ha obtenido numerosos premios en varias competiciones de autoridad, demostrando sus capacidades generales y profesionales excepcionales.

Dirección de prueba:https://shanhai.unisound.com/