En la era de la creciente popularidad de la inteligencia artificial, cada vez más usuarios consultan problemas médicos a través de chatbots de IA como ChatGPT y Google Gemini. Algunos incluso suben radiografías, imágenes de resonancia magnética (IRM) y tomografías por emisión de positrones (PET) al asistente de IA Grok de la plataforma X para su interpretación. Sin embargo, esta práctica puede conllevar graves riesgos para la privacidad y la seguridad.

Aunque los datos médicos están especialmente protegidos por las leyes federales, si el usuario decide eludir estos mecanismos de protección, se enfrenta a los siguientes riesgos:

Riesgo de entrenamiento de datos

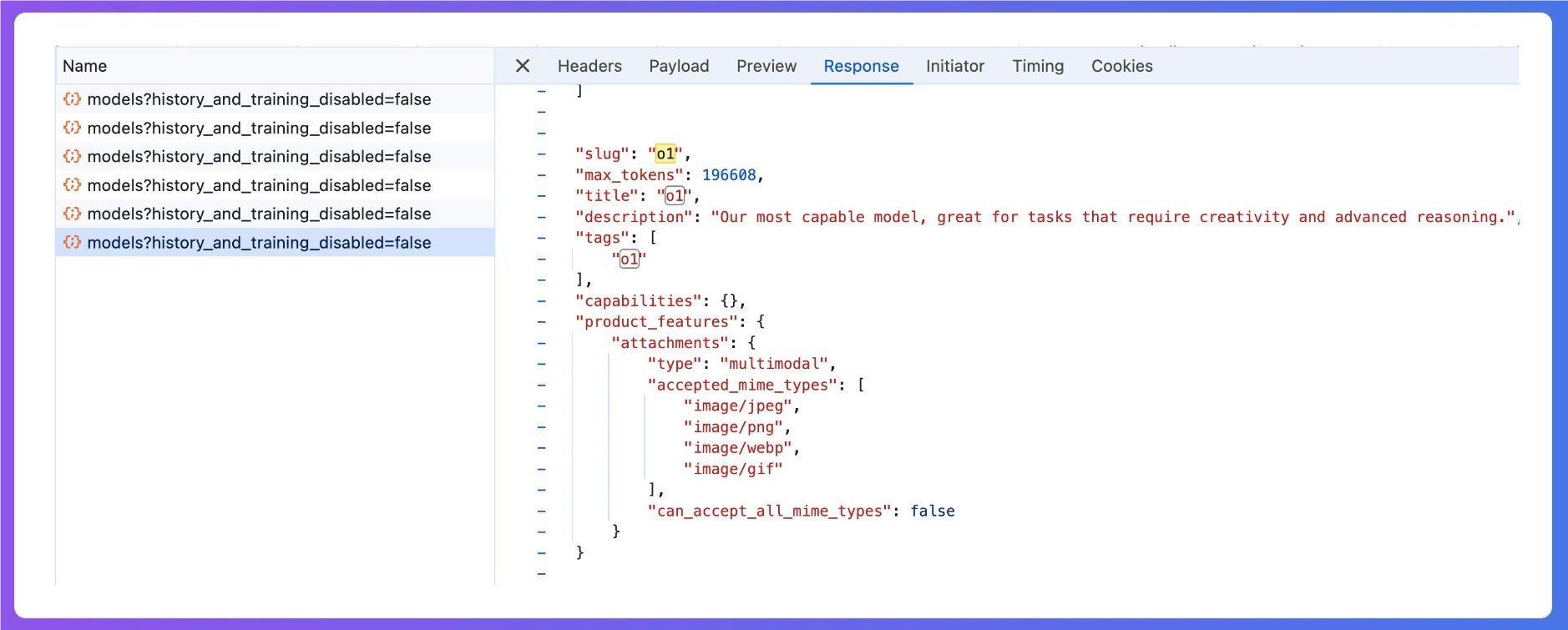

Los modelos de IA generativa suelen utilizar los datos recibidos para entrenarse y mejorar la precisión de sus resultados. Sin embargo, a menudo falta transparencia sobre cómo se utilizan los datos del usuario, con qué propósito y con quién se comparten. Además, las empresas pueden cambiar su política de uso de datos en cualquier momento.

Amenaza de filtración de datos privados

Algunos usuarios han descubierto que sus registros médicos privados aparecen en los conjuntos de datos de entrenamiento de la IA, lo que significa que proveedores de servicios médicos, futuros empleadores e incluso organismos gubernamentales podrían acceder a esta información sensible. Más preocupante aún es que la mayoría de las aplicaciones orientadas al consumidor no están sujetas a la Ley de Privacidad de Información Médica de Estados Unidos (HIPAA), por lo que no pueden proteger eficazmente los datos que los usuarios suben.

Falta de transparencia en las políticas

En el caso de la plataforma X, aunque su propietario, Elon Musk, anima a los usuarios a subir imágenes médicas a Grok para mejorar la capacidad de interpretación de la IA, la política de privacidad de la plataforma indica que X comparte información personal del usuario con un número no especificado de empresas "relacionadas". Este mecanismo de intercambio de datos opaco es preocupante.

Los expertos advierten a los usuarios: la información en internet nunca desaparece. Antes de subir datos médicos privados a una plataforma de IA, piense bien las consecuencias. Incluso con el objetivo de mejorar la gestión de la salud, es necesario evaluar cuidadosamente los riesgos potenciales para la privacidad.

Disfrutar de las ventajas de la IA y proteger la privacidad de los datos médicos son igualmente importantes. Se recomienda a los usuarios:

Priorizar los canales médicos oficiales protegidos por HIPAA

Leer atentamente las políticas de privacidad de las plataformas de IA

Evitar subir imágenes médicas sensibles e información personal de salud

Controlar periódicamente las actualizaciones de las políticas de uso de datos de las plataformas utilizadas