En el ámbito de la IA de código abierto, la brecha con las grandes empresas tecnológicas no se limita a la potencia de cálculo. AI2 (anteriormente Allen Institute for Artificial Intelligence) está reduciendo esta brecha a través de una serie de iniciativas innovadoras. Su última solución de entrenamiento posterior, Tülu3, hace que la transformación de modelos de lenguaje grandes "primitivos" en sistemas de IA prácticos esté al alcance de la mano.

Contrariamente a la creencia popular, los modelos de lenguaje básicos no están listos para su uso directo después del preentrenamiento. De hecho, el proceso de entrenamiento posterior es clave para determinar el valor final del modelo. Es en esta etapa donde el modelo pasa de ser una red "omnisciente" pero carente de juicio a una herramienta práctica con una función específica.

Durante mucho tiempo, las grandes empresas han mantenido en secreto sus soluciones de entrenamiento posterior. Si bien cualquiera puede construir modelos utilizando las últimas tecnologías, hacer que un modelo funcione en un área específica (como la asesoría psicológica o el análisis de investigación) requiere técnicas de entrenamiento posterior únicas. Incluso proyectos como Llama de Meta, que se presentan como "de código abierto", mantienen en secreto el origen de sus modelos originales y sus métodos de entrenamiento generales.

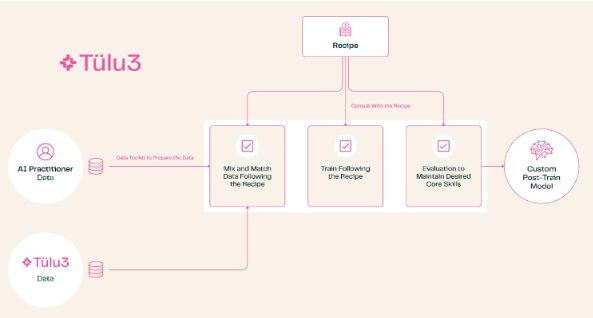

La aparición de Tülu3 ha cambiado esta situación. Esta solución completa de entrenamiento posterior abarca todo el proceso, desde la selección del tema hasta la gestión de datos, pasando por el aprendizaje por refuerzo y el ajuste fino. Los usuarios pueden ajustar las capacidades del modelo según sus necesidades, por ejemplo, reforzar las habilidades matemáticas y de programación o reducir la prioridad del procesamiento multilingüe.

Las pruebas de AI2 muestran que el rendimiento de los modelos entrenados con Tülu3 ha alcanzado el nivel de los mejores modelos de código abierto. Este avance es significativo: ofrece a las empresas una opción totalmente autónoma y controlable. Especialmente para las instituciones que manejan datos sensibles, como la investigación médica, ya no es necesario depender de API de terceros o servicios personalizados; pueden realizar todo el entrenamiento localmente, ahorrando costes y protegiendo la privacidad.

AI2 no solo ha publicado esta solución, sino que también la ha aplicado a sus propios productos. Aunque los resultados actuales de las pruebas se basan en el modelo Llama, planean lanzar un nuevo modelo basado en su propio OLMo y entrenado con Tülu3, lo que representará una solución verdaderamente de código abierto de principio a fin.

Esta apertura tecnológica no solo demuestra la determinación de AI2 de impulsar la democratización de la IA, sino que también ha inyectado una inyección de energía en toda la comunidad de IA de código abierto. Nos acerca a un ecosistema de IA verdaderamente abierto y transparente.