Con la creciente globalización, la tecnología de traducción automática neuronal (NMT) desempeña un papel cada vez más importante en la comunicación entre idiomas. Si bien las herramientas de traducción actuales funcionan bien con documentos técnicos y textos sencillos, todavía enfrentan muchos desafíos en la traducción de textos literarios. Las obras literarias a menudo contienen metáforas y símiles, expresiones ricas en matices culturales y emocionales que los sistemas de traducción tradicionales suelen tener dificultades para transmitir con precisión.

Para compensar esta deficiencia, el equipo de investigación de Tencent ha presentado un nuevo sistema de traducción llamado DRT-o1. Este sistema incluye dos versiones: DRT-o1-7B y DRT-o1-14B. Ambos modelos se basan en Qwen2.5 e incorporan un nuevo marco multiagente optimizado específicamente para la traducción de metáforas y símiles. El equipo de investigación recopiló aproximadamente 400 libros de dominio público en inglés del Proyecto Gutenberg, extrajo 577.600 oraciones y seleccionó 63.000 oraciones que contienen metáforas y símiles como datos de entrenamiento.

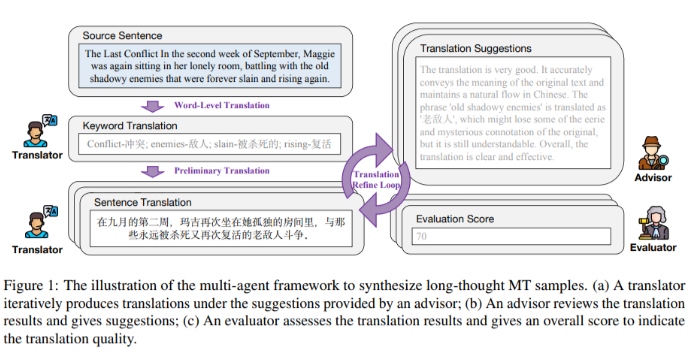

El sistema DRT-o1 utiliza un método de colaboración compuesto por tres roles: traductor, asesor y evaluador. El flujo de trabajo de este marco multiagente comienza con la identificación y traducción individual de los términos clave en la oración fuente, asegurando la precisión del contexto. Después de generar una traducción preliminar, se realizan varias rondas de mejoras y evaluaciones para producir finalmente una traducción fluida y fácil de entender. Este sistema, al traducir obras literarias, puede capturar mejor sus matices culturales y emocionales.

Los resultados experimentales muestran que DRT-o1-7B mejoró su puntuación BLEU en 8.26 puntos y su puntuación COMET en 3.36 puntos, superando a su predecesor Qwen2.5-7B-Instruct. DRT-o1-14B también mostró un excelente rendimiento, con una mejora de 7.33 puntos en la puntuación BLEU y de 1.66 puntos en la puntuación COMET. Estos resultados indican que DRT-o1 supera a los modelos existentes en la traducción literaria, especialmente su versión 7B, que incluso supera al modelo QwQ-32B más grande.

El sistema DRT-o1, mediante la introducción de un marco multiagente y un método de razonamiento de cadena larga, ha supuesto un avance innovador en el campo de la traducción automática neuronal. No solo mejora la precisión y fluidez de la traducción, sino que también ofrece nuevas soluciones para la traducción de textos literarios complejos.

Enlace al proyecto: https://github.com/krystalan/DRT-o1

Puntos clave:

🌟 El sistema DRT-o1 incluye dos versiones (7B y 14B) y utiliza un marco multiagente para optimizar la traducción de metáforas y símiles.

📚 El equipo de investigación extrajo y seleccionó 63.000 oraciones literarias de 400 libros de dominio público como datos de entrenamiento.

🚀 DRT-o1 muestra una mejora significativa en las puntuaciones BLEU y COMET, demostrando una potente capacidad de traducción literaria.