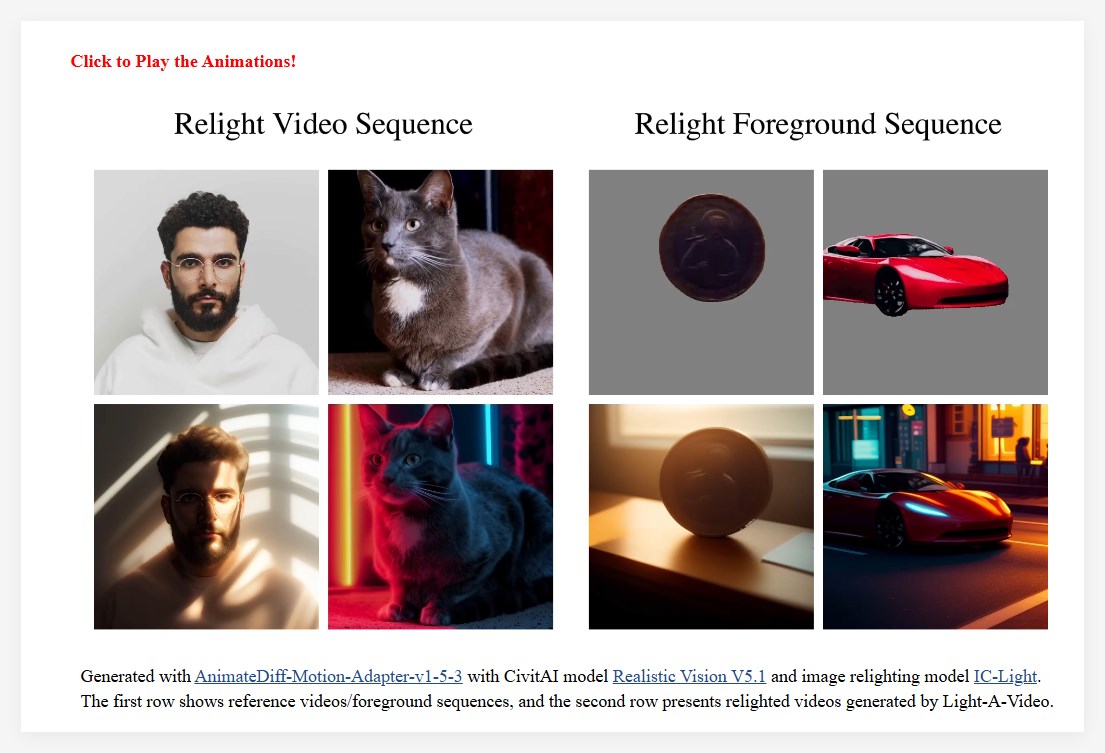

El progreso reciente en las técnicas de reiluminación de imágenes se debe a los conjuntos de datos a gran escala y a los modelos de difusión preentrenados, haciendo que la aplicación de iluminación consistente sea más común. Sin embargo, en el campo de la reiluminación de video, el progreso ha sido relativamente lento debido a los altos costos de entrenamiento y a la falta de conjuntos de datos de reiluminación de video diversos y de alta calidad.

La simple aplicación de modelos de reiluminación de imágenes fotograma a fotograma a los videos puede provocar varios problemas, como inconsistencias en la fuente de luz y en la apariencia de la reiluminación, lo que resulta en un efecto parpadeante en el video generado.

Para solucionar este problema, el equipo de investigación presentó Light-A-Video, un método sin entrenamiento que permite una reiluminación de video temporalmente suave. Light-A-Video se basa en modelos de reiluminación de imágenes e introduce dos módulos clave para mejorar la consistencia de la iluminación.

Primero, los investigadores diseñaron un módulo de Atención de Luz Consistente (Consistent Light Attention, CLA), que mejora la interacción entre fotogramas dentro de la capa de autoatención para estabilizar la generación de la fuente de luz de fondo.

Segundo, basándose en el principio físico de la independencia de la transmisión de luz, el equipo de investigación utiliza una estrategia de fusión lineal para mezclar la apariencia del video fuente con la apariencia reiluminada. Emplea una estrategia de Fusión de Luz Progresiva (Progressive Light Fusion, PLF) para asegurar una transición de iluminación suave en el tiempo.

En los experimentos, Light-A-Video mostró una mejora significativa en la consistencia temporal de la reiluminación de video, manteniendo al mismo tiempo la calidad de la imagen y asegurando la consistencia de la transición de iluminación entre fotogramas. El marco muestra el proceso de procesamiento del video fuente: primero se aplica un procesamiento de ruido al video fuente, luego se utiliza el modelo VDM para la eliminación gradual de ruido. En cada paso, el componente sin ruido predicho representa la dirección de eliminación de ruido del VDM y sirve como objetivo consistente. Sobre esta base, el módulo de Atención de Luz Consistente inyecta información de iluminación única, transformándola en un objetivo de reiluminación. Finalmente, la estrategia de Fusión de Luz Progresiva combina los dos objetivos, formando un objetivo fusionado, proporcionando así una dirección más precisa para el paso actual.

El éxito de Light-A-Video no solo demuestra el potencial de las técnicas de reiluminación de video, sino que también indica la dirección para futuras investigaciones.

https://bujiazi.github.io/light-a-video.github.io/

Puntos clave:

🌟 Light-A-Video es una técnica sin entrenamiento diseñada para lograr la consistencia temporal en la reiluminación de video.

🎥 Emplea un módulo de Atención de Luz Consistente y una estrategia de Fusión de Luz Progresiva para resolver el problema de la inconsistencia de la fuente de luz en la reiluminación de video.

📈 Los experimentos demuestran que Light-A-Video mejora significativamente la consistencia temporal y la calidad de la imagen en la reiluminación de video.