En el campo de la inteligencia artificial multimodal, el Instituto de Inteligencia Artificial de Beijing (BAAI) en colaboración con varias universidades, ha lanzado el nuevo modelo vectorial multimodal BGE-VL, marcando un gran avance en la tecnología de búsqueda multimodal. Desde su lanzamiento, la serie de modelos BGE ha recibido elogios generalizados, y el lanzamiento de BGE-VL enriquece aún más este ecosistema. Este modelo destaca en varias tareas clave, como la búsqueda de imágenes y texto y la búsqueda de imágenes combinadas, demostrando un rendimiento excepcional.

El éxito de BGE-VL se debe a su tecnología de síntesis de datos MegaPairs. Este método innovador extrae datos de imagen y texto a gran escala existentes para generar automáticamente datos de tríadas multimodales de alta calidad, mejorando significativamente la escalabilidad y la calidad de los datos. MegaPairs puede generar conjuntos de datos diversos a un costo muy bajo, con más de 26 millones de muestras, proporcionando una base sólida para el entrenamiento de modelos de búsqueda multimodal. Esta tecnología ha permitido a BGE-VL lograr resultados líderes en varios benchmarks de búsqueda multimodal.

En la actualidad, con la creciente importancia de la búsqueda multimodal, las necesidades de los usuarios en cuanto a la obtención de información son cada vez más diversas. Los modelos de búsqueda anteriores dependían en gran medida del entrenamiento con pares únicos de imagen y texto, lo que no permitía hacer frente eficazmente a entradas combinadas complejas. BGE-VL, mediante la incorporación de datos MegaPairs, supera esta limitación, permitiendo que el modelo comprenda y procese consultas multimodales de forma más completa.

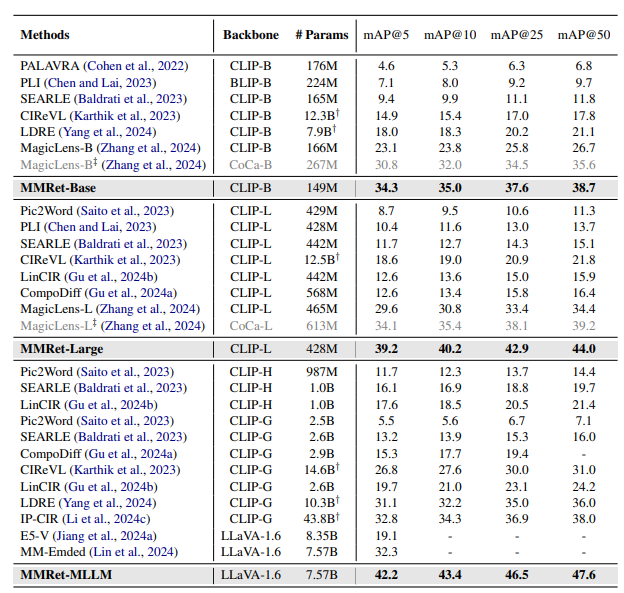

El equipo de BAAI, en las evaluaciones de rendimiento de múltiples tareas, descubrió que el modelo BGE-VL muestra un rendimiento excepcional de cero disparos en el Massive Multimodal Embedding Benchmark (MMEB). A pesar de que MegaPairs no cubre la mayoría de las tareas en MMEB, su capacidad de generalización de tareas sigue siendo impresionante. Además, en la evaluación de búsqueda de imágenes combinadas, BGE-VL también destaca, superando ampliamente a muchos modelos conocidos, como MagicLens de Google y MM-Embed de NVIDIA.

En el futuro, el Instituto de Inteligencia Artificial de Beijing planea continuar profundizando en la tecnología MegaPairs, combinándola con escenarios de búsqueda multimodal más ricos, con el objetivo de crear un buscador multimodal más completo y eficiente, para proporcionar a los usuarios un servicio de información más preciso. Con el desarrollo de la tecnología multimodal, el lanzamiento de BGE-VL sin duda impulsará una mayor exploración e innovación en los campos relacionados.

Enlace del artículo: https://arxiv.org/abs/2412.14475

Página del proyecto: https://github.com/VectorSpaceLab/MegaPairs

Dirección del modelo: https://huggingface.co/BAAI/BGE-VL-MLLM-S1