Shanghai Jieyue Xingchen Intelligent Technology Co., Ltd. anuncia la publicación de código abierto de su último modelo de video a partir de imágenes: Step-Video-TI2V. Este modelo, entrenado a partir de Step-Video-T2V con 30 mil millones de parámetros, puede generar videos de 102 fotogramas, 5 segundos y resolución 540P. Sus dos características principales son el control de la amplitud del movimiento y el control del movimiento de la cámara, destacando especialmente en la generación de efectos de anime. En comparación con los modelos de video a partir de imágenes de código abierto existentes, Step-Video-TI2V no solo ofrece un límite superior en la escala de parámetros, sino que su capacidad de control de la amplitud del movimiento también permite equilibrar la dinámica y la estabilidad del resultado del video, ofreciendo a los creadores opciones más flexibles.

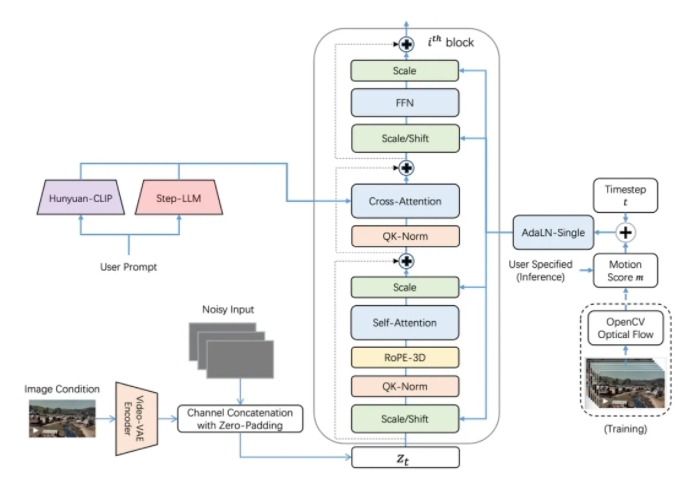

Durante el desarrollo de Step-Video-TI2V, el equipo realizó dos optimizaciones clave. En primer lugar, se introdujo una condición de imagen para mejorar la coherencia entre el video generado y la imagen original. A diferencia del método tradicional de atención cruzada, este modelo utiliza un método más directo: la concatenación de la representación vectorial correspondiente a la imagen con la representación vectorial correspondiente al primer fotograma de DiT en la dimensión del canal, asegurando así una alta coherencia entre el video generado y la imagen de entrada. En segundo lugar, mediante el módulo AdaLN se introdujo información de puntuación de la dinámica del video, permitiendo a los usuarios especificar diferentes niveles de movimiento al generar videos, controlando con precisión la amplitud dinámica del video y equilibrando así la dinámica, la estabilidad y la coherencia. Además, el equipo realizó un etiquetado preciso y específico de los movimientos del sujeto y del movimiento de la cámara, mejorando aún más el rendimiento del modelo en cuanto a la dinámica del sujeto y los efectos de la cámara.

Las características principales de Step-Video-TI2V incluyen el control de la amplitud del movimiento, el control de varios movimientos de cámara, la excelente calidad de los efectos de anime y la compatibilidad con la generación de varios tamaños. Los usuarios pueden cambiar libremente entre imágenes dinámicas y estables según sus necesidades creativas, generando videos con efectos de cámara desde los básicos (panorámica, travelling, zoom) hasta los complejos efectos de cámara cinematográfica. El modelo destaca especialmente en tareas relacionadas con anime, siendo ideal para la creación de animaciones y la producción de videos cortos. Además, admite videos a partir de imágenes de varios tamaños, ya sean horizontales, verticales o cuadradas, satisfaciendo las necesidades de diferentes plataformas.

Enlace de prueba:

https://yuewen.cn/videos

GitHub:

https://github.com/stepfun-ai/Step-Video-TI2V

Github-ComfyUI:

https://github.com/stepfun-ai/ComfyUI-StepVideo