Recientemente, el equipo de潞晨Open-Sora ha logrado avances revolucionarios en la calidad y el tiempo de generación de videos de texto a video de alta definición de 720p. No solo han conseguido un gran avance en la calidad y la velocidad de generación de videos de 720p, sino que también han abierto el código de este tesoro, ¡lo que ha generado gran entusiasmo en toda la comunidad!

Sin exagerar, su proyecto de código abierto ha hecho que la generación de videos sea tan sencilla como pedir comida a domicilio. Desde su presentación en marzo, ha acumulado 17.5K estrellas en GitHub, ¡un éxito rotundo!

Enlace del código abierto: https://github.com/hpcaitech/Open-Sora

Open-Sora puede generar videos de 720p de 16 segundos con un solo clic. Ya se trate de retratos de personajes exquisitos, impresionantes películas de ciencia ficción o animaciones divertidas y dinámicas con efectos de zoom fluidos, puede manejarlo todo con facilidad. De hecho, Lambda Labs, una empresa de IA con participación de Nvidia, ha creado un universo digital de Lego basándose en los pesos del modelo Open-Sora, ofreciendo a los aficionados a Lego un nuevo mundo de creatividad.

El equipo de潞晨 no solo ha abierto el código de los pesos del modelo, sino que también ha publicado la ruta técnica en GitHub, permitiendo que cada usuario se convierta en el maestro de los grandes modelos de video. Este informe técnico analiza en profundidad el núcleo y las claves del entrenamiento del modelo, desde la red de compresión de video y el algoritmo del modelo de difusión hasta la capacidad de control. Con un modelo de generación de difusión de 1.1B, han resuelto los puntos débiles del entrenamiento de modelos de video.

Enlace del informe: https://github.com/hpcaitech/Open-Sora/blob/main/docs/report_03.md

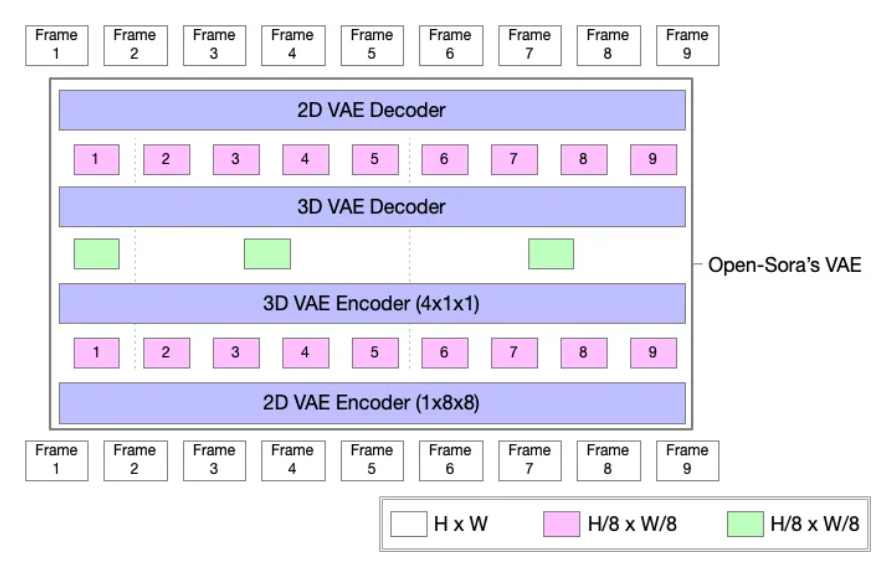

La introducción de la red de compresión de video es un método similar al de Sora de OpenAI. Puede comprimir 4 veces en la dimensión temporal sin necesidad de interpolación de fotogramas, pudiendo generar videos con FPS originales. El equipo también propuso una red de compresión de video simple (es decir, VAE), que primero puede lograr una compresión de 8x8 veces en la dimensión espacial y luego una compresión de 4 veces en la dimensión temporal.

El último modelo de difusión de Stable Diffusion 3, mediante la tecnología de flujo rectificado, mejora la calidad de generación. El equipo de潞晨 proporciona técnicas como el entrenamiento rectificado y el muestreo de pasos de tiempo Logit-norm, lo que acelera la velocidad de entrenamiento del modelo y reduce el tiempo de espera de inferencia.

El informe también revela detalles esenciales del entrenamiento del modelo, incluyendo la limpieza de datos, las técnicas de ajuste del modelo y la construcción del sistema de evaluación del modelo. Incluso proporcionan una aplicación Gradio de implementación con un solo clic, que admite varios ajustes de parámetros.

La publicación del código abierto de潞晨Open-Sora rompe el ciclo cerrado, inyectando vitalidad en la innovación y el desarrollo de la generación de video a partir de texto. Los usuarios pasan de ser consumidores de contenido a creadores, y los usuarios empresariales desbloquean nuevas habilidades de desarrollo autónomo.