Mistral社は、最新のオープンソースコーディングモデルであるCodestral25.01を発表しました。これは、人気のコーディングモデルCodestralのアップグレード版です。アーキテクチャが最適化され、パフォーマンスが大幅に向上しました。「重量級コーディングの明確なリーダー」として、前バージョンと比べて速度が2倍に向上しています。

元のCodestralと同様に、Codestral25.01は低遅延と高頻度操作に重点を置いており、コード修正、テスト生成、中間埋め込みタスクをサポートしています。Mistral社によると、このバージョンは、より多くのデータとモデルの常駐が必要な企業に特に適しています。ベンチマークテストでは、Codestral25.01はPythonコーディングテストで予想以上の結果を示し、HumanEvalテストでは86.6%というスコアを獲得しました。これは、前バージョン、Codellama70B Instruct、DeepSeek Coder33B Instructをはるかに上回っています。

開発者は、Mistral IDEプラグインとローカル展開ツールContinueを使用してこのモデルにアクセスできます。さらに、MistralはGoogle Vertex AIとMistral la Plateformeを通じてAPIへのアクセスを提供しています。このモデルは現在Azure AI Foundryでプレビュー版を提供しており、近いうちにAmazon Bedrockプラットフォームにも登場する予定です。

昨年リリースされて以来、MistralのCodestralはコード中心のオープンソースモデルの中でトップクラスの地位を確立しています。最初のCodestralは220億パラメーターのモデルで、最大80種類の言語をサポートし、多くの同種製品よりも優れたコーディングパフォーマンスを誇っていました。その後、MistralはCodestral-Mambaを発表しました。これはMambaアーキテクチャに基づくコード生成モデルで、より長いコード列を処理し、より多くの入力要求に対応できます。

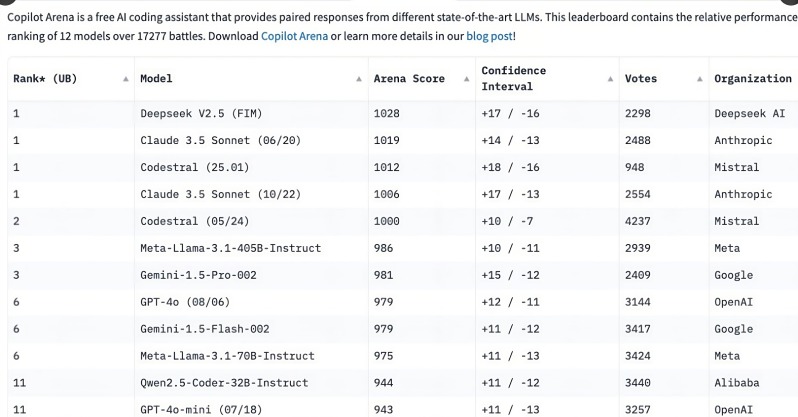

Codestral25.01の発表は開発者の大きな注目を集め、リリースからわずか数時間でC o pilot Arenaランキングで上位にランクインしました。この傾向は、特にコーディングタスクにおいて、多機能な汎用モデルよりも、専門的なコーディングモデルが開発者の間で急速に主流になりつつあることを示しています。

OpenAIのo3やAnthropicのClaudeなどの汎用モデルもコーディングを実行できますが、専門的に最適化されたコーディングモデルの方がパフォーマンスが優れていることが多いです。過去1年間で、アリババのQwen2.5-Coderや中国のDeepSeek Coder(GPT-4Turboを初めて上回ったモデル)など、コーディングに特化した専用モデルが複数企業から発表されています。さらに、マイクロソフトは専門家混合モデル(MOE)に基づくGRIN-MoEを発表しました。このモデルはコーディングだけでなく、数学の問題も解決できます。

汎用モデルと専門モデルのどちらを選択すべきかについては、開発者の間で議論が続いていますが、コーディングモデルの急速な台頭は、効率的で正確なコーディングツールの大きな需要を示しています。コーディングタスク用にトレーニングされたという利点を活かし、Codestral25.01は間違いなく将来のコーディング分野で重要な地位を占めるでしょう。