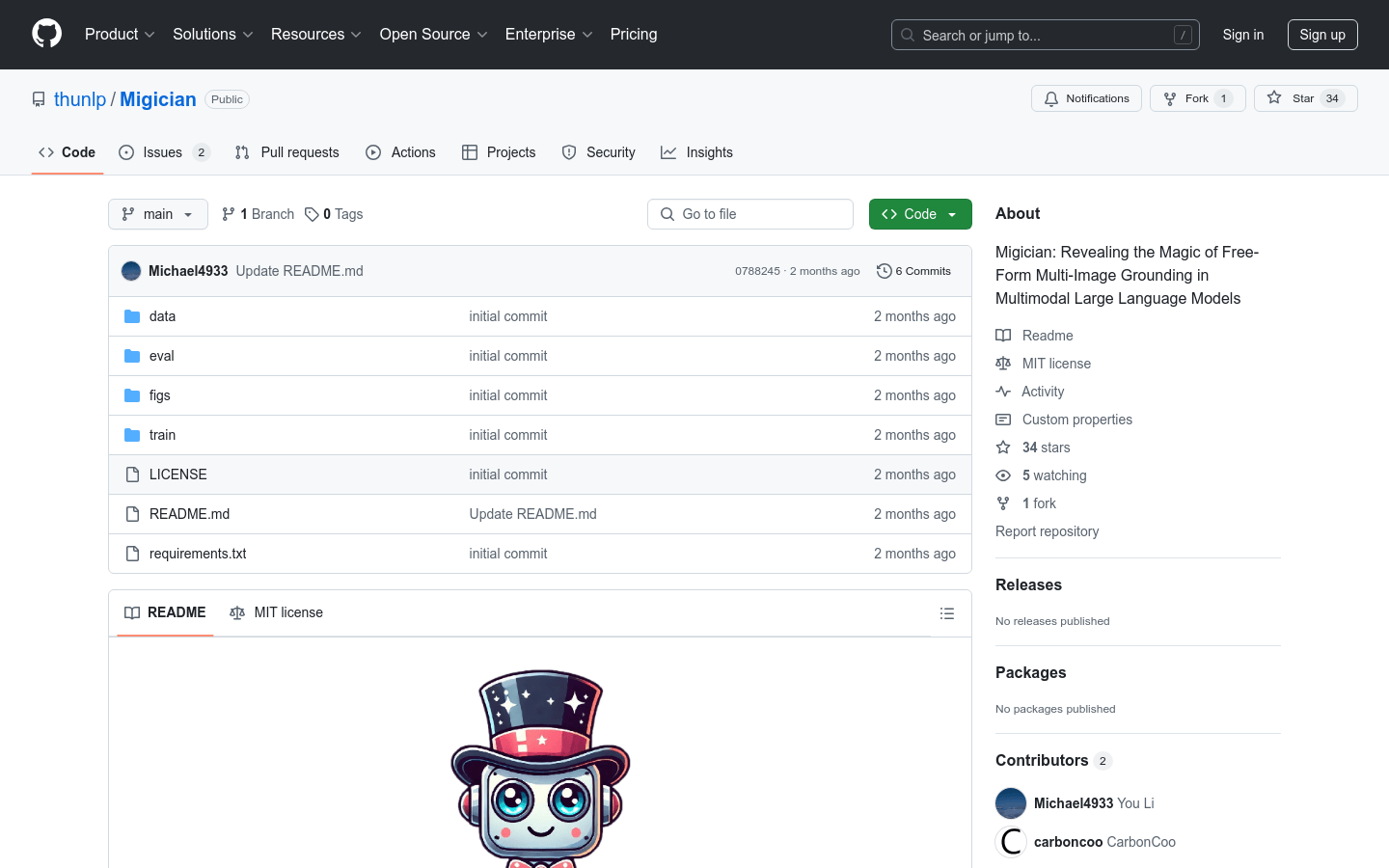

Migician

Migician es un modelo de lenguaje multimodal de gran tamaño centrado en la localización de múltiples imágenes, capaz de realizar una localización precisa de múltiples imágenes de forma libre.

Migician Situación del tráfico más reciente

Total de visitas mensuales

521149929

Tasa de rebote

35.96%

Páginas promedio por visita

6.1

Duración promedio de la visita

00:06:29