Google a annoncé aujourd'hui le lancement d'une nouvelle série de modèles Gemini améliorés : Gemini-1.5-Pro-002 et Gemini-1.5-Flash-002. Cette mise à jour non seulement améliore considérablement les performances, mais offre également des prix avantageux, ce qui ne manquera pas de susciter un engouement dans le monde du développement de l'IA.

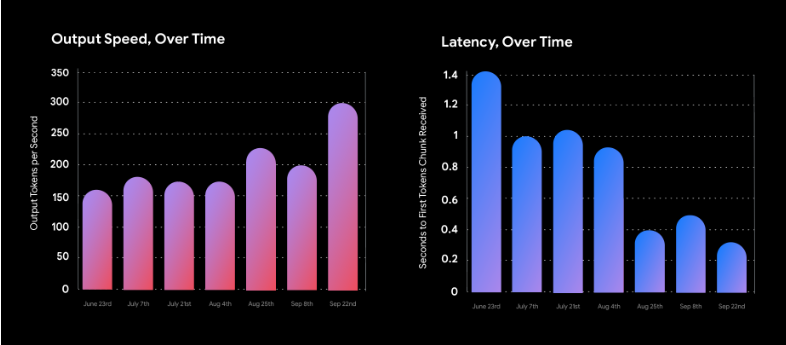

Tout d'abord, la réduction de prix est particulièrement remarquable. Le coût d'utilisation des nouveaux modèles est divisé par deux, soit une réduction de plus de 50 %. Simultanément, les performances ont été significativement améliorées. La vitesse de traitement de Gemini 1.5 Flash a doublé, tandis que celle de 1.5 Pro a presque triplé. Cela signifie que les développeurs peuvent obtenir des résultats plus rapides et des délais plus courts à moindre coût, améliorant ainsi considérablement leur efficacité.

En termes de performances, les nouveaux modèles Gemini affichent une amélioration globale. Les progrès sont particulièrement notables en mathématiques, en traitement de longs textes et en tâches visuelles. Par exemple, le modèle peut désormais traiter facilement des documents PDF de plus de 1000 pages, répondre à des questions contenant des dizaines de milliers de lignes de code et même extraire des informations utiles d'une vidéo d'une heure. Dans le test de référence MMLU-Pro, exigeant, le nouveau modèle a réalisé une amélioration des performances d'environ 7 %. Plus impressionnant encore, les améliorations atteignent 20 % dans les tests de référence MATH et HiddenMath.

Google a également optimisé la qualité des réponses du modèle. La nouvelle version, tout en garantissant la sécurité du contenu, fournit des réponses plus utiles et plus concises. Pour les tâches de résumé, de questions-réponses et d'extraction d'informations, la longueur des résultats a été réduite de 5 % à 20 %, ce qui améliore l'efficacité et réduit encore les coûts.

Pour les entreprises, la capacité de traitement de longs textes (jusqu'à 2 millions de mots) et les capacités multimodales de Gemini 1.5 Pro ouvrent de nouvelles perspectives d'application. À partir du 1er octobre 2024, les prix des jetons d'entrée, des jetons de sortie et des jetons de cache incrémental seront réduits respectivement de 64 %, 52 % et 64 %, ce qui réduira considérablement les coûts d'utilisation de l'IA pour les entreprises.

Google a également apporté des ajustements importants aux limitations d'utilisation. La limite de vitesse du service payant de Gemini 1.5 Flash est augmentée à 2000 requêtes par minute, et celle de 1.5 Pro à 1000, offrant ainsi aux développeurs une plus grande flexibilité.

La sécurité reste une priorité pour Google. Le nouveau modèle renforce la sécurité tout en suivant les instructions de l'utilisateur. Google a également ajusté les paramètres par défaut des filtres, donnant aux développeurs plus d'autonomie.

En outre, Google a lancé une version améliorée du modèle expérimental Gemini 1.5 Flash-8B, qui offre d'excellentes performances dans les applications textuelles et multimodales. Cette version est disponible sur Google AI Studio et l'API Gemini, offrant ainsi aux développeurs plus de choix.

Les utilisateurs de Gemini Advanced pourront bientôt profiter de la version Gemini 1.5 Pro-002 optimisée pour la conversation.