Dans le domaine de l'IA open source, l'écart avec les grandes entreprises technologiques ne se limite pas à la puissance de calcul. L'AI2 (anciennement Allen Institute for Artificial Intelligence) réduit cet écart grâce à une série d'initiatives révolutionnaires. Son dernier programme d'entraînement post-formation, Tülu3, rend la transformation des modèles linguistiques de base en systèmes IA pratiques accessible à tous.

Contrairement à la croyance populaire, les modèles linguistiques de base ne sont pas directement utilisables après la pré-formation. En réalité, le processus d'entraînement post-formation est l'étape clé qui détermine la valeur finale du modèle. C'est à ce stade qu'un modèle passe d'un réseau « omniscient » mais dépourvu de jugement à un outil pratique doté de fonctionnalités spécifiques.

Pendant longtemps, les grandes entreprises ont gardé secrètes leurs méthodes d'entraînement post-formation. Bien que quiconque puisse construire un modèle avec les dernières technologies, le faire fonctionner dans un domaine spécifique (comme le conseil psychologique ou l'analyse de recherche) nécessite des techniques d'entraînement post-formation uniques. Même des projets soi-disant « open source » comme Llama de Meta gardent secrètes l'origine de leur modèle initial et les méthodes d'entraînement générales.

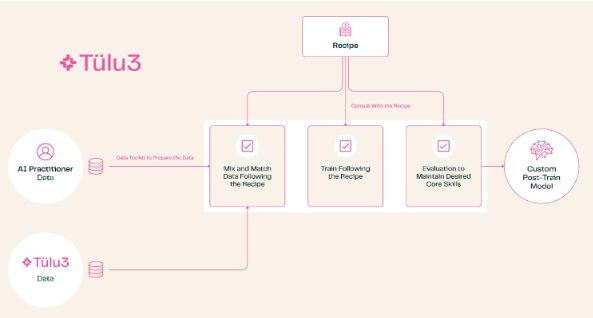

L'arrivée de Tülu3 change la donne. Cette solution complète d'entraînement post-formation couvre l'ensemble du processus, de la sélection du sujet à la gouvernance des données, en passant par l'apprentissage par renforcement et l'ajustement fin. Les utilisateurs peuvent adapter les capacités du modèle à leurs besoins, par exemple en renforçant les compétences en mathématiques et en programmation, ou en réduisant la priorité du traitement multilingue.

Les tests de l'AI2 montrent que les performances des modèles entraînés avec Tülu3 atteignent le niveau des meilleurs modèles open source. Cette percée est extrêmement importante : elle offre aux entreprises une option entièrement autonome et contrôlable. Pour les organismes qui travaillent avec des données sensibles, comme la recherche médicale, cela signifie qu'ils n'ont plus besoin de dépendre d'API tierces ou de services personnalisés. Ils peuvent effectuer l'entraînement complet en local, ce qui permet de réduire les coûts et de protéger la confidentialité.

L'AI2 a non seulement publié cette solution, mais l'a également utilisée en premier lieu dans ses propres produits. Bien que les résultats actuels des tests soient basés sur le modèle Llama, ils prévoient de lancer un nouveau modèle basé sur leur propre modèle OLMo et entraîné avec Tülu3. Il s'agira d'une solution véritablement open source de bout en bout.

Cette publication open source témoigne de la détermination de l'AI2 à promouvoir une IA démocratique et injecte une dose d'optimisme dans toute la communauté de l'IA open source. Elle nous rapproche d'un écosystème IA véritablement ouvert et transparent.