Le 26 décembre au soir, QuantEase a publié DeepSeek-V3, sa nouvelle génération de grands modèles linguistiques, marquant une avancée technologique remarquable. Ce modèle, basé sur une architecture MoE (Mixture of Experts), rivalise en termes de performances avec les meilleurs modèles propriétaires, tout en se distinguant par son faible coût et son efficacité, suscitant ainsi un vif intérêt de la part du secteur.

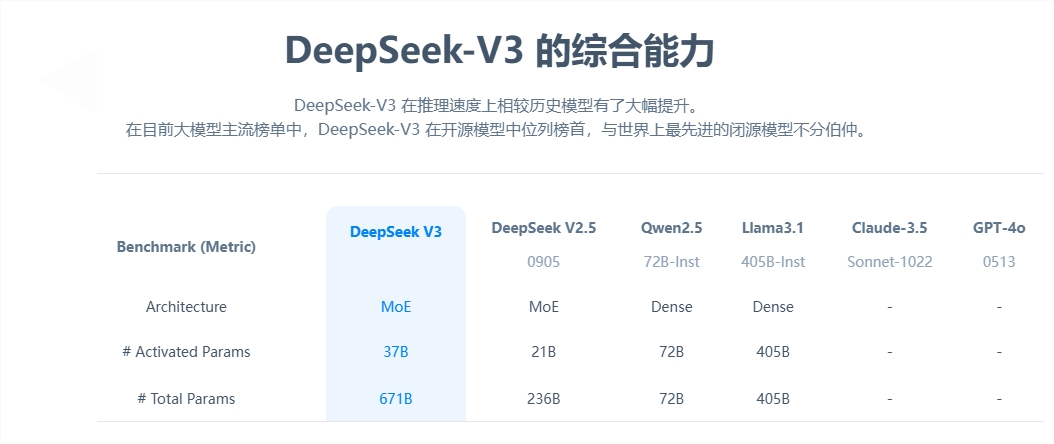

En termes de paramètres clés, DeepSeek-V3 possède 671 milliards de paramètres, dont 37 milliards de paramètres d'activation, et a été pré-entraîné sur 14,8 billions de jetons. Par rapport à son prédécesseur, la vitesse de génération du nouveau modèle est trois fois plus rapide, traitant 60 jetons par seconde, améliorant ainsi considérablement l'efficacité des applications concrètes.

En matière d'évaluation des performances, DeepSeek-V3 a démontré des capacités exceptionnelles. Il surpasse non seulement les modèles open source renommés tels que Qwen2.5-72B et Llama-3.1-405B, mais se positionne également au même niveau que GPT-4 et Claude-3.5-Sonnet lors de nombreux tests. Il a notamment obtenu des résultats exceptionnels en mathématiques, surpassant tous les modèles open source et propriétaires existants.

L'avantage le plus remarquable de DeepSeek-V3 réside dans son faible coût. Selon l'article scientifique open source, en calculant à 2 dollars par heure de GPU, le coût total d'entraînement du modèle s'élève à seulement 5,576 millions de dollars. Ce résultat révolutionnaire est dû à l'optimisation synergique des algorithmes, du framework et du matériel. Le co-fondateur d'OpenAI, Karpathy, a salué cette performance, soulignant que DeepSeek-V3 a atteint des performances supérieures à Llama3 en utilisant seulement 2,8 millions d'heures de GPU, soit une amélioration de l'efficacité de calcul d'environ 11 fois.

Sur le plan commercial, bien que le prix de l'API de DeepSeek-V3 ait légèrement augmenté par rapport à la génération précédente, il reste très compétitif. Le nouveau tarif est de 0,5 à 2 yuans par million de jetons d'entrée et de 8 yuans par million de jetons de sortie, soit un coût total d'environ 10 yuans chinois. À titre de comparaison, un service équivalent avec GPT-4 coûte environ 140 yuans chinois, soit une différence de prix considérable.

En tant que grand modèle entièrement open source, la publication de DeepSeek-V3 témoigne non seulement des progrès de la technologie IA chinoise, mais offre également aux développeurs et aux entreprises une solution IA performante et économique.