Dans le domaine de l'intelligence artificielle, l'équipe DeepSeek a récemment publié les résultats de ses dernières recherches, présentant un mécanisme d'attention clairsemée innovant appelé NSA (Native Sparse Attention). L'objectif principal de cette technologie est d'améliorer la vitesse d'entraînement et d'inférence pour les contextes longs, en particulier en optimisant pour le matériel moderne, ce qui permet une augmentation significative de l'efficacité de l'entraînement et de l'inférence.

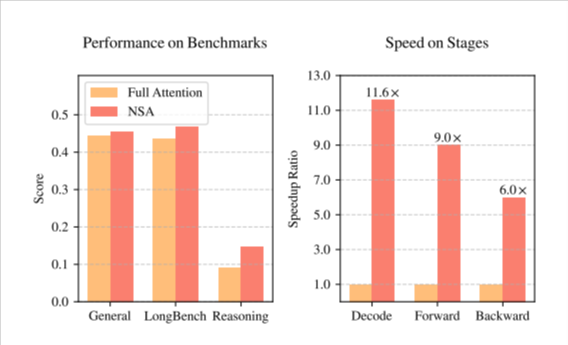

Le lancement de la technologie NSA a apporté des changements significatifs à l'entraînement des modèles d'intelligence artificielle. Tout d'abord, grâce à une série d'optimisations conçues pour les caractéristiques du matériel informatique moderne, elle améliore considérablement la vitesse d'inférence et réduit efficacement le coût de pré-entraînement. Plus important encore, tout en augmentant la vitesse et en réduisant les coûts, la NSA maintient un niveau élevé de performance du modèle, garantissant que les performances du modèle ne sont pas affectées dans diverses tâches.

Dans ses recherches, l'équipe DeepSeek a adopté une stratégie clairsemée hiérarchique, divisant le mécanisme d'attention en trois branches : compression, sélection et fenêtre glissante. Cette conception permet au modèle de capturer simultanément le contexte global et les détails locaux, améliorant ainsi sa capacité à traiter les longs textes. De plus, les optimisations de la NSA en termes d'accès mémoire et d'ordonnancement des calculs permettent de réduire considérablement le délai de calcul et la consommation de ressources pour l'entraînement sur des contextes longs.

Dans une série de tests de référence courants, la NSA a démontré ses performances exceptionnelles. En particulier pour les tâches à long contexte et l'inférence basée sur des instructions, les performances de la NSA sont comparables, voire supérieures dans certains cas, à celles des modèles d'attention complète. Le lancement de cette technologie marque un nouveau bond en avant dans les techniques d'entraînement et d'inférence de l'IA, et donnera une nouvelle impulsion au développement futur de l'intelligence artificielle.

Article de recherche NSA (https://arxiv.org/pdf/2502.11089v1).

Points clés :

🌟 Le lancement de la technologie NSA améliore considérablement la vitesse d'entraînement et d'inférence pour les contextes longs, et réduit le coût de pré-entraînement.

🛠️ Elle adopte une stratégie clairsemée hiérarchique, divisant le mécanisme d'attention en compression, sélection et fenêtre glissante, améliorant ainsi la capacité du modèle à traiter les longs textes.

📈 Dans plusieurs tests de référence, la NSA a démontré des performances exceptionnelles, surpassant dans certains cas les modèles d'attention complète traditionnels.