Dans le domaine de l'intelligence artificielle, le développement rapide des modèles linguistiques a suscité un intérêt considérable pour les modèles linguistiques de compréhension vocale (SULMs). Récemment, le laboratoire ASLP de l'Université de Technologie du Nord-Ouest a publié le modèle de compréhension vocale ouvert OSUM, visant à explorer comment entraîner et utiliser efficacement les modèles de compréhension vocale dans un contexte de ressources académiques limitées, afin de stimuler la recherche et l'innovation dans le milieu universitaire.

Le modèle OSUM intègre l'encodeur Whisper et le modèle linguistique Qwen2, prenant en charge 8 tâches vocales, notamment la reconnaissance vocale (ASR), la reconnaissance vocale avec horodatage (SRWT), la détection d'événements vocaux (VED), la reconnaissance d'émotions vocales (SER), la reconnaissance du style de parole (SSR), la classification du sexe du locuteur (SGC), la prédiction de l'âge du locuteur (SAP) et la conversation de transcription vocale (STTC). Grâce à la stratégie d'entraînement ASR+X, le modèle peut optimiser efficacement et de manière stable la reconnaissance vocale tout en effectuant les tâches cibles, améliorant ainsi les capacités d'apprentissage multitâches.

La publication du modèle OSUM met non seulement l'accent sur les performances, mais aussi sur la transparence. Sa méthode d'entraînement et le processus de préparation des données sont ouverts, afin de fournir une référence et des conseils précieux au monde universitaire. Selon le rapport technique v2.0, le volume de données d'entraînement du modèle OSUM a été augmenté à 50,5 K heures, soit une augmentation significative par rapport aux 44,1 K heures précédentes. Cela inclut 3000 heures de données de classification du sexe du locuteur et 6800 heures de données de prédiction de l'âge du locuteur. Cette extension des données a permis d'améliorer les performances du modèle dans diverses tâches.

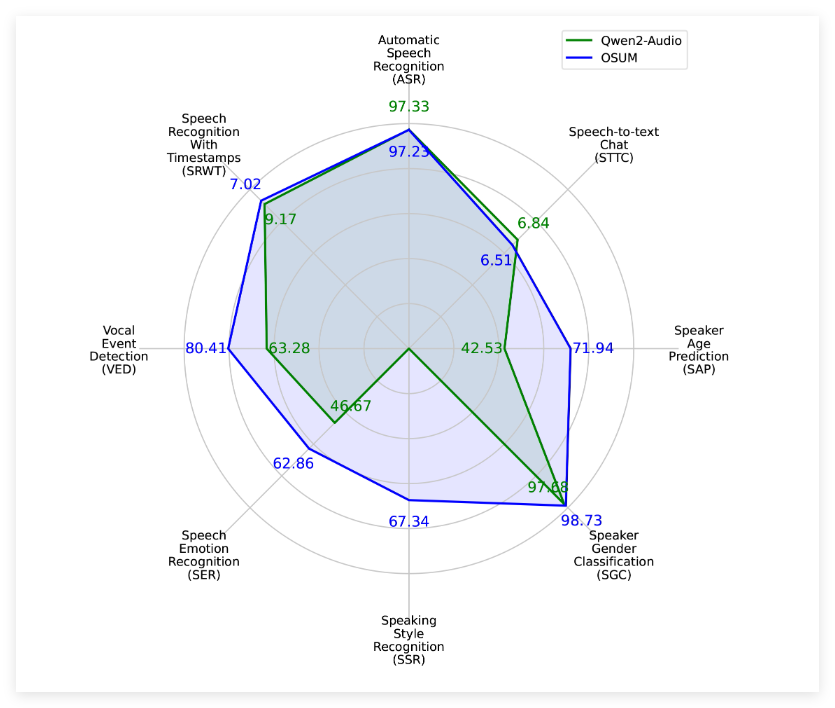

Selon les résultats de l'évaluation, OSUM surpasse le modèle Qwen2-Audio sur plusieurs tâches, même avec des ressources de calcul et des données d'entraînement nettement inférieures. Les résultats d'évaluation concernent non seulement les ensembles de tests publics, mais aussi les ensembles de tests internes, démontrant les bonnes performances du modèle OSUM dans les tâches de compréhension vocale.

Le laboratoire ASLP de l'Université de Technologie du Nord-Ouest indique que l'objectif d'OSUM est de promouvoir le développement de technologies de pointe en matière de compréhension vocale grâce à une plateforme de recherche ouverte. Les chercheurs et les développeurs peuvent utiliser librement le code et les poids du modèle, même à des fins commerciales, accélérant ainsi l'application et la diffusion de la technologie.

Accès au projet : https://github.com/ASLP-lab/OSUM?tab=readme-ov-file

Points clés :

🌟 Le modèle OSUM combine l'encodeur Whisper et le modèle linguistique Qwen2, prenant en charge plusieurs tâches vocales et facilitant l'apprentissage multitâches.

📊 Dans le rapport technique v2.0, le volume de données d'entraînement d'OSUM a atteint 50,5 K heures, améliorant ainsi les performances du modèle.

🆓 Le code et les poids du modèle sont disponibles sous licence Apache2.0, encourageant une utilisation large par le milieu universitaire et l'industrie.