Dans le domaine de l'intelligence artificielle multimodale, l'Institut de recherche sur l'intelligence artificielle (AIRS) et plusieurs universités ont collaboré pour lancer le nouveau modèle vectoriel multimodal BGE-VL, marquant une avancée majeure dans les techniques de recherche multimodale. Depuis sa sortie, la série de modèles BGE a été saluée, et le lancement de BGE-VL enrichit encore cet écosystème. Ce modèle excelle dans plusieurs tâches clés, telles que la recherche d'images et de texte et la recherche d'images combinées, démontrant ainsi ses performances exceptionnelles.

Le succès de BGE-VL est dû à la technologie de synthèse de données MegaPairs qui le sous-tend. Cette méthode innovante exploite les données existantes à grande échelle d'images et de texte pour générer automatiquement des données de triplets multimodaux de haute qualité, améliorant ainsi considérablement l'évolutivité et la qualité des données. MegaPairs permet de générer des ensembles de données diversifiés à très faible coût, contenant plus de 26 millions d'échantillons, fournissant ainsi une base solide pour l'entraînement des modèles de recherche multimodale. Cette technologie a permis à BGE-VL d'obtenir des résultats de pointe sur plusieurs benchmarks de recherche multimodale.

À l'heure où la recherche multimodale est de plus en plus importante, les besoins des utilisateurs en matière d'accès à l'information sont de plus en plus diversifiés. Les modèles de recherche précédents reposaient principalement sur des paires image-texte pour l'entraînement, ce qui les empêchait de gérer efficacement les entrées combinées complexes. BGE-VL, grâce à l'intégration des données MegaPairs, surmonte cette limitation, permettant au modèle de comprendre et de traiter plus complètement les requêtes multimodales.

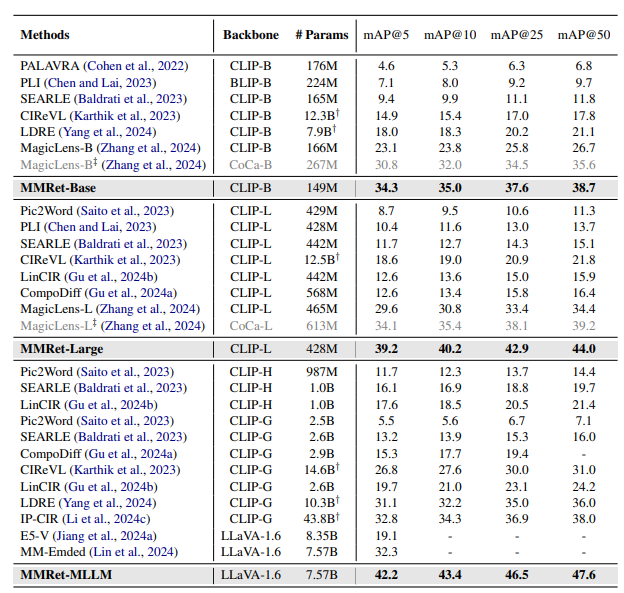

L'équipe de l'AIRS a constaté lors des évaluations de performance sur plusieurs tâches que le modèle BGE-VL présentait d'excellentes performances en zéro-shot sur le Massive Multimodal Embedding Benchmark (MMEB). Bien que MegaPairs ne couvre pas la plupart des tâches du MMEB, sa capacité de généralisation des tâches est impressionnante. De plus, lors des évaluations de recherche d'images combinées, BGE-VL s'est également distingué, surpassant largement de nombreux modèles connus, tels que MagicLens de Google et MM-Embed de Nvidia.

À l'avenir, l'Institut de recherche sur l'intelligence artificielle prévoit de continuer à développer la technologie MegaPairs, en intégrant des scénarios de recherche multimodale plus riches, afin de créer un système de recherche multimodale plus complet et efficace, offrant ainsi aux utilisateurs un service d'information plus précis. Avec le développement des technologies multimodales, le lancement de BGE-VL contribuera sans aucun doute à stimuler l'exploration et l'innovation dans ce domaine.

Adresse de l'article : https://arxiv.org/abs/2412.14475

Page du projet : https://github.com/VectorSpaceLab/MegaPairs

Adresse du modèle : https://huggingface.co/BAAI/BGE-VL-MLLM-S1