Dans le domaine de l'informatique, la transformation de documents complexes en données structurées reste un défi majeur. Les anciennes méthodes, soit reposaient sur des modèles complexes et des processus élaborés, soit nécessitaient des modèles multimodaux gigantesques, sujets aux hallucinations et extrêmement coûteux.

Cependant, SmolDocling, un modèle vision-langage (VLM) open source de seulement 256M de paramètres, développé conjointement par IBM et Hugging Face, vise à résoudre de manière intégrale la tâche de conversion de documents multimodaux.

Les secrets de SmolDocling

SmolDocling se distingue par sa taille compacte et ses performances exceptionnelles. Contrairement aux grands modèles disposant de dizaines ou de centaines de milliards de paramètres, SmolDocling, avec ses seulement 256 Mo, est un véritable poids plume, réduisant considérablement la complexité de calcul et les besoins en ressources. Plus impressionnant encore, il peut traiter une page entière avec un seul modèle, simplifiant ainsi les processus complexes des méthodes traditionnelles.

Bien sûr, sa petite taille ne signifie pas une faiblesse. SmolDocling possède une arme secrète : DocTags, un format de balisage universel permettant de capturer avec précision et de manière concise les éléments d'une page, leur structure et leur contexte spatial. Imaginez que chaque élément du document est étiqueté clairement, permettant à la machine de comprendre précisément la logique interne du document.

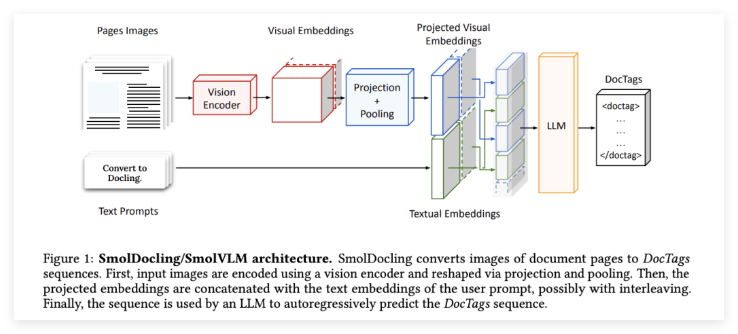

L'architecture de SmolDocling est basée sur SmolVLM-256M de Hugging Face. Grâce à une tokenisation optimisée et à une méthode de compression agressive des caractéristiques visuelles, la complexité de calcul est considérablement réduite. Son principal atout réside dans le format innovant DocTags, qui permet de séparer clairement la mise en page du document, le contenu textuel et les informations visuelles telles que les tableaux, les formules, les extraits de code et les graphiques. Pour une formation plus efficace, SmolDocling utilise l'apprentissage par curriculum, en « gelant » d'abord l'encodeur visuel, puis en utilisant progressivement des ensembles de données plus riches pour l'ajuster et améliorer l'alignement sémantique visuel entre les différents éléments du document. Plus surprenant encore, grâce à son efficacité, SmolDocling traite une page de document en une moyenne de 0,35 seconde sur un GPU grand public, ne consommant que moins de 500 Mo de mémoire vidéo.

Un petit modèle qui surpasse les géants

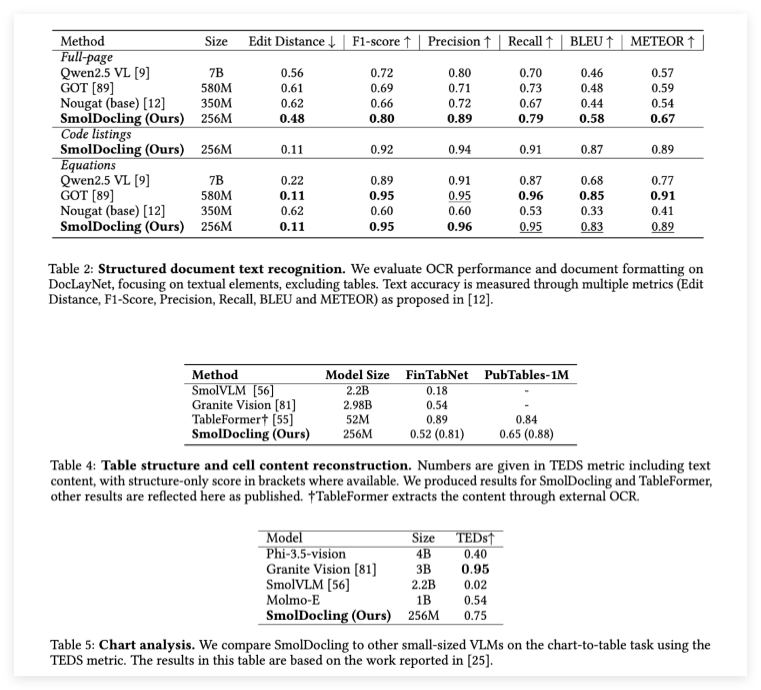

Les résultats parlent d'eux-mêmes : SmolDocling a prouvé ses performances lors de tests. Dans des tests comparatifs portant sur diverses tâches de conversion de documents, SmolDocling a largement surpassé de nombreux modèles concurrents plus volumineux. Par exemple, pour la tâche d'OCR sur des documents entiers, SmolDocling a obtenu une précision nettement supérieure à celle de Qwen2.5VL (7 milliards de paramètres) et de Nougat (350 millions de paramètres), avec une distance d'édition (0,48) plus faible et un score F1 (0,80) plus élevé.

En matière de transcription de formules, SmolDocling a atteint un score F1 de 0,95, comparable aux modèles les plus avancés tels que GOT. Plus impressionnant encore, SmolDocling a établi une nouvelle référence dans l'identification d'extraits de code, avec une précision et un rappel atteignant respectivement 0,94 et 0,91. Un véritable petit modèle aux performances exceptionnelles dans tous les domaines clés !

Maîtrise de tous les aspects : les documents complexes ne lui font pas peur

SmolDocling se différencie des autres solutions d'OCR par sa capacité à traiter divers éléments complexes des documents, notamment le code, les graphiques, les formules et les différentes mises en page. Ses compétences ne se limitent pas aux articles scientifiques courants ; il peut également traiter de manière fiable les brevets, les tableaux et les documents commerciaux.

Grâce à DocTags qui fournit des métadonnées structurées complètes, SmolDocling élimine les ambiguïtés inhérentes aux formats tels que HTML ou Markdown, améliorant ainsi l'utilisabilité en aval de la conversion de documents. Sa taille compacte lui permet également de réaliser un traitement par lots à grande échelle avec des besoins en ressources extrêmement faibles, offrant une solution économique et efficace pour les déploiements à grande échelle. Cela signifie que les entreprises n'auront plus à se soucier des coûts de calcul élevés et des processus complexes lors du traitement de grands volumes de documents complexes.

En résumé, la sortie de SmolDocling représente une avancée majeure dans la technologie de conversion de documents. Il démontre clairement que les modèles compacts peuvent non seulement rivaliser avec les grands modèles de base, mais aussi les surpasser considérablement dans des tâches clés.

Les chercheurs ont démontré avec succès que, grâce à une formation ciblée, à une augmentation de données innovante et à de nouveaux formats de balisage comme DocTags, il est possible de surmonter les limitations traditionnellement associées à la taille et à la complexité des modèles. La publication en open source de SmolDocling établit non seulement de nouvelles normes d'efficacité et de polyvalence pour la technologie OCR, mais fournit également à la communauté une ressource précieuse grâce à des ensembles de données ouverts et une architecture de modèle compacte et efficace.