IBM ने मई में व्यावसायिक अनुप्रयोगों के लिए Granite13B LLM मॉडल को ओपन-सोर्स किया। अब, IBM के एआई प्लेटफॉर्म उत्पाद के उपाध्यक्ष आर्मंड रुइज़ (Armand Ruiz) ने Granite13B को प्रशिक्षित करने के लिए उपयोग किए गए व्यापक 6.48TB डेटा सेट की पूरी सामग्री को सार्वजनिक किया है।

यह डेटा सेट सख्त पूर्व-प्रसंस्करण के बाद 2.07TB में संकुचित किया गया है, जो 68% की कमी दर्शाता है। रुइज़ ने जोर देकर कहा कि यह कदम उच्च गुणवत्ता, पूर्वाग्रह-मुक्त, नैतिक और कानूनी रूप से अनुपालन डेटा सेट सुनिश्चित करने के लिए महत्वपूर्ण है, ताकि व्यावसायिक अनुप्रयोगों की आवश्यकताओं को पूरा किया जा सके।

डेटा सेट कई स्रोतों से सावधानीपूर्वक तैयार किया गया है, जिसमें शामिल हैं:

- arXiv: 240 से अधिक वैज्ञानिक पेपर के प्रीप्रिंट।

- Common Crawl: एक खुला वेब क्रॉलिंग डेटाबेस।

- DeepMind Mathematics: गणितीय प्रश्न और उत्तर।

- Free Law: अमेरिका के न्यायालयों से सार्वजनिक डोमेन कानूनी राय।

- GitHub Clean: CodeParrot से कोड डेटा।

- Hacker News: 2007-2018 तक के कंप्यूटर विज्ञान और उद्यमिता समाचार।

- OpenWeb Text: OpenAI के वेब टेक्स्ट कॉर्पस का ओपन-सोर्स संस्करण।

- Project Gutenberg (PG-19): प्रारंभिक कार्यों पर केंद्रित मुफ्त ई-बुक्स।

- Pubmed Central: जैव चिकित्सा और जीवन विज्ञान पत्रिकाएँ।

- SEC Filings: अमेरिका के सिक्योरिटीज एंड एक्सचेंज कमीशन (SEC) के 10-K/Q फाइलिंग दस्तावेज़ (1934-2022)।

- Stack Exchange: Stack Exchange नेटवर्क पर उपयोगकर्ता द्वारा योगदान की गई सामग्री।

- USPTO: 1975 से 2023 मई तक जारी किए गए अमेरिकी पेटेंट।

- Webhose: असंरचित वेब सामग्री को मशीन-रीडेबल डेटा में परिवर्तित करना।

- Wikimedia: आठ अंग्रेजी विकिमीडिया परियोजनाएँ।

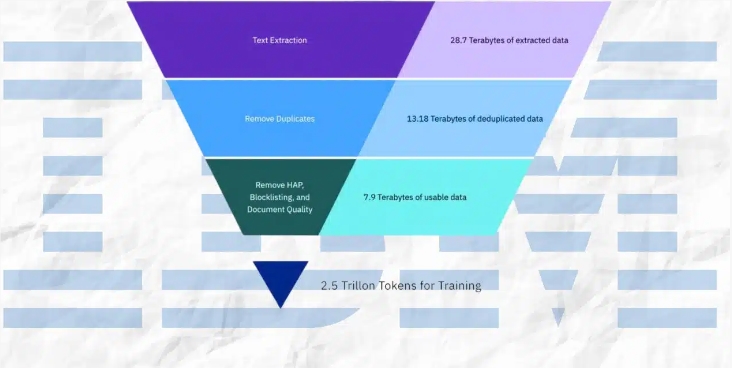

पूर्व-प्रसंस्करण प्रक्रिया में टेक्स्ट निष्कर्षण, डुप्लिकेट हटाना, भाषा पहचान, वाक्य विभाजन, नफरत, दुर्व्यवहार और गंदे शब्दों का लेबलिंग, दस्तावेज़ गुणवत्ता लेबलिंग, URL छिपाने का लेबलिंग, फ़िल्टरिंग और टोकनाइजेशन शामिल हैं।

इन चरणों में सेट थ्रेशोल्ड के आधार पर लेबलिंग और फ़िल्टरिंग शामिल हैं, यह सुनिश्चित करते हुए कि अंतिम डेटा सेट मॉडल प्रशिक्षण के लिए उच्चतम गुणवत्ता का हो।

IBM ने Granite कोड मॉडल के चार संस्करण जारी किए हैं, जिनके पैरामीटर 3 बिलियन से 34 बिलियन के बीच हैं। इन मॉडलों का एक श्रृंखला के बेंचमार्क परीक्षणों में परीक्षण किया गया है और कई कार्यों में अन्य तुलनीय मॉडलों, जैसे Code Llama और Llama3, को पार कर लिया है।

मुख्य बिंदु:

⭐ IBM ने Granite13B LLM मॉडल के प्रशिक्षण के लिए पूरा 6.48TB डेटा सेट जारी किया।

⭐ डेटा सेट को सख्त पूर्व-प्रसंस्करण के बाद 2.07TB में संकुचित किया गया है, जो 68% की कमी दर्शाता है।

⭐ IBM ने Granite कोड मॉडल के चार संस्करण जारी किए हैं, जिनके पैरामीटर 3 बिलियन से 34 बिलियन के बीच हैं।