3D डिजिटल मानव क्षेत्र में, हालांकि महत्वपूर्ण प्रगति हुई है, पूर्व की विधियों में बहु-दृश्य संगति और भावनात्मक अभिव्यक्ति की कमी की समस्याएँ अभी भी मौजूद हैं। इन चुनौतियों को हल करने के लिए, नानजिंग विश्वविद्यालय, फुदान विश्वविद्यालय और हुआवेई नोआह आर्क लैब के शोध टीम ने एक नई सफलता प्राप्त की है।

उत्पाद प्रवेश: https://nju-3dv.github.io/projects/EmoTalk3D/

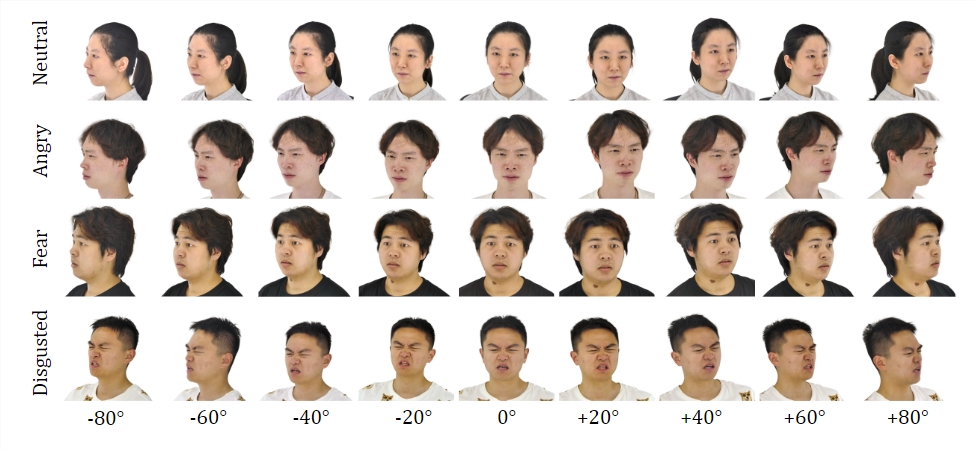

उन्होंने कैलिब्रेटेड मल्टी-एंगल वीडियो, भावनात्मक लेबलिंग और फ्रेम-बाय-फ्रेम 3D ज्योमेट्री के साथ EmoTalk3D डेटासेट इकट्ठा किया। और एक नई विधि प्रस्तुत की है जो नियंत्रित भावनाओं के साथ 3D बोलते अवतार बनाने के लिए है, जिसमें होंठ समन्वय और रेंडरिंग गुणवत्ता में महत्वपूर्ण सुधार हुआ है।

डेटासेट:

EmoTalk3D डेटासेट पर प्रशिक्षण के माध्यम से, शोध टीम ने "ध्वनि से ज्योमेट्री फिर रूप" का एक मैपिंग फ्रेमवर्क बनाया। पहले, ऑडियो विशेषताओं से यथार्थवादी 3D ज्योमेट्री अनुक्रम का पूर्वानुमान किया गया, फिर पूर्वानुमानित ज्योमेट्री के आधार पर 4D गॉसियन द्वारा प्रस्तुत 3D बोलते अवतार की उपस्थिति का निर्माण किया गया। उपस्थिति को मानक और गतिशील गॉसियन में विभाजित किया गया, जो बहु-दृश्य वीडियो से सीखा गया और मुक्त दृष्टिकोण के बोलते अवतार एनीमेशन को प्रस्तुत करने के लिए संयोजित किया गया।

यह मॉडल उत्पन्न बोलते अवतार में नियंत्रित भावनाओं को लागू कर सकता है और व्यापक दृष्टिकोण में रेंडरिंग कर सकता है। जबकि झुर्रियों और सूक्ष्म भावनाओं जैसे गतिशील चेहरे की विशेषताओं को पकड़ते हुए होंठ आंदोलन उत्पन्न करने में सुधार की रेंडरिंग गुणवत्ता और स्थिरता प्रदर्शित करता है। उत्पन्न परिणामों के उदाहरण में, 3D डिजिटल मानव के खुशी, गुस्सा, और निराशा के भाव को सटीकता से प्रदर्शित किया गया है।

इसकी समग्र प्रक्रिया में पांच मॉड्यूल शामिल हैं:

पहला, भावनात्मक सामग्री डीकोडिंग एन्कोडर, जो इनपुट ध्वनि से सामग्री और भावनात्मक विशेषताओं को解析 करता है; दूसरा, ध्वनि से ज्योमेट्री नेटवर्क, जो विशेषताओं से गतिशील 3D बिंदु बादल का पूर्वानुमान करता है; तीसरा, गॉसियन ऑप्टिमाइजेशन और पूर्णता मॉड्यूल, मानक उपस्थिति स्थापित करता है; चौथा, ज्योमेट्री से उपस्थिति नेटवर्क, जो गतिशील 3D बिंदु बादल के आधार पर चेहरे की उपस्थिति का निर्माण करता है; पांचवां, रेंडरिंग मॉड्यूल, गतिशील गॉसियन को मुक्त दृष्टिकोण एनीमेशन में रेंडर करता है।

इसके अलावा, उन्होंने EmoTalk3D डेटासेट स्थापित किया है, जो एक भावनात्मक लेबलिंग बहु-दृश्य बोलते अवतार डेटासेट है जिसमें फ्रेम-बाय-फ्रेम 3D चेहरे का आकार है, और इसे गैर-व्यावसायिक अनुसंधान उद्देश्यों के लिए जनता के लिए खोला जाएगा।

मुख्य बिंदु:

💥 नियंत्रित भावनाओं वाले डिजिटल मानव के निर्माण के लिए नई विधि प्रस्तुत की गई।

🎯 "ध्वनि से ज्योमेट्री फिर रूप" का मैपिंग फ्रेमवर्क बनाया गया।

👀 EmoTalk3D डेटासेट स्थापित किया गया और इसे खोला जा रहा है।