इस सूचना विस्फोट के युग में, हम हर दिन तस्वीरों और वीडियो के माध्यम से जीवन को रिकॉर्ड करते हैं और खुशी साझा करते हैं। लेकिन क्या आपने कभी सोचा है, यदि ऐसी कोई तकनीक हो, जो मशीनों को मानव की तरह न केवल इन तस्वीरों और वीडियो को समझने में सक्षम बनाए, बल्कि हमारे साथ गहरे संवाद करने में भी सक्षम हो, तो क्या होगा?

अली टीम द्वारा हाल ही में जारी किया गया सामान्य बहु-मोडल बड़ा मॉडल mPLUG-Owl3, अपनी आश्चर्यजनक दक्षता और समझने की क्षमता के साथ, हमें 4 सेकंड में 2 घंटे की फिल्म "देखने" की अनुमति देता है! यह केवल एक मॉडल नहीं है, बल्कि एक ऐसा AI सहायक है जो देख सकता है, सुन सकता है, बोल सकता है और सोच सकता है।

mPLUG-Owl3, यह नाम सुनने में एक चश्मा पहने उल्लू की तरह लगता है, जो बुद्धिमान और सतर्क है। इसकी मुख्य क्षमता, लंबी छवि अनुक्रमों को समझने में है। चाहे वह एक श्रृंखला की तस्वीरें हों, या एक वीडियो, यह इसके भीतर की सामग्री को समझ सकता है, यहां तक कि इसके कहानी के धागे को भी।

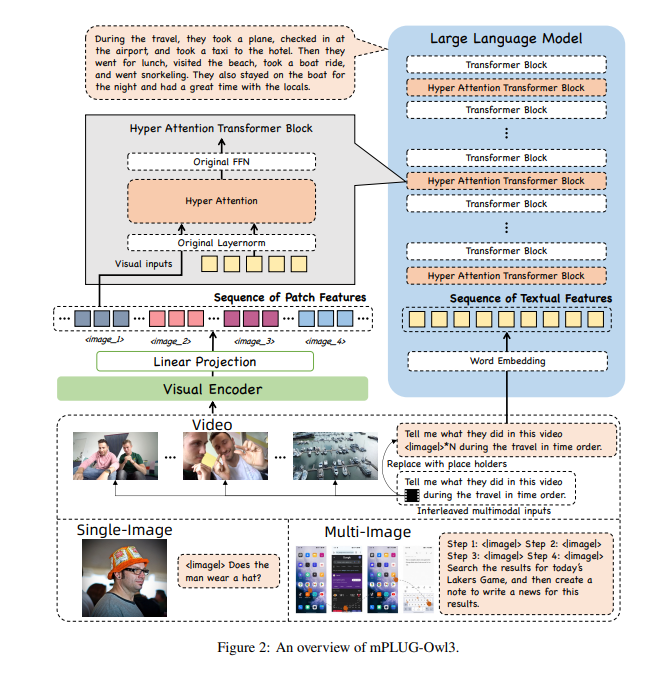

mPLUG-Owl3 को इतनी सारी जानकारी को संभालने के लिए, शोधकर्ताओं ने इसे एक सुपर दिमाग - सुपर अटेंशन मॉड्यूल से लैस किया है। यह मॉड्यूल AI का सुपर दिमाग की तरह है, जो एक साथ दृश्य और भाषाई जानकारी को संसाधित कर सकता है, जिससे AI छवियों को समझने के साथ-साथ संबंधित पाठ जानकारी को भी समझ सकता है।

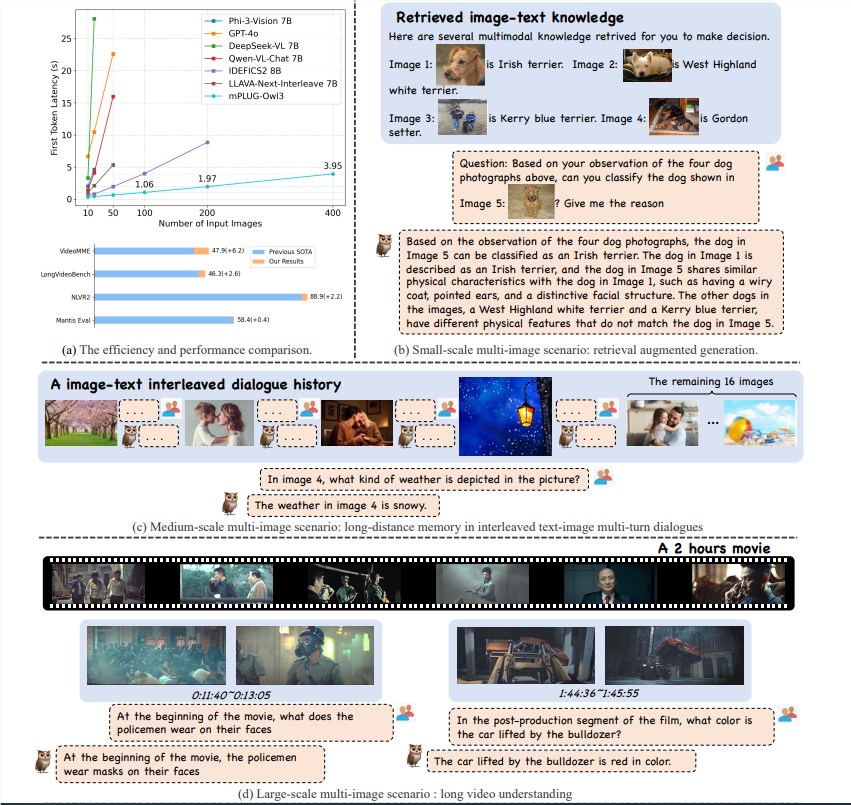

mPLUG-Owl3 मॉडल ने अपनी उत्कृष्ट अनुमान दक्षता के साथ बहु-मोडल समझने के क्षेत्र में महत्वपूर्ण प्रगति की है। यह न केवल एकल छवि, कई छवियों, वीडियो आदि के विभिन्न परिदृश्यों में SOTA (State of the Art) पर पहुंचा है, बल्कि पहले टोकन की देरी को 6 गुना कम किया है, और एक A100 ग्राफिक्स कार्ड पर संसाधित की जाने वाली छवियों की संख्या 8 गुना बढ़कर 400 हो गई है।

mPLUG-Owl3 सटीकता से आने वाले बहु-मोडल ज्ञान को समझ सकता है और प्रश्नों का उत्तर देने के लिए इसका उपयोग कर सकता है। यह आपको यह भी बता सकता है कि यह किस ज्ञान के आधार पर अपना निर्णय कर रहा है, साथ ही इसके निर्णय का विस्तृत आधार।

mPLUG-Owl3 विभिन्न सामग्रियों में सामग्री संबंधों को सही ढंग से समझ सकता है और गहन तर्क कर सकता है। चाहे वह शैली में भिन्नता हो या पात्र पहचान, यह आसानी से इसका सामना कर सकता है।

mPLUG-Owl3 2 घंटे तक के वीडियो को देख सकता है और 4 सेकंड में उपयोगकर्ता के प्रश्नों का उत्तर देना शुरू कर सकता है, चाहे प्रश्न वीडियो के किस भाग से संबंधित हो।

mPLUG-Owl3 ने हल्के Hyper Attention मॉड्यूल का उपयोग किया है, जो Transformer Block को एक नए मॉड्यूल में विस्तारित करता है जो छवि-टेक्स्ट विशेषताओं के पारस्परिक और पाठ मॉडलिंग को सक्षम बनाता है। इस डिज़ाइन ने नए पैरामीटर को जोड़ने की अतिरिक्त आवश्यकता को काफी कम कर दिया है, जिससे मॉडल को प्रशिक्षित करना आसान हो गया है, और प्रशिक्षण और अनुमान दक्षता में भी सुधार हुआ है।

व्यापक डेटा सेट पर प्रयोग करते हुए, mPLUG-Owl3 ने अधिकांश एकल छवि बहु-मोडल बेंचमार्क पर SOTA परिणाम प्राप्त किए हैं। कई छवियों के मूल्यांकन में, यह विशेष रूप से कई छवि परिदृश्यों के लिए अनुकूलित मॉडल को पार कर गया है। LongVideoBench पर, इसने मौजूदा मॉडलों को भी पीछे छोड़ दिया, जो लंबी वीडियो समझने में इसकी उत्कृष्ट क्षमता को दर्शाता है।

अली का mPLUG-Owl3 का विमोचन केवल तकनीकी दृष्टि से एक छलांग नहीं है, बल्कि बहु-मोडल बड़े मॉडल के अनुप्रयोग के लिए नई संभावनाएं प्रदान करता है। जैसे-जैसे तकनीक में निरंतर सुधार होता है, हम भविष्य में mPLUG-Owl3 से अधिक आश्चर्य की उम्मीद करते हैं।

पेपर का पता: https://arxiv.org/pdf/2408.04840

कोड: https://github.com/X-PLUG/mPLUG-Owl/tree/main/mPLUG-Owl3

ऑनलाइन अनुभव: https://huggingface.co/spaces/mPLUG/mPLUG-Owl3