एंटी ग्रुप के तहत CodeFuse कोड मॉडल ने ModelCache बड़े मॉडल के अर्थ कैश को ओपन-सोर्स किया है, जिससे बड़े मॉडल अनुप्रयोगों के इनफेरेंस लागत को कम किया जा सके और उपयोगकर्ता अनुभव को बढ़ाया जा सके। ModelCache की संरचना में adapter, embedding, similarity और data_manager मॉड्यूल शामिल हैं, जो पाठ को अर्थ वेक्टर प्रतिनिधित्व में परिवर्तित कर सकते हैं और वेक्टर की समानता रैंकिंग और मूल्यांकन कर सकते हैं। ModelCache के ऑनलाइन प्रभाव आंकड़े बताते हैं कि कैश हिट होने पर औसत समय में 10 गुना कमी आ सकती है, और गति दर 14.5% तक पहुंच सकती है। भविष्य में, ModelCache प्रदर्शन और सटीकता को अनुकूलित करना जारी रखेगा, ताकि पुनः प्राप्ति समय और सटीकता को बढ़ाया जा सके।

संबंधित AI समाचार अनुशंसाएँ

एंट ग्रुप ने 2024 टेक्नोलॉजी इकोसिस्टम श्वेत पत्र जारी किया: एआई पेटेंट में बड़े पैमाने पर सुधार

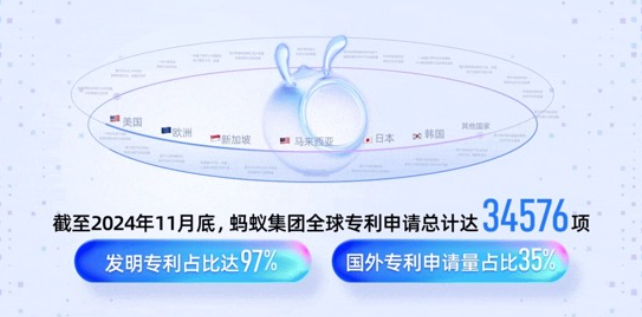

एंट ग्रुप ने अपने तकनीकी आधिकारिक वीबो पर 2024 टेक्नोलॉजी इकोसिस्टम श्वेत पत्र जारी किया। इस श्वेत पत्र के आंकड़े 2024 के नवंबर के अंत तक अपडेट किए गए हैं, जिसमें पेटेंट, ओपन-सोर्स, मानक, पत्र और उद्योग-अकादमिक अनुसंधान के पांच क्षेत्रों को कवर किया गया है। डेटा दर्शाता है कि पिछले एक वर्ष में, एंट ग्रुप ने टेक्नोलॉजी अनुसंधान और विकास में लगातार निवेश बढ़ाया है, विशेष रूप से कृत्रिम बुद्धिमत्ता (एआई) के क्षेत्र में, टेक्नोलॉजी इकोसिस्टम की व्यापकता और गहराई को निरंतर विस्तारित किया है। 2024 के नवंबर के अंत तक, एंट ग्रुप की वैश्विक पेटेंट आवेदन संख्या 34,576 है, जिसमें आविष्कार पेटेंट के हिस्से को 97% तक पहुंच गया है।

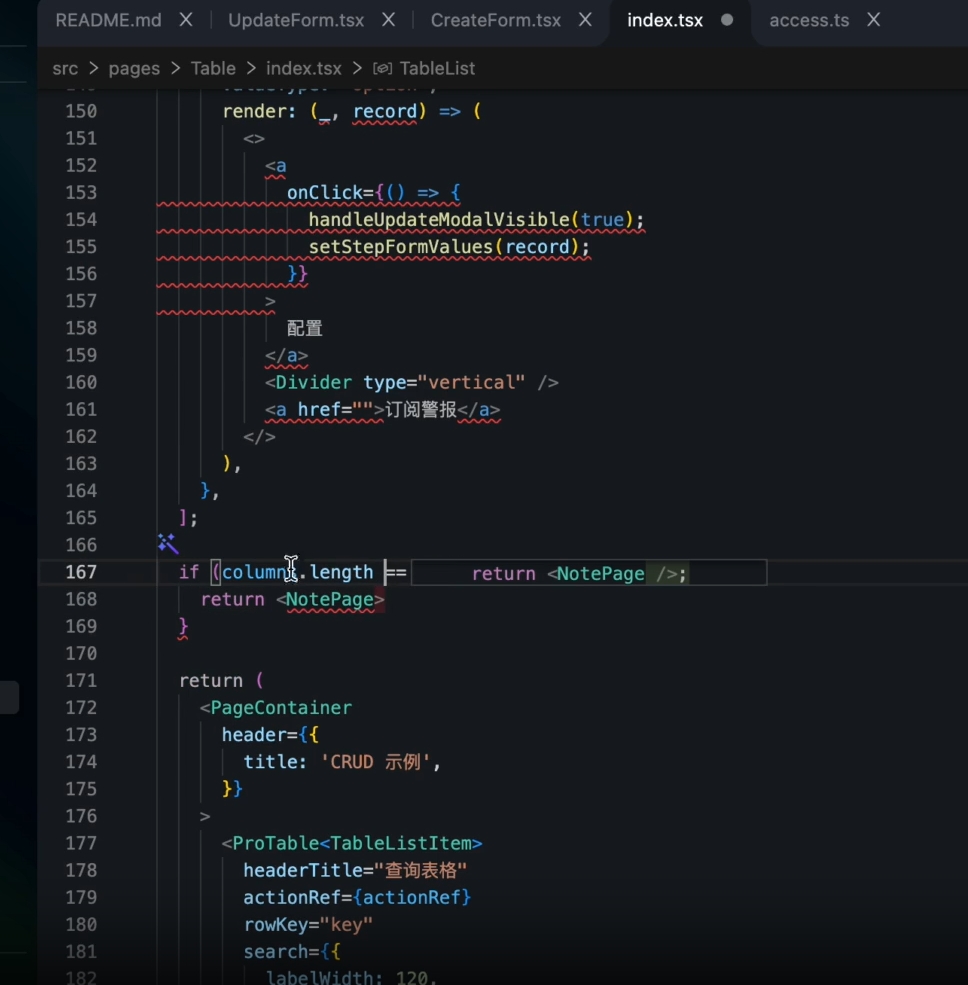

मंटी CodeFuse IDE 0.7 संस्करण जारी, Lint Error स्मार्ट पुनर्लेखन का समर्थन करता है

मंटी ग्रुप का AI IDE - CodeFuse IDE हाल ही में 0.7 संस्करण जारी किया गया है, यह संस्करण मुख्य रूप से Lint Error प्रकार के स्मार्ट पुनर्लेखन की क्षमता को बढ़ाता है और zsh प्रकार के टर्मिनल के लिए प्राकृतिक भाषा उत्पन्न कमांड के समर्थन का विस्तार करता है। CodeFuse IDE एक कृत्रिम बुद्धिमत्ता एकीकृत विकास वातावरण है जो मंटी द्वारा विकसित किए गए बड़े मॉडल CodeFuse और आईडीई ढाँचे OpenSumi पर आधारित है, यह प्रमुख प्रोग्रामिंग भाषाओं का समर्थन करता है और विकास प्रक्रिया के दौरान कोड लेखन सुझाव प्रदान करता है。

एंट ग्रुप की डेटा विज्ञान ने पहला मिलियन-स्तरीय उच्च गुणवत्ता वाला Deepfake डेटा सेट तैयार किया

हाल ही में, मध्य साम्राज्य चौराहे मंच श्रृंखला गतिविधियों की 12वीं डिजिटल वित्त और टेक्नोलॉजी वित्त सम्मेलन में, एंट ग्रुप के Deepfake पहचान समाधान को सम्मेलन के "फिनटेक तकनीकी नवाचार और अनुप्रयोग मामलों" में शामिल किया गया। एंट ग्रुप ने अपनी टियानजी प्रयोगशाला के तहत, उद्योग में पहली बार बड़े पैमाने पर, उच्च गुणवत्ता वाले, बहु-आयामी Deepfake डेटा सेट का निर्माण किया है, जिसमें एक मिलियन से अधिक मल्टीमीडिया सामग्री का समावेश है, जो वास्तविक दुनिया के वित्तीय जोखिम नियंत्रण वातावरण में Deepfake हमलों के नमूनों का पूर्ण अनुकरण करता है। यह मौजूदा वित्तीय क्षेत्र में Deepfake का परीक्षण करने के लिए एक उपकरण बन गया है।

जैक मा एआई के भविष्य पर: तकनीक महत्वपूर्ण है, लेकिन अनूठी मूल्यवृत्ति ही भविष्य की किस्मत तय करती है

8 दिसंबर 2024 को, जैक मा ने एंट ग्रुप के 20वें स्थापना दिवस समारोह में एक शानदार भाषण दिया, जिसमें उन्होंने इंटरनेट युग के अवसरों को याद किया और एआई युग के विशाल परिवर्तन की ओर इशारा किया। जैक मा ने कहा कि 20 वर्ष पहले, जब इंटरनेट अभी उभर रहा था, वह और उनके समकालीन लोग इस ऐतिहासिक अवसर को भुनाने में बहुत भाग्यशाली थे। लेकिन उनके अनुसार, अगले 20 वर्षों में, एआई युग का आगमन एक अप्रत्याशित परिवर्तन लेकर आएगा, जो सभी की कल्पना से परे होगा। जैक मा ने जोर देकर कहा कि एआई एक और भी महान युग होगा, यह सब कुछ बदल देगा, लेकिन उन्होंने यह भी बताया कि एआई निर्णय नहीं लेगा।