人工知能分野において、計算能力と時間は技術進歩を阻む重要な要因でした。しかし、DeepMindチームの最新の研究成果は、この問題に対する解決策を提供しています。

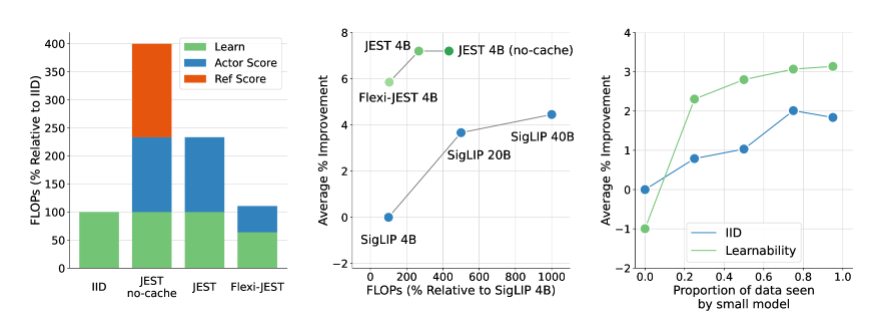

彼らはJESTという新しいデータ選別方法を提案しました。これは、最適なデータバッチをインテリジェントに選別してトレーニングを行うことで、AIトレーニング時間の大幅な短縮と計算能力の必要性の顕著な低減を実現します。AIトレーニング時間を13倍短縮し、計算能力の必要性を90%削減できるとされています。

JEST方法の中核は、個々のサンプルではなく、最適なデータバッチをまとめて選択することにあります。この戦略は、マルチモーダル学習の加速に特に有効であることが証明されています。従来の大規模事前学習データ選別方法と比較して、JESTは反復回数と浮動小数点演算回数を大幅に削減するだけでなく、FLOP予算のわずか10%しか使用しない場合でも、従来の最先端技術を凌駕します。

DeepMindチームの研究は、3つの重要な結論を示しています。良いデータバッチを選択することが、データポイントを個別に選択するよりも効果的であること、オンラインモデル近似をより効率的なデータフィルタリングに使用できること、そして、より大きな非厳選データセットを活用するために、小型の高品質データセットを導くことができることです。これらの発見は、JEST方法の高効率性能の理論的根拠を提供しています。

JESTの動作原理は、以前のRHO損失に関する研究を参考に、学習モデルと事前学習済み参照モデルの損失を組み合わせて、データポイントの学習可能性を評価することにあります。事前学習済みモデルにとっては容易だが、現在の学習モデルにとっては難しいデータポイントを選択することで、トレーニングの効率と効果を高めます。

さらに、JESTはブロック状ギブスサンプリングに基づく反復的な方法を採用し、バッチを段階的に構築します。各反復において、条件付き学習可能性スコアに基づいて新しいサンプルサブセットを選択します。この方法は、より多くのデータをフィルタリングする際に継続的に改善され、事前学習済み参照モデルのみを使用してデータを評価することも含まれます。

DeepMindのこの研究は、AIトレーニング分野に画期的な進歩をもたらしただけでなく、将来のAI技術開発のための新しい考え方と方法を提供しています。JEST方法のさらなる最適化と応用により、人工知能の発展がより広範な展望を迎えることを確信しています。

論文:https://arxiv.org/abs/2406.17711

要点:

🚀 **トレーニング効率革命**:DeepMindのJEST方法は、AIトレーニング時間を13倍短縮し、計算能力の必要性を90%削減します。

🔍 **データバッチ選別**:JESTは、個々のサンプルではなく、最適なデータバッチをまとめて選択することで、マルチモーダル学習の効率を大幅に向上させます。

🛠️ **革新的なトレーニング方法**:JESTは、オンラインモデル近似と高品質データセットの誘導を利用して、大規模事前学習のデータ分布とモデルの汎化能力を最適化します。