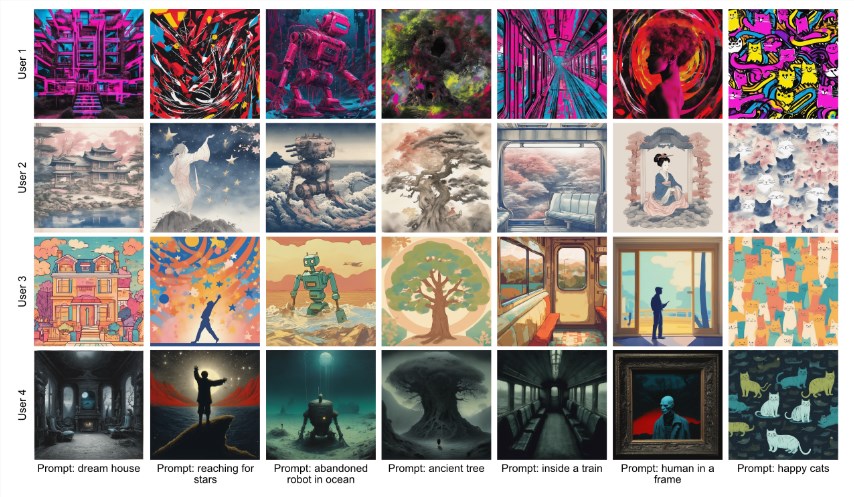

スイス連邦工科大学ローザンヌ校の研究チームが、ViPer(Visual Personalization of Generative Models via Individual Preference Learning)という新しい手法を発表しました。これは、ユーザーの視覚的な好みを元に、生成モデルの出力をパーソナライズするためのものです。

この革新的な手法は、2024年のECCV会議で発表され、チームは同じプロンプトでも、ユーザーそれぞれの好みに合った生成結果を得られるようにすることを目指しています。

製品入口:https://top.aibase.com/tool/viper

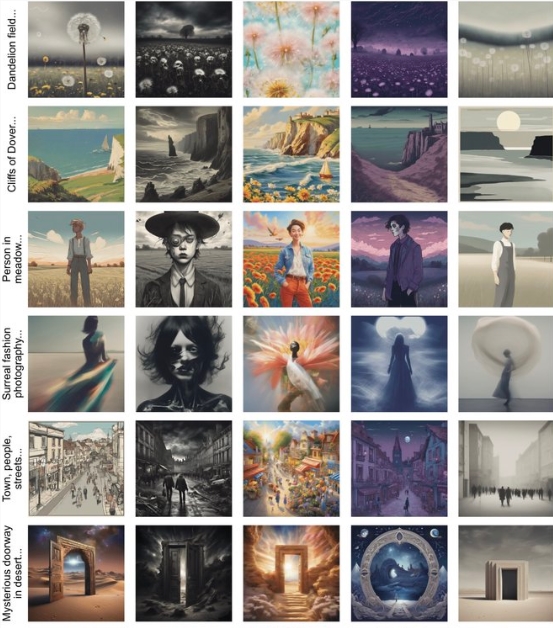

ViPerの仕組みは非常にシンプルです。ユーザーは一度だけ、いくつかの画像に対するコメントを提供するだけで、そのコメントから視覚的な好みが抽出されます。これにより、生成モデルは複雑なプロンプトなしにパーソナライズされ、これらの属性を使用してユーザーの好みに合った画像を生成します。

簡単に言うと、これはMidjourneyが以前発表したパーソナライズ機能(--personalize)に似ています。Midjourneyのパーソナライズモデルを使用するには、ユーザーは過去にペアワイズランキング内の画像に対して少なくとも200回のいいねまたは評価を行う必要があります。これらの評価やいいねの行動は、Midjourneyがユーザーの好みを学習し、パーソナライズモデルがユーザーの嗜好をより正確に反映できるようにします。

このプロジェクトのモデルはHuggingfaceプラットフォームで公開されており、ユーザーは簡単にダウンロードして使用できます。ViPerのVPEモデルは、ユーザーが提供する一連の画像とコメントから個々の好みを抽出するように微調整されています。

また、ユーザーが好む画像と好まない画像に基づいて、特定のクエリ画像の好みスコアを予測できる代理指標モデルも提供しています。つまり、ユーザーは新しい画像に対する潜在的な好みをよりよく理解できます。

さらに、ViPerは代理評価メカニズムを提供しており、ユーザーは好きと嫌いの画像を提供することで、クエリ画像のスコアを計算できます。このスコアは0から1までの範囲で、スコアが高いほど、ユーザーはその画像を好むことを示します。正確な結果を得るために、ユーザーには約8枚の好きな画像と8枚の嫌いな画像を提供することが推奨されています。

要点:

🌟 ViPerは、ユーザーの一回限りのコメントから個々の視覚的好みを抽出し、生成モデルの出力をパーソナライズします。

🖼️ このプロジェクトのモデルはHuggingfaceで公開されており、ユーザーは簡単にダウンロードして使用できます。

📊 ViPerは代理評価メカニズムを提供し、ユーザーが新しい画像に対する好みを予測するのに役立ちます。