最近、書生・浦語霊筆(InternLM-XComposer)多モーダル大規模言語モデルが2.5バージョンにアップグレードされました。上海人工知能研究所が主導して開発されたこのモデルは、卓越したロングコンテキストの入力と出力能力により、テキストと画像の理解と創作アプリケーションに革命的なブレークスルーをもたらしました。

IXC-2.5は、最大96Kの長さのロングコンテキストを容易に処理できます。これは、トレーニング時に使用された24Kのインターリーブされた画像テキストデータによるものです。このロングコンテキスト能力により、IXC-2.5は、広範な入力と出力コンテキストを必要とするタスクで優れた性能を発揮します。

前バージョンと比較して、IXC-2.5は視覚言語理解において3つの重要なアップグレードを行いました。

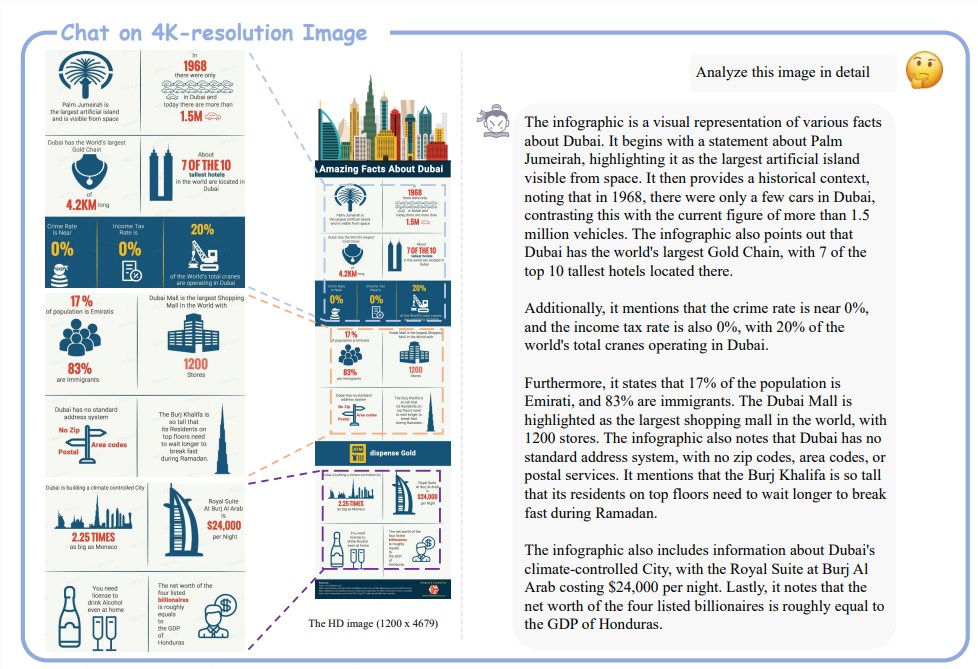

超高解像度理解:IXC-2.5は、内蔵の560×560ViTビジュアルエンコーダーにより、任意のアスペクト比の高解像度画像をサポートします。

細粒度ビデオ理解:数十から数百フレームで構成される超高解像度の複合画像としてビデオを扱い、高密度サンプリングとより高解像度で詳細を捉えます。

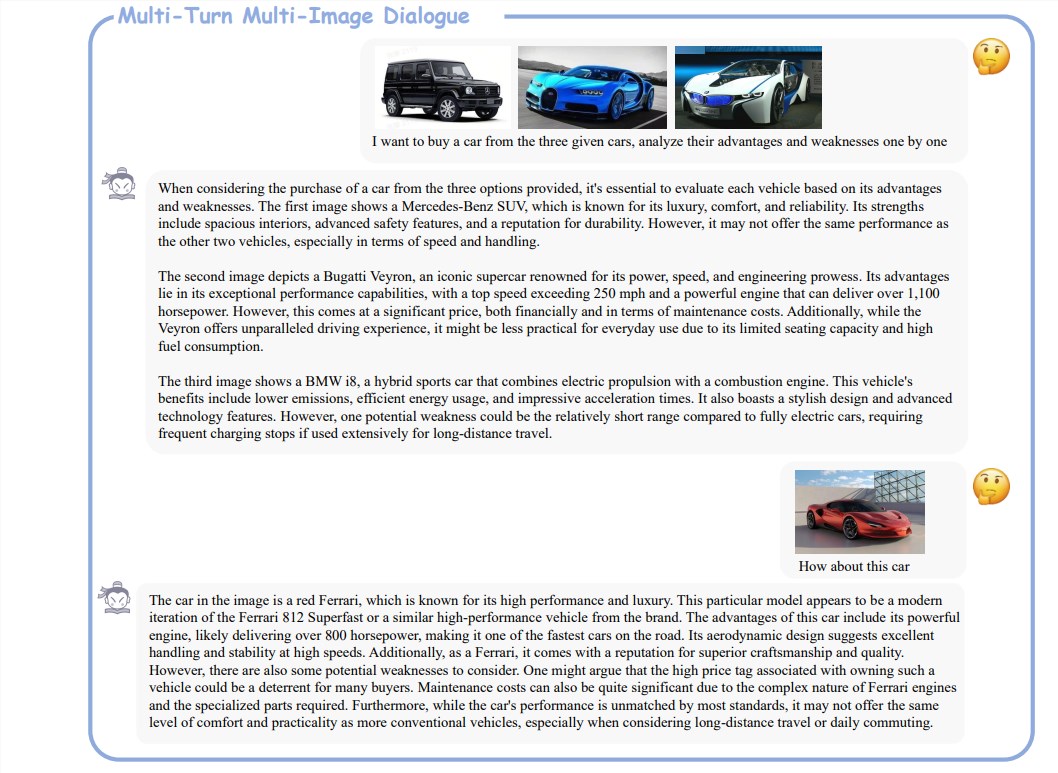

複数ラウンドの複数画像対話:自由形式の複数ラウンドの複数画像対話をサポートし、人間と自然なインタラクションを行います。

理解能力の向上に加えて、IXC-2.5は、追加のLoRAパラメーターを使用してテキストと画像を作成する2つの注目すべきアプリケーションを拡張しました。

ウェブページの作成:テキストと画像の指示に基づいて、IXC-2.5はHTML、CSS、JavaScriptのソースコードを作成し、ウェブページを作成できます。

高品質な画像付き記事の作成:特別に設計されたChain-of-Thought(CoT)とDirect Preference Optimization(DPO)技術を利用して、作成コンテンツの品質を大幅に向上させます。

IXC-2.5は28のベンチマークテストで評価され、16のベンチマークテストで既存のオープンソース最先端モデルを上回りました。さらに、16の主要なタスクにおいて、GPT-4VとGemini Proと同等以上の性能を示しました。この成果は、IXC-2.5の強力な性能と幅広い応用可能性を十分に証明しています。

論文アドレス:https://arxiv.org/pdf/2407.03320

プロジェクトアドレス:https://github.com/InternLM/InternLM-XComposer