最近、アリババクラウドはQwen2-Mathシリーズの大規模言語モデルを発表しました。数学に特化したこのAIの新星は、発表と同時に業界から大きな注目を集めています。

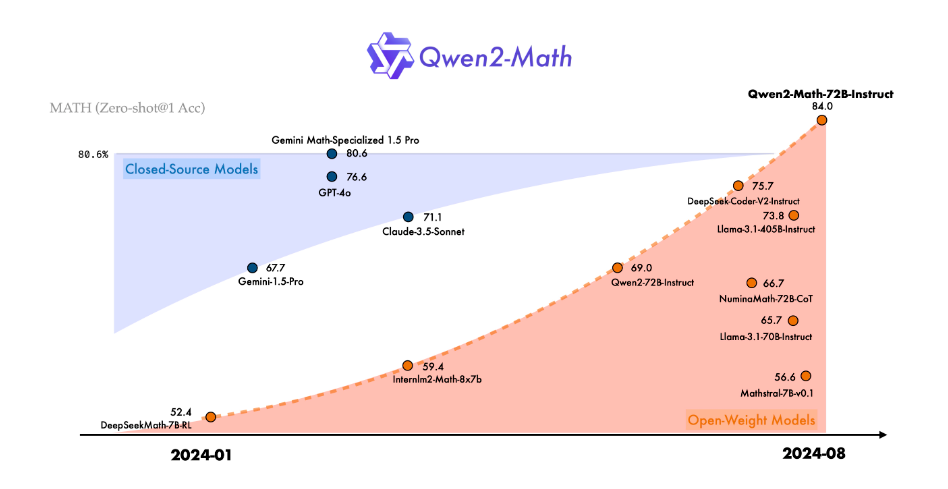

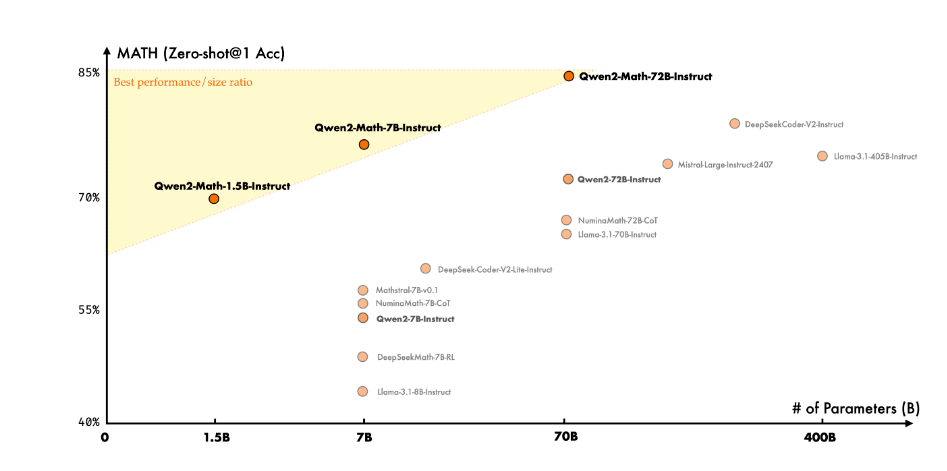

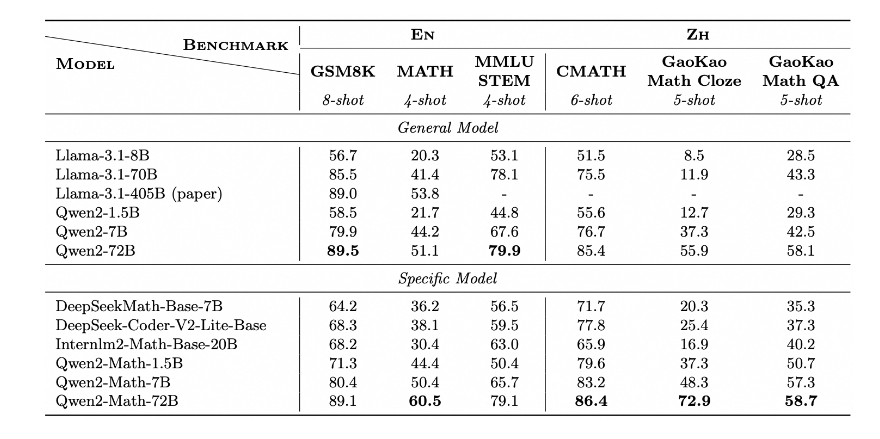

Qwen2シリーズの最新メンバーであるQwen2-MathとQwen2-Math-Instruct-1.5B/7B/72Bモデルは、数学の問題解決能力において驚くべき実力を示しました。これらのモデルは、複数の数学ベンチマークテストで既存のオープンソースモデルを上回り、GPT-4o、Claude-3.5-Sonnet、Gemini-1.5-Pro、Llama-3.1-405Bなどの有名なクローズドソースモデルをも凌駕する結果を出しており、AI数学界の「ダークホース」と言えるでしょう。

Qwen2-Mathの成功は偶然ではありません。アリババクラウドのチームは過去1年間、大規模言語モデルの算術と数学の問題解決能力の向上に多大な努力を注いできました。このシリーズモデルの基礎はQwen2-1.5B/7B/72Bであり、開発チームはこれに基づいて、綿密に設計された数学専門のコーパスを用いて深層学習を行いました。この独自のコーパスには、大規模で高品質な数学に関するウェブテキスト、専門書、コード例、膨大な試験問題、そしてQwen2によって生成された数学の事前学習データが含まれています。

特に注目すべきはQwen2-Math-Instructモデルです。Qwen2-Math-72Bを基に訓練されたこの数学専門の報酬モデルは、革新的な訓練方法を採用しています。開発チームは、密集した報酬信号とモデルの回答の正誤を示す2値信号を巧みに組み合わせ、この複合信号を教師信号として使用し、拒否サンプリングによってSFT(Supervised Fine-Tuning)データを作成し、SFT後の強化学習にはグループ相対方策最適化(GRPO)技術を適用しました。この独自の訓練方法は、モデルの数学の問題解決能力を大幅に向上させました。

実際の応用において、Qwen2-Math-Instructは驚くべきパフォーマンスを示しました。2024年のAIME(アメリカ数学インビテーショナル)や2023年のAMC(アメリカ数学コンテスト)において、貪欲探索(Greedy)、多数決、リスク最小化などの戦略を用いた様々な設定で優れた成績を収めました。

さらにエキサイティングなことに、Qwen2-Mathは国際数学オリンピック(IMO)レベルの難問にも対応できる実力を見せています。一連のテストケースの分析を通じて、研究者たちはQwen2-Mathが簡単な数学コンテストの問題を容易に解決できるだけでなく、複雑な問題にも説得力のある解答アプローチを示せることを発見しました。

しかし、アリババクラウドのチームはここで止まりません。彼らは、現在のQwen2-Mathシリーズは英語のみをサポートしていますが、英語と中国語に対応するバイリンガルモデルを積極的に開発しており、近い将来に多言語版をリリースする予定であることを明らかにしました。さらに、チームはモデルの継続的な最適化を行い、より複雑で挑戦的な数学問題を解決する能力の更なる向上を目指しています。

Qwen2-Mathの登場は、AIの数学分野への応用にとって新たな可能性を切り開きました。教育業界に革命的な変化をもたらし、生徒が数学の知識をより良く理解し習得するのに役立つだけでなく、複雑な数学計算が必要な研究、工学などの分野でも重要な役割を果たす可能性があります。

プロジェクトページ:https://top.aibase.com/tool/qwen2-math

モデルダウンロード:https://huggingface.co/Qwen