最近、NVIDIAの最新世代Blackwell GPUは空前の需要を生み出し、CEOのジェンスン・フアンは投資家会議で、今後12ヶ月の供給量が完売したと発表しました。これは数ヶ月前のHopper GPUの好調と同様、高性能コンピューティングへの強い需要を示しています。

今回の売れ行きは、AWS、Google、Meta、Microsoft、Oracle、CoreWeaveなどの大手テクノロジー企業を含む、従来からの顧客に牽引されています。NVIDIAとその製造パートナーであるTSMCが今後4四半期に生産するBlackwell GPUは、全てこれらの巨大企業によって事前に購入されていると言えるでしょう。

アナリストのジョー・ムーア氏は、NVIDIAのAIプロセッサ市場におけるシェアが2025年にはさらに拡大すると指摘しています。大規模ユーザーによるNVIDIAソリューションの需要が急速に増加しており、この傾向は最近の議論で十分に確認されています。同時に、Gartnerも2024年のAIチップの収益が大幅に増加すると予測しています。

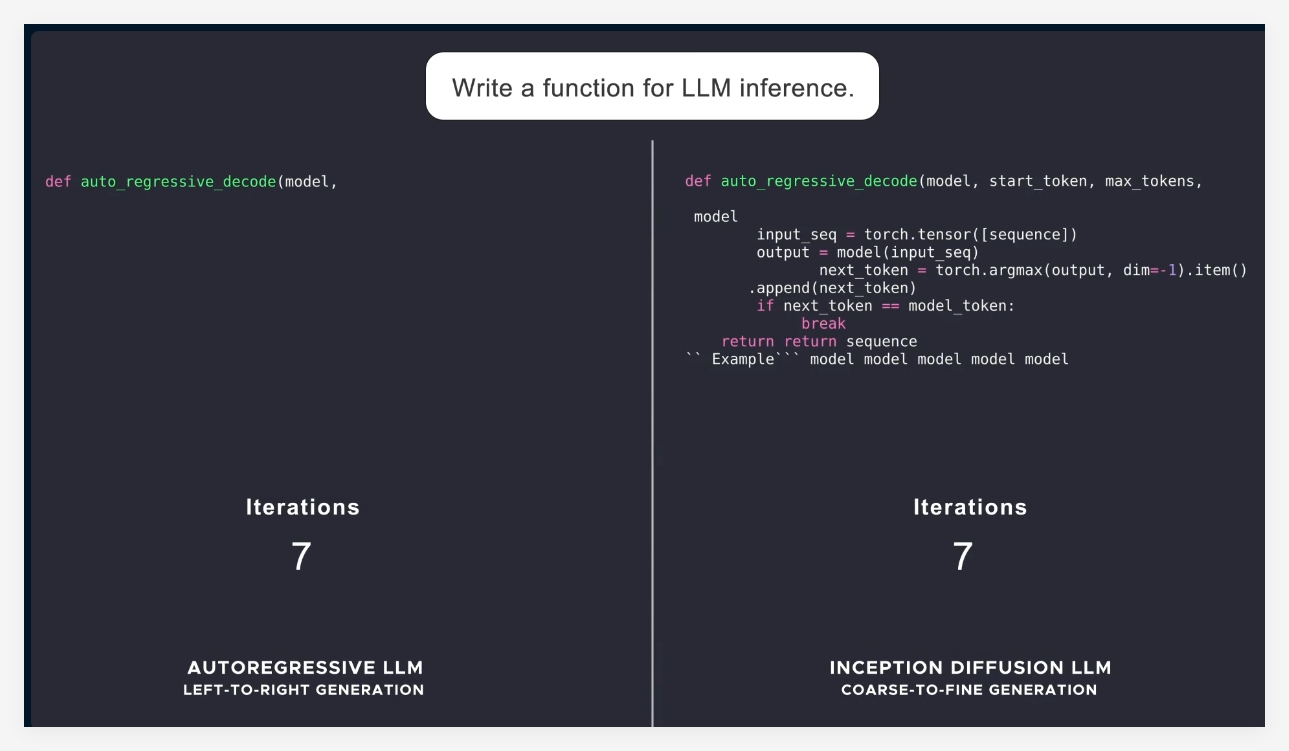

NVIDIAは3月にBlackwell GPUプラットフォームを発表し、データ処理、エンジニアリングシミュレーション、電子設計自動化などの分野における画期的な能力を強調しました。Blackwellシリーズには、B200 Tensor Core GPUとGB200 Grace「スーパーチップ」が含まれており、これらのプロセッサは、大規模言語モデル(LLM)の推論向けに設計されており、同時に消費電力を大幅に削減します。これは現在の業界において非常に重要です。

NVIDIAはB100とB200 GPUのパッケージングの問題を解決しましたが、依然として懸念事項が残っています。例えば、世界最大のチップファウンドリであるTSMCが十分なCoWoS-Lパッケージング能力を提供できるかどうか、またメモリメーカーがBlackwellに十分なHBM3Eメモリを提供できるかどうかです。特に、NVIDIAはまだSamsungのHBM3Eメモリを検証しておらず、これが供給に影響を与えている部分もあります。

これらの課題にもかかわらず、NVIDIAは2024年第4四半期にBlackwellの生産を増加させることに自信を持っており、今年最後の四半期には数十億ドル相当のBlackwell GPUを出荷すると予想しています。Blackwellアーキテクチャは、AI向けに構築された史上最も複雑なアーキテクチャと考えられており、今日のモデルのニーズを満たし、組織が将来的なより大きなパラメータとパフォーマンスのニーズに対応するためのインフラストラクチャを提供することを目的としています。

今回の発表で、NVIDIAはコンピューティング処理のニーズだけでなく、AIの発展を阻む3つのボトルネックである消費電力、遅延、精度にも取り組んでいることを述べました。Blackwellアーキテクチャは、性能において卓越したパフォーマンスを示すと同時にエネルギー効率も向上させており、NVIDIAのこの分野における強力な能力を示しています。

第2四半期には、NVIDIAのデータセンター収益は263億ドルに達し、前年同期比で154%増加しました。これは、同社の持続的な成長の重要な指標でもあります。

要点:

- 💡 Blackwell GPUの需要が急増し、今後12ヶ月分は完売。

- 🔍 AWS、Googleなどの大手テクノロジー企業が主要顧客となり、市場成長を牽引。

- 📈 NVIDIAは2024年に数十億ドル相当のBlackwell GPUを出荷すると予想しており、データセンター収益は大幅に増加。