先日、Sakana AIの科学者たちが人工知能分野で画期的な進歩を遂げました。彼らは初めて、視覚言語基盤モデル(vision-language foundation models、FMs)を用いて人工生命(Artificial Life、ALife)シミュレーションの自動検索を成功させました。ASAL(Automated Search for Artificial Life、人工生命自動検索)と名付けられたこの新手法は、人工生命分野の研究に革命的な変化をもたらし、この分野の発展を加速すると期待されています。

従来の人工生命研究は、主に手動設計と試行錯誤に依存していましたが、ASALの登場によって状況が変わりました。この手法の中核は、基盤モデルを用いてシミュレーションで生成されたビデオを評価することで、興味深いALifeシミュレーションを自動的に検索することです。ASALは主に3つのメカニズムを通じて生命形態を発見します。

教師あり目標探索:テキストプロンプトを使用して、特定の現象を生み出すシミュレーションを探します。例えば、研究者は「一つの細胞」や「二つの細胞」といった目標を設定し、システムに条件に合うシミュレーションを自動的に探し出させます。開放型探索:時間的に無限に新しいものを生み出すシミュレーションを探します。この方法は、人間の観察者にとって継続的に興味深いシミュレーションを発見するのに役立ちます。ヒューリスティック探索:「異世界」を明らかにするために、興味深く多様なシミュレーションの集合を探します。

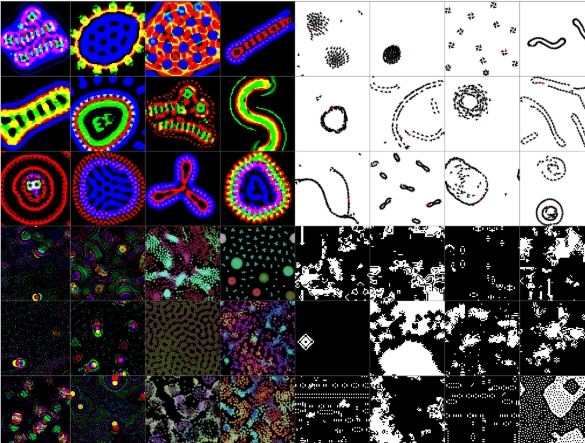

ASALの汎用性により、Boids、粒子生命(Particle Life)、ライフゲーム(Game of Life)、Lenia、ニューラルセルオートマトン(Neural Cellular Automata)など、様々なALife基質に効果的に適用できます。研究者たちはこれらの基質において、前例のない生命形態を発見しました。例えば、Boidsでは奇妙な群集パターンが現れ、Leniaでは新しい自己組織化細胞が現れ、コンウェイのライフゲームに似た開放型のセルオートマトンが現れました。

さらに、ASALは、これまで定性的分析しかできなかった現象を定量的に分析することもできます。基盤モデルは人間と同様の表現能力を持っているため、ASALはより人間の認知に沿った方法で複雑さを測定できます。例えば、研究者はCLIPベクトルのシミュレーション過程における変化速度を測定することで、Leniaシミュレーションにおけるプラトー期を定量化できます。

この研究の革新的な点は、事前学習済みの基盤モデル、特にCLIP(Contrastive Language-Image Pre-training)モデルを用いてシミュレーションのビデオを評価したことです。CLIPモデルは、コントラスティブ学習によって画像とテキストの表現を整合させることで、人間の複雑さに関する概念を理解できます。ASALの手法は特定の基盤モデルやシミュレーション基質に限定されないため、将来のモデルや基質にも対応できます。

研究者たちは実験を通してASALの有効性を検証し、異なる基盤モデル(CLIPとDINOv2など)や異なるALife基質を用いてテストを行いました。その結果、CLIPは人間の認知に合致する多様性を生成する点でDINOv2よりもやや優れているものの、どちらも低レベルのピクセル表現よりも明らかに優れていることが示されました。これは、人間の多様性の概念を測定するために深層基盤モデル表現を使用することの重要性を強調しています。

この研究は人工生命分野に新たな道を切り開き、研究者たちは、どのような現象が現れるのが望ましいかをどのように記述するのが最善かといった、より高度な問題に集中できるようになりました。そして、自動化されたプロセスがそれらの結果を探し出します。ASALの登場は、科学者が新しい生命形態を発見するのを助けるだけでなく、生命シミュレーションにおける複雑さと開放性を定量的に分析することも可能にします。最終的に、この技術は、生命の本質、そして宇宙に存在する可能性のある生命のあらゆる形態を理解するのに役立つと期待されています。

プロジェクトコード: https://github.com/SakanaAI/asal/

論文アドレス: https://arxiv.org/pdf/2412.17799