ロボット技術分野において、アメリカのスタートアップ企業Figure AIは最近、Helixという端末側の大規模言語モデルを発表し、人型ロボット制御技術の大きなブレークスルーとなりました。Helixは、人型ロボットの上半身全体(頭部、胴体、手首、指を含む)を高頻度で連続的に制御できる最初の視覚・言語・動作(VLA)モデルです。これは、ロボットが大量の訓練なしに、自然言語の指示に従って直接タスクを実行できることを意味します。

Figure AIは、視覚言語モデルの汎用性と速度の矛盾を解決するために、2つの補完的なシステムを構築しました。システム1は、毎秒200回の正確な動作を実行できる高速応答の視覚運動戦略モデルであり、システム2は、複雑なシーンと自然言語を理解できるオープンソースの視覚言語モデルです。これらの2つのシステムは、エンドツーエンドのトレーニングを通じて効率的なコミュニケーションを実現し、これまで人型ロボットが多様なタスクを実行する際に直面していた制約を克服しました。

さらにエキサイティングなことに、Helixは単一ロボットでのみ動作するだけでなく、2台のロボットの協調動作を実現できる最初のAIモデルでもあります。一連のデモでは、Helixを搭載した2台のロボットが、見たことのない雑多な物体を前に、協力して分類することに成功しました。タスクを完了するために、ロボット間では視覚的な「確認」を行い、互いに目を合わせて情報伝達の正確性を確保しました。この人間とロボットの協調作業は、Helixの強力な能力を示すだけでなく、将来の人型ロボットと人間とのインタラクションがより自然で効率的になることを示唆しています。

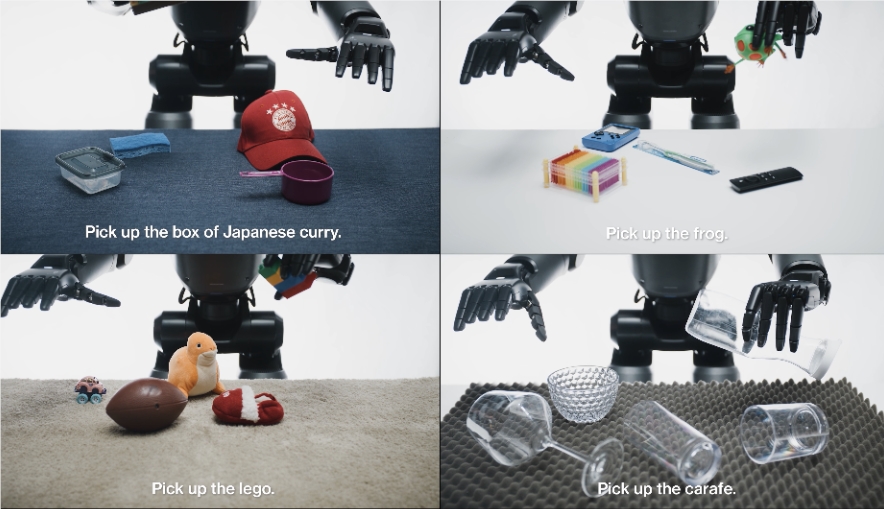

わずか500時間の高品質な教師ありデータを使用することで、Helixは数千種類もの小型家庭用品を容易に識別して処理できます。簡単な指示の下で、ロボットはこれまでデモンストレーションされたことのないタスクを正確に完了することができ、その驚くべき柔軟性と知能化の度合いを示しています。

Helixの発表に伴い、Figure AIは積極的に資金調達を進めており、目標額は15億ドル、企業価値は395億ドルに達すると予想されています。この数字は昨年と比較して約14倍増加しており、市場におけるロボット技術への大きな関心と可能性を反映しています。