この度、マイクロソフトはPhi-4ファミリーをさらに拡張し、2つの新しいモデル、Phi-4多様なモデル(Phi-4-multimodal)とPhi-4ミニ(Phi-4-mini)を発表しました。これらのモデルが登場したことで、様々なAIアプリケーションに、より強力な処理能力が提供されることになります。

Phi-4多様なモデルは、音声、視覚、テキスト処理を統合したマイクロソフト初の統一アーキテクチャモデルであり、5600万パラメーターを備えています。このモデルは、複数のベンチマークテストで優れた性能を示し、GoogleのGemini 2.0シリーズなどの市場にある多くの競合製品を上回っています。特に、自動音声認識(ASR)と音声翻訳(ST)タスクにおいては顕著な成果を上げており、Whisper V3やSeamlessM4T-v2-Largeなどの専門的な音声モデルを凌駕し、単語誤り率6.14%でHugging Face OpenASRランキングで1位を獲得しました。

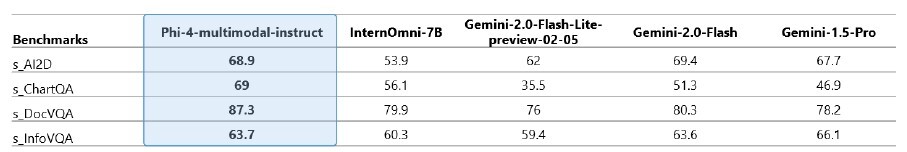

視覚処理においても、Phi-4多様なモデルは優れた性能を発揮しています。数学や科学的推論における能力は非常に高く、文書やグラフを効果的に理解し、光学文字認識(OCR)を実行できます。Gemini-2-Flash-lite-previewやClaude-3.5-Sonnetなどの一般的なモデルと比較しても、同等以上の性能を示しています。

もう一つの新モデルであるPhi-4ミニは、テキスト処理タスクに特化したモデルで、パラメーター数は3800万です。テキスト推論、数学計算、プログラミング、指示に従うなどの面で、Phi-4ミニは多くの一般的な大規模言語モデルを上回っています。新しいモデルの安全性と信頼性を確保するために、マイクロソフトは社内外のセキュリティ専門家を招いて包括的なテストを実施し、マイクロソフトAIレッドチーム(AIRT)の基準に従って最適化を行いました。

これらの2つの新しいモデルは、ONNX Runtimeを使用して様々なデバイスに展開でき、低コストで低遅延のアプリケーションシナリオに適しています。Azure AI Foundry、Hugging Face、NVIDIA APIカタログで利用可能になり、開発者が使用できます。Phi-4シリーズの新しいモデルは、マイクロソフトの高効率AI技術における大きな進歩を示しており、将来のAIアプリケーションの可能性を広げるものです。