1400万件のPubMed抄録を分析した結果、ChatGPTの登場以来、AIテキストジェネレーターが少なくとも10%の科学抄録に影響を与えていることが明らかになりました。一部の分野や国では、この割合はさらに高くなっています。

テュービンゲン大学とノースウェスタン大学の研究者らは、2010年から2024年までの1400万件の科学抄録について言語変化の研究を行いました。その結果、ChatGPTや同様のAIテキストジェネレーターによって、特定のスタイルの語彙が大幅に増加していることが判明しました。

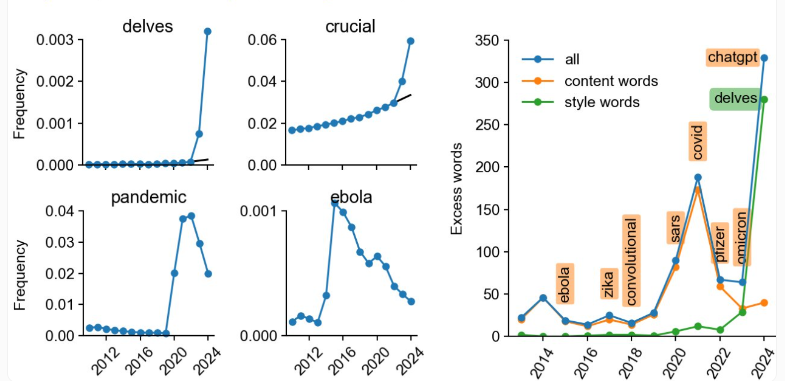

研究者らはまず、2024年に前年と比べて著しく頻度が増加した語彙を特定しました。「徹底的に調査する」、「複雑な」、「示す」、「強調する」など、ChatGPTの記述スタイルに典型的な多くの動詞や形容詞が含まれていました。

これらの特徴的な単語に基づき、研究者らは2024年にはAIテキストジェネレーターがすべてのPubMed抄録の少なくとも10%に影響を与えていると推定しました。場合によっては、この影響は「Covid」、「パンデミック」、「エボラ」などの単語がそれぞれの時代に及ぼした影響を上回ることさえありました。

中国や韓国などの国のPubMedサブグループでは、約15%の抄録がChatGPTを使用して作成されていることが判明しましたが、英国ではわずか3%でした。しかし、これは必ずしも英国の著者がChatGPTをあまり使用していないことを意味するわけではありません。

実際、研究者によると、AIテキストジェネレーターを実際に使用している割合ははるかに高い可能性があります。多くの研究者は、AIによって生成されたテキストを編集し、特徴的な単語を削除します。ネイティブスピーカーは、このようなフレーズに気づきやすい可能性が高いため、この点で有利です。そのため、AIの影響を受けた抄録の実際の割合を特定することが困難になっています。

測定可能な範囲では、FrontiersやMDPI誌などでは約17%、IT関連の学術誌では20%と、AIの使用率は特に高いです。IT関連の学術誌では、中国の著者の割合が最も高く、35%に達しています。

科学論文の著者にとって、AIは論文の可読性を高めるのに役立つ可能性があります。研究著者のDmitry Kobak氏は、抄録専用の生成AIが必ずしも問題ではないと述べています。

しかし、AIテキストジェネレーターは事実を捏造したり、偏見を強めたり、さらには剽窃を行う可能性もあります。また、科学論文の多様性と独創性を低下させる可能性もあります。

皮肉なことに、ChatGPTの発表直前にMeta社が発表した科学向けのオープンソース言語モデル「Galactica」は、科学界の一部の人々から厳しい批判を受け、Meta社はそれを停止せざるを得ませんでした。これは明らかに、生成AIが科学論文執筆に参入することを阻止しませんでしたが、このタスクに特化したシステムの登場を妨げた可能性があります。

要点:

😮 PubMed抄録の分析により、ChatGPTの登場以来、少なくとも10%の科学抄録がAIテキストジェネレーターの影響を受けていることが判明しました。

😯 中国や韓国などの国のPubMedサブグループでは、約15%の抄録がChatGPTを使用して作成されており、英国ではわずか3%です。

😲 AIテキストジェネレーターは事実を捏造したり、偏見を強めたり、さらには剽窃を行う可能性があるため、科学におけるAIテキストジェネレーターの使用に関するガイドラインの見直しを求める声が上がっています。