Willkommen bei der Rubrik „AI-Tagesbericht“! Hier finden Sie täglich Ihren Wegweiser durch die Welt der Künstlichen Intelligenz. Wir präsentieren Ihnen täglich die wichtigsten Themen aus dem KI-Bereich, mit Fokus auf Entwickler, damit Sie Technologietrends verstehen und innovative KI-Produktanwendungen kennenlernen.

Neue KI-Produkte hier entdecken: https://top.aibase.com/

1. Keling AI veröffentlicht Version 1.5: Stabilere und hochauflösendere Videos – selbst bei fliegenden Personen bleiben die Gesichter unverzerrt

Die neueste Version 1.5 von Keling AI bietet beeindruckende neue Funktionen und Verbesserungen. Sie steigert die Anzahl und Qualität der generierten Videos deutlich und erweitert die Anwendungsmöglichkeiten von KI im Bereich kreativer Medien. Die Bildqualität wurde erheblich verbessert (Unterstützung von 1080p-HD-Videos mit 10 Sekunden Länge), die Reaktionsfähigkeit auf Texte wurde erhöht, die Ästhetik verbessert, die Konsistenz von Personen verstärkt und die Konsistenz von Objekten optimiert.

【AiBase Zusammenfassung:】

🚀 Version 1.5 bietet eine deutlich verbesserte Video-Generierungsfähigkeit. Es können bis zu 4 Videos gleichzeitig generiert werden, und die Funktion „Bild zu Video“ unterstützt die Generierung von bis zu 10 Sekunden langen 1080p-HD-Videos.

🎨 Version 1.0 enthält die neue Funktion „Bewegungs-Pinsel“, die eine präzisere Bewegungssteuerung und lebendigere Bewegungsdarstellungen ermöglicht und den kreativen Spielraum von Videokünstlern erweitert.

💡 Die Fähigkeit zum Textverständnis wurde deutlich verbessert. Version 1.5 zeigt deutliche Verbesserungen in Bezug auf Bildqualität, dynamische Darstellung und die Einhaltung von Textanweisungen. Die Gesamtleistung wurde um 95 % gesteigert.

Detaillierte Informationen: https://top.aibase.com/tool/keling-ai

2. ByteDance präsentiert Seed-Music, ein Musikgenerierungs-Tool mit vielfältigen Eingabemöglichkeiten und präziser Steuerung

ByteDance hat kürzlich Seed-Music vorgestellt, ein neues Tool zur Musikproduktion, mit dem Benutzer Musik auf verschiedene Arten generieren können: über Textbeschreibungen, Audioreferenzen, Noten oder sogar Sprachhinweise. Dieses beeindruckende Modell kombiniert ein autoregressives Sprachmodell und ein Diffusionsmodell, um hochwertige Musikwerke zu generieren und gleichzeitig eine präzise Steuerung zu ermöglichen. Benutzer können Musik zu Texten hinzufügen, Melodien bearbeiten oder sogar Sprachfragmente hochladen, die in Gesang umgewandelt werden. Die Funktionen sind leistungsstark und effizient.

【AiBase Zusammenfassung:】

🎵 Seed-Music kombiniert ein autoregressives Sprachmodell und ein Diffusionsmodell, um hochwertige Musikwerke zu generieren, die Benutzer präzise steuern können.

🎶 Die Funktionen umfassen die Generierung von Gesang und Instrumenten, die Synthese von Gesang, die Umwandlung von Gesang und die Musikbearbeitung, um die Bedürfnisse verschiedener Benutzer zu erfüllen.

🎼 Seed-Music besteht aus den Modulen Repräsentationslernen, Generierung und Rendering. Durch Multimodalität werden hochwertige Musikstücke erzeugt.

Detaillierte Informationen: https://team.doubao.com/en/special/seed-music

3. Alibaba Tongyi Qianwen veröffentlicht Open-Source-Modelle der Qwen2.5-Serie: Qwen2-VL-72B steht dem GPT-4 in nichts nach

Das Tongyi Qianwen-Team hat die Open-Source-Modelle der Qwen2.5-Serie veröffentlicht, darunter das allgemeine Sprachmodell Qwen2.5, Qwen2.5-Coder und Qwen2.5-Math. Sie wurden mit einem Datensatz von 18 T Tokens trainiert und verbessern die Wissensakquise, Programmier- und mathematischen Fähigkeiten. Sie unterstützen die Verarbeitung langer Texte (bis zu 8.000 Tokens) und mehr als 29 Sprachen. Es sind verschiedene Größen verfügbar, und die Lizenz ist Apache 2.0. Das Modell Qwen2-VL-72B erreicht eine Leistung, die mit GPT-4 vergleichbar ist, mit deutlichen Verbesserungen bei der Befehlsausführung, der Generierung langer Texte, dem Datenverständnis und der strukturierten Ausgabe.

【AiBase Zusammenfassung:】

🚀 Die Qwen2.5-Modellserie ist Open Source und umfasst allgemeine Sprachmodelle und Modelle für Fachgebiete. Sie verbessern die Wissensakquise, Programmier- und mathematischen Fähigkeiten.

💡 Die Modelle unterstützen die Verarbeitung langer Texte (bis zu 8.000 Tokens) und mehr als 29 Sprachen.

💻 Das Qwen2-VL-72B-Modell zeigt deutliche Verbesserungen bei der Befehlsausführung, der Generierung langer Texte, dem Datenverständnis und der strukturierten Ausgabe.

Detaillierte Informationen: https://modelscope.cn/studios/qwen/Qwen2.5

4. Alibabas Tongyi Wanxiang Videogenerierungsmodell „AI-Videoerstellung“ ist offiziell online

Das von Alibaba unter dem Namen Tongyi veröffentlichte Tongyi Wanxiang AI-Videogenerierungsmodell ist jetzt verfügbar. Es verfügt über eine leistungsstarke Fähigkeit zur dynamischen Generierung von visuellen Bildern und unterstützt die Generierung von Videoinhalten in verschiedenen künstlerischen Stilen und mit kinoreifer Qualität. Das Modell wurde für die Darstellung chinesischer Elemente optimiert, unterstützt mehrsprachige Eingaben und die Generierung variabler Auflösungen. Es bietet eine breite Palette an Anwendungsszenarien, einen kostenlosen Service und eine Audiogenerierungsfunktion, wodurch der Videoproduktionsprozess vereinfacht wird.

【AiBase Zusammenfassung:】

⚙️ Das Tongyi Wanxiang AI-Videogenerierungsmodell verfügt über eine leistungsstarke Fähigkeit zur dynamischen Generierung von visuellen Bildern und unterstützt verschiedene künstlerische Stile und kinoreife Videoinhalte.

🌟 Es wurde für die Darstellung chinesischer Elemente optimiert und bietet somit einen einzigartigen Vorteil bei der Generierung von Inhalten im chinesischen Stil. Es unterstützt mehrsprachige Eingaben und die Generierung variabler Auflösungen, um die Bedürfnisse verschiedener Benutzer zu erfüllen.

🎬 Es bietet einen kostenlosen Service und unterstützt die Audiogenerierung für Videoinhalte, wodurch der Videoproduktionsprozess vereinfacht und die Synchronisierung von Ton und Bild sowie die Effizienz gesteigert werden.

Detaillierte Informationen: https://tongyi.aliyun.com/wanxiang/wanxvideo

5. Von Tencent! Das KI-Audiomodell EzAudio AI verwandelt Text in Sekundenschnelle in realistische Sprache

Kürzlich wurde das von der Johns Hopkins University und dem Tencent AI Lab gemeinsam entwickelte EzAudio-Modell vorgestellt, das einen bedeutenden Fortschritt in der Audiotechnologie darstellt. Das Modell generiert mithilfe einer innovativen Architektur und Technologie hochwertige Audioproben und bietet ein breites Anwendungspotenzial. Mit der Weiterentwicklung der Technologie werden ethische Fragen und die verantwortungsvolle Nutzung immer wichtiger. Der öffentlich zugängliche Forschungscode von EzAudio bietet die Möglichkeit, zukünftige Risiken und Vorteile umfassend zu prüfen.

【AiBase Zusammenfassung:】

🌟 EzAudio ist ein neues Text-zu-Audio-Generierungsmodell, das von der Johns Hopkins University und Tencent gemeinsam entwickelt wurde und einen bedeutenden Fortschritt in der Audiotechnologie darstellt.

🎧 Das Modell generiert mithilfe einer innovativen Architektur und Technologie Audioproben von höherer Qualität als bestehende Open-Source-Modelle und bietet ein breites Anwendungspotenzial.

⚖️ Mit der Weiterentwicklung der Technologie werden ethische Fragen und die verantwortungsvolle Nutzung immer wichtiger. Der öffentlich zugängliche Forschungscode von EzAudio bietet die Möglichkeit, zukünftige Risiken und Vorteile umfassend zu prüfen.

Detaillierte Informationen: https://huggingface.co/spaces/OpenSound/EzAudio

6. Giant Network veröffentlicht selbst entwickelte Charakter- und Sprachmodelle: GiantGPT und BaiLing-TTS

Giant Network präsentierte auf der Eröffnungszeremonie der Cloud Computing Conference 2024 seine neuesten Ergebnisse im Bereich „Gaming + KI“, darunter die Großmodelle GiantGPT und BaiLing-TTS sowie neue Technologien wie den KI-Digitalmenschen und die KI-Malplattform Giant Mojing. Das Unternehmen zeigte hochoptimierte Großmodelle für das Spielegeschäft und ein mehrsprachiges Sprachmodell, das verschiedene Dialekte unterstützt. Gleichzeitig wurde ein neues Markenlogo vorgestellt und die Beta-Anmeldung für die KI-Malplattform freigeschaltet. Giant Network präsentierte auch eine hochpräzise Echtzeit-Interaktionstechnologie für digitale Menschen und bekräftigte sein Engagement im Bereich „Gaming + KI“.

【AiBase Zusammenfassung:】

🎮 GiantGPT ist ein vertikales Großmodell, das sich auf das Spielegeschäft konzentriert und mit eigenen Daten und öffentlich zugänglichen Internetdaten trainiert wurde, um die Grundfunktionen zu optimieren.

🗣 BaiLing-TTS ist ein Sprachmodell, das verschiedene Mandarin-Dialekte unterstützt und verschiedene Dialekte generieren kann.

🖌 Die KI-Malplattform Giant Mojing ist eine Cloud-basierte Plattform, die Teamarbeit und die Massenverarbeitung von Kunstinhalten unterstützt.

7. Der erweiterte Sprachmodus von ChatGPT soll am 24. September umfassend eingeführt werden

Der erweiterte Sprachmodus von ChatGPT soll am 24. September umfassend veröffentlicht werden und den Nutzern ein bisher unbekanntes interaktives Erlebnis bieten. Diese Funktion generiert realistische Audioantworten und verbessert die Natürlichkeit und das Eintauchen des Mensch-Maschine-Dialogs. Die Zuverlässigkeit der Update-Informationen ist belegt, einige mobile Nutzer werden den verbesserten Sprachmodus möglicherweise bereits am 24. September erleben. Die Benutzeroberfläche der macOS-Version der ChatGPT-Anwendung wurde verändert, die Benutzeroberfläche des Sprachmodus ist umfangreicher und enthält neue praktische Schaltflächen. Einige Nutzer können mehr Kontextinformationen mit ChatGPT teilen, um ein kohärenteres und personalisierteres Dialogerlebnis zu ermöglichen.

【AiBase Zusammenfassung:】

⚙️ Der erweiterte Sprachmodus wird am 24. September umfassend veröffentlicht und verbessert das interaktive Erlebnis.

🔊 Es werden realistische Audioantworten generiert, um die Natürlichkeit und das Eintauchen des Mensch-Maschine-Dialogs zu verbessern.

🌌 Die Benutzeroberfläche der macOS-Version der ChatGPT-Anwendung wurde verändert, neue praktische Schaltflächen wurden hinzugefügt, um ein umfangreicheres visuelles Erlebnis zu bieten.

8. YouTube integriert DeepMind Veo-Modell und verleiht der Fantasie von Erstellern Flügel

YouTube hat offiziell angekündigt, das Veo-Modell von Google DeepMind in seine Kurzvideo-Plattform YouTube Shorts zu integrieren und damit eine neue Ära der KI-gestützten Kurzvideoerstellung einzuleiten. Diese Maßnahme bietet Erstellern nicht nur beispiellose kreative Werkzeuge, sondern verändert auch die Art und Weise, wie Nutzer mit der Plattform interagieren.

【AiBase Zusammenfassung:】

✨ Die Dream Screen-Funktion kombiniert die Modelle Imagen3 und Veo, um Erstellern eine intelligente Kreativumgebung zu bieten.

🌟 YouTube gewährleistet mithilfe der SynthID-Technologie die Transparenz und Glaubwürdigkeit von KI-generierten Inhalten.

💡 Das Programm „Made on YouTube 2024“ bietet KI-gestützte Kreativwerkzeuge wie Inspirationsassistenten und intelligente automatische Sprachausgabetools, um Inhaltsersteller umfassend zu unterstützen.

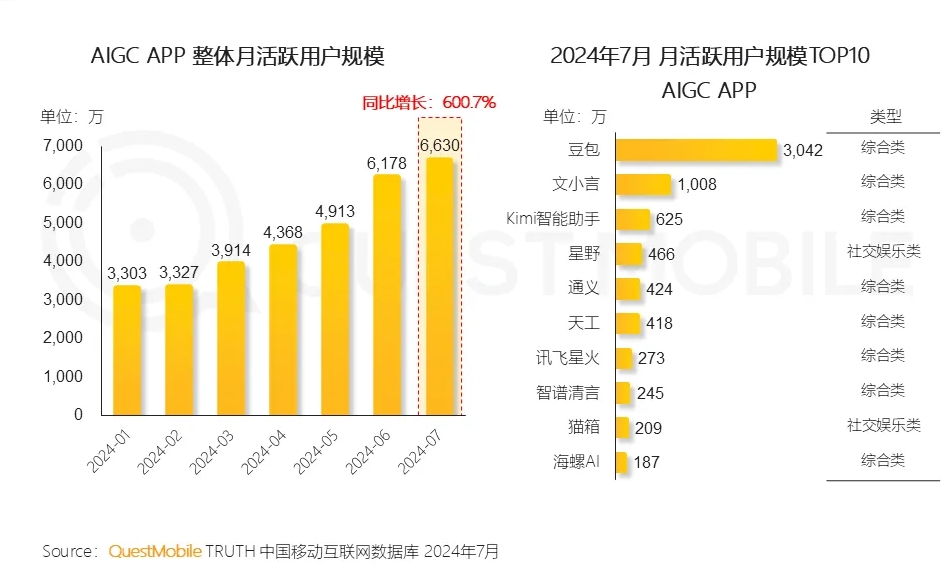

9. Halbjahresbericht 2024 zu KI-Agenten-Anwendungen: Über 66 Millionen monatlich aktive Nutzer bei KI-Apps

Der Halbjahresbericht 2024 zu KI-Agenten-Anwendungen zeigt, dass die Anzahl der monatlich aktiven Nutzer von KI-Anwendungen über 66 Millionen liegt und die rasante Entwicklung und Verbreitung von KI-Technologien auf Anwendungsebene verdeutlicht. Der Bericht weist darauf hin, dass sich KI-Anwendungen in acht Kategorien etabliert haben und die Kommerzialisierung bereits begonnen hat. KI-Agenten-Dienste lösen die Bedürfnisse der Nutzer, wobei das WeChat-Ökosystem ein wichtiger Kanal ist, und die Erforschung von Geschäftsmodellen für KI-Agenten ist im Gange. KI-Agenten haben sich im Bereich Bildung und Lernen etabliert, und die Nutzung der führenden KI-Agenten ist sehr hoch. KI-Agenten-Anwendungen sind zu einem wichtigen Zweig des mobilen Internets geworden, bieten Nutzern ein umfassendes und komfortables Erlebnis und schaffen neue Impulse und Richtungen für die Branchenentwicklung. Es wird erwartet, dass KI-Agenten-Anwendungen in Zukunft eine noch wichtigere Rolle spielen werden.

【AiBase Zusammenfassung:】

📊 Über 66 Millionen monatlich aktive Nutzer von KI-Anwendungen zeigen die rasante Entwicklung und Verbreitung von KI-Technologien.

🎮 KI-Anwendungen haben sich in acht Kategorien etabliert, und die Kommerzialisierung hat begonnen.

📈 KI-Agenten-Dienste lösen die Bedürfnisse der Nutzer, wobei das WeChat-Ökosystem ein wichtiger Kanal ist, und die Erforschung von Geschäftsmodellen ist im Gange.

10. LinkedIn nutzt heimlich Nutzerdaten zum Trainieren von KI – doppelter Opt-out erforderlich

Kürzlich wurde bekannt, dass LinkedIn ohne vorherige Ankündigung der Nutzer begonnen hat, Nutzerdaten zum Trainieren von generativen KI-Modellen zu verwenden. Nutzer müssen die entsprechende Option in den Kontoeinstellungen deaktivieren, um sich abzumelden, dies wirkt sich jedoch nur auf die zukünftige Datennutzung aus. LinkedIn erwähnt auch, dass für andere Machine-Learning-Tools zusätzliche Formulare ausgefüllt werden müssen, um die Datennutzung vollständig zu beenden.

【AiBase Zusammenfassung:】

🔒 LinkedIn verwendet standardmäßig Nutzerdaten zum Trainieren von KI-Modellen. Nutzer müssen sich aktiv abmelden.

✋ Nutzer müssen die Option in den Kontoeinstellungen deaktivieren. Dies wirkt sich nur auf die zukünftige Datennutzung aus.

📄 Neben generativer KI gibt es bei LinkedIn auch andere Machine-Learning-Tools. Um die Datennutzung vollständig zu beenden, müssen zusätzliche Formulare ausgefüllt werden.

11. 23 Millionen US-Dollar Finanzierung! Fal.ai begeistert 500.000 Entwickler und generiert täglich 50 Millionen Medieninhalte