Googles DeepMind hat die erste Studie zu den häufigsten missbräuchlichen Anwendungen von KI durchgeführt. Das Ergebnis: Die Erstellung von Deepfakes – also künstlich erzeugten, falschen Bildern und Videos von Politikern und Prominenten – ist weitaus verbreiteter als KI-gestützte Cyberangriffe. Die Studie ist eine Zusammenarbeit zwischen DeepMind, dem KI-Bereich von Google, und Jigsaw, einer Forschungsabteilung von Google. Ziel war es, die Risiken von generativen KI-Tools zu quantifizieren, die von den größten Technologieunternehmen weltweit zur Gewinnmaximierung auf den Markt gebracht wurden.

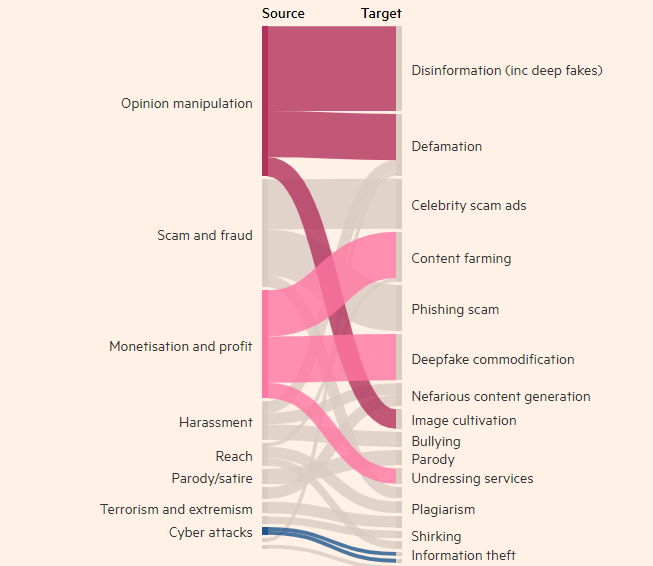

Motivationen von technisch versierten Übeltätern

Die Studie ergab, dass die Erstellung realistischer, aber gefälschter Bilder, Videos und Audioaufnahmen von Personen die häufigste Form des Missbrauchs generativer KI-Tools darstellt. Sie ist fast doppelt so häufig wie die zweithäufigste Methode, nämlich die Verwendung von Text-Tools (z. B. Chatbots) zur Fälschung von Informationen. Das häufigste Ziel des Missbrauchs generativer KI ist die Beeinflussung der öffentlichen Meinung (27% der Fälle). Dies weckt Bedenken hinsichtlich der Auswirkungen von Deepfakes auf die diesjährigen Wahlen weltweit.

In den letzten Monaten tauchten Deepfakes des britischen Premierministers Rishi Sunak und anderer internationaler Führungspersönlichkeiten auf Plattformen wie TikTok, X und Instagram auf. Die britischen Wähler werden nächste Woche wählen. Obwohl Social-Media-Plattformen versuchen, solche Inhalte zu kennzeichnen oder zu entfernen, können diese als echt wahrgenommen werden und die Wahlentscheidungen beeinflussen.

Die DeepMind-Forscher analysierten etwa 200 Fälle von Missbrauch auf Plattformen wie X und Reddit sowie in Online-Blogs und Medienberichten.

Die zweithäufigste Motivation für den Missbrauch von KI-generierten Produkten (wie OpenAIs ChatGPT und Googles Gemini) ist der finanzielle Gewinn. Dies geschieht entweder durch die Bereitstellung von Diensten zur Erstellung von Deepfakes oder durch die Verwendung generativer KI zur Erstellung großer Mengen an Inhalten, z. B. gefälschter Nachrichtenartikel. Die Studie ergab, dass die meisten Missbrauchsfälle leicht zugängliche Tools verwenden, die „nur minimale technische Kenntnisse“ erfordern. Dies bedeutet, dass immer mehr Übeltäter generative KI missbrauchen können.

Die DeepMind-Studie wird die Verbesserung der Sicherheitsbewertung ihrer Modelle beeinflussen und hoffentlich auch die Sichtweise ihrer Konkurrenten und anderer Stakeholder auf die „Ausprägung von Schäden“ verändern.

Wichtigste Punkte:

- 👉 Deepfakes sind laut DeepMind-Studie das größte Problem beim Missbrauch von KI-Anwendungen.

- 👉 Das häufigste Ziel des Missbrauchs generativer KI-Tools ist die Beeinflussung der öffentlichen Meinung (27% der Fälle).

- 👉 Die zweithäufigste Motivation für den Missbrauch generativer KI ist der finanzielle Gewinn, hauptsächlich durch die Bereitstellung von Deepfake-Diensten und die Erstellung von Fake News.