20 de enero de 2025, DeepSeek anunció el lanzamiento de su primer modelo de razonamiento entrenado con aprendizaje por refuerzo (RL), DeepSeek-R1, que logró un rendimiento comparable al de OpenAI-o1-1217 en varias pruebas de referencia de razonamiento. DeepSeek-R1 se basa en el modelo DeepSeek-V3-Base y utiliza un entrenamiento multifásico y datos de arranque en frío para mejorar su capacidad de razonamiento.

Los investigadores de DeepSeek desarrollaron primero DeepSeek-R1-Zero, un modelo entrenado completamente mediante aprendizaje por refuerzo a gran escala, sin pasos de preparación de ajuste fino supervisado. DeepSeek-R1-Zero mostró un rendimiento excepcional en las pruebas de referencia de razonamiento, como en el examen AIME2024, donde su puntuación pass@1 aumentó del 15.6% al 71.0%.Sin embargo, DeepSeek-R1-Zero también presentó algunos problemas, como la baja legibilidad y la mezcla de idiomas.

Para solucionar estos problemas y mejorar aún más el rendimiento del razonamiento, el equipo de DeepSeek desarrolló DeepSeek-R1. DeepSeek-R1 introdujo un entrenamiento multifásico y datos de arranque en frío antes del aprendizaje por refuerzo. En concreto, los investigadores primero recopilaron miles de datos de arranque en frío para ajustar finamente el modelo DeepSeek-V3-Base. Luego, realizaron un aprendizaje por refuerzo orientado al razonamiento, de la misma manera que entrenaron DeepSeek-R1-Zero. Al acercarse a la convergencia del proceso de aprendizaje por refuerzo, crearon nuevos datos de ajuste fino supervisado mediante el muestreo de rechazo de los puntos de control del aprendizaje por refuerzo, y los combinaron con los datos supervisados de DeepSeek-V3 en áreas como escritura, preguntas y respuestas fácticas y autoconciencia, para luego volver a entrenar el modelo DeepSeek-V3-Base. Finalmente, se realizó un aprendizaje por refuerzo adicional en el punto de control ajustado con indicaciones de todos los escenarios.

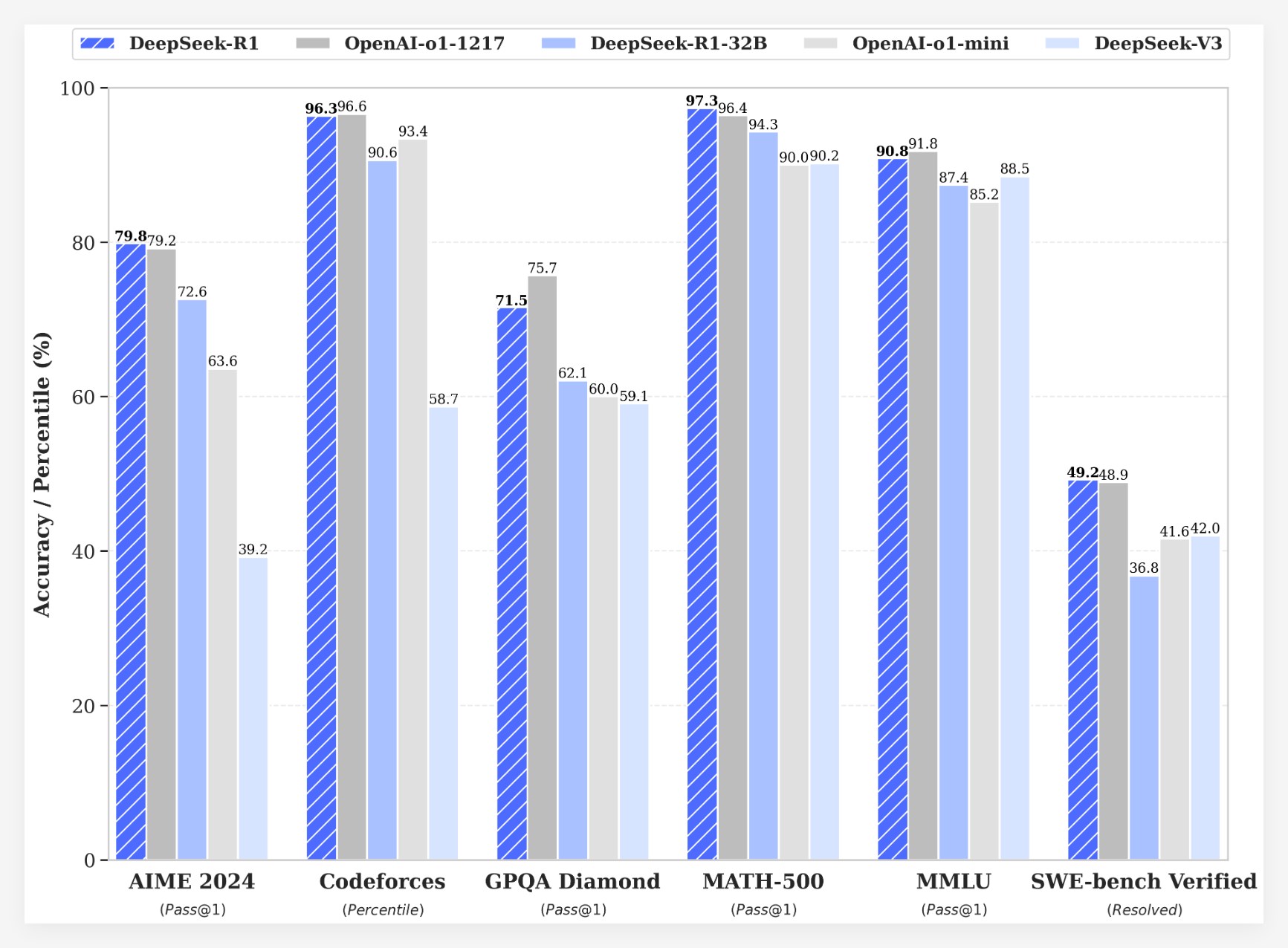

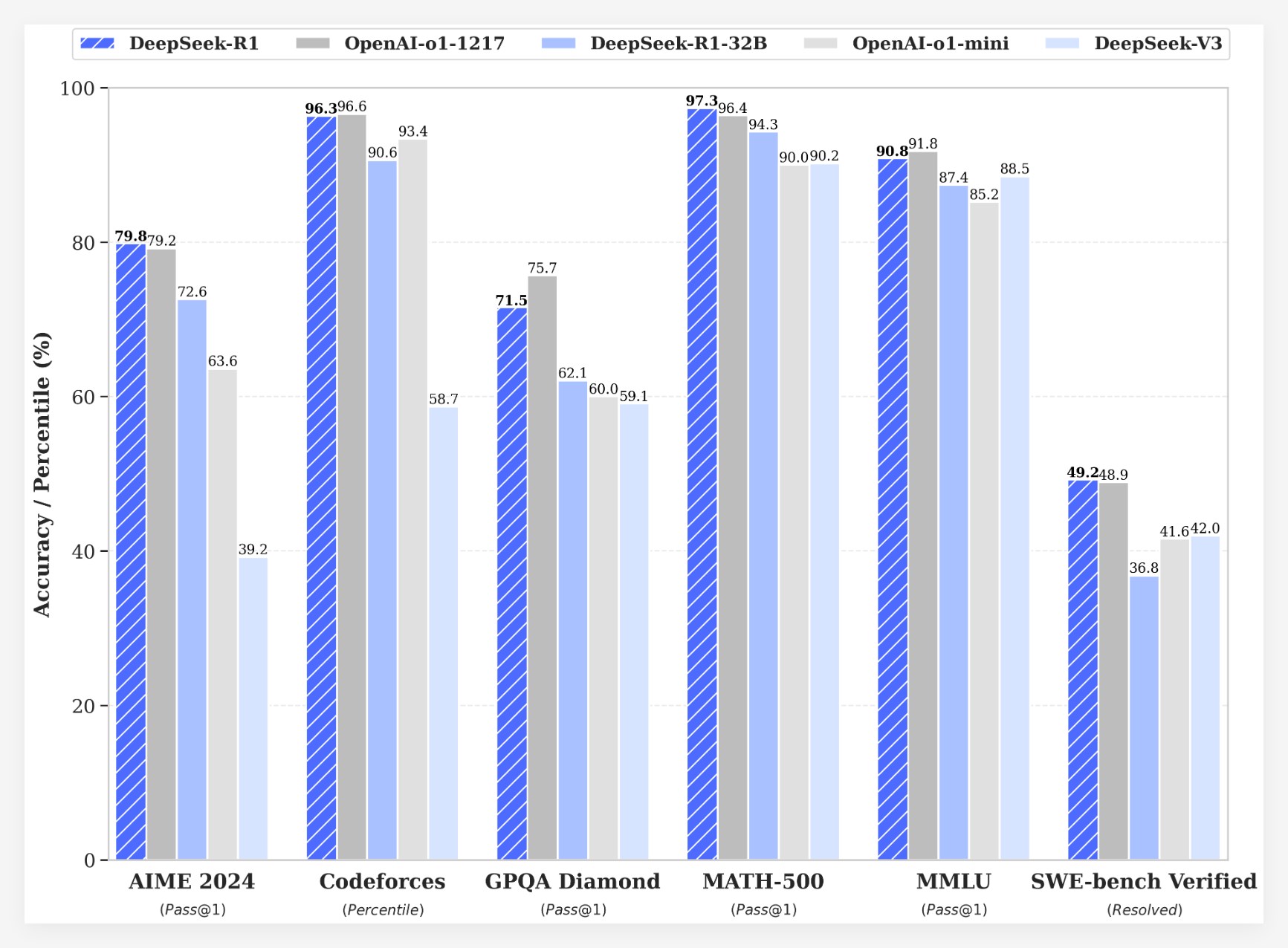

DeepSeek-R1 obtuvo resultados notables en varias pruebas de referencia:

• En el examen AIME2024, la puntuación pass@1 de DeepSeek-R1 alcanzó el 79.8%, ligeramente superior a la de OpenAI-o1-1217.

• En el examen MATH-500, la puntuación pass@1 de DeepSeek-R1 alcanzó el 97.3%, igualando a OpenAI-o1-1217.

• En las tareas de concursos de código, DeepSeek-R1 obtuvo una calificación Elo de 2029 en Codeforces, superando al 96.3% de los participantes humanos.

• En las pruebas de referencia de conocimiento (como MMLU, MMLU-Pro y GPQA Diamond), DeepSeek-R1 obtuvo puntuaciones del 90.8%, 84.0% y 71.5%, respectivamente, superando significativamente a DeepSeek-V3.

• DeepSeek-R1 también mostró un excelente rendimiento en otras tareas (como escritura creativa, preguntas y respuestas generales, edición, resumen, etc.).

Además, DeepSeek exploró la destilación de la capacidad de razonamiento de DeepSeek-R1 a modelos más pequeños. Los estudios encontraron que la destilación directa de DeepSeek-R1 es más efectiva que aplicar el aprendizaje por refuerzo en modelos pequeños. Esto indica que los patrones de razonamiento descubiertos por los grandes modelos básicos son cruciales para mejorar la capacidad de razonamiento.DeepSeek ha publicado en código abierto DeepSeek-R1-Zero, DeepSeek-R1 y seis modelos densos (1.5B, 7B, 8B, 14B, 32B, 70B) destilados de DeepSeek-R1 basados en Qwen y Llama. El lanzamiento de DeepSeek-R1 marca un avance significativo en el uso del aprendizaje por refuerzo para mejorar la capacidad de razonamiento de los grandes modelos de lenguaje.

Ventajas de costo

En cuanto al costo, DeepSeek-R1 ofrece una estrategia de precios muy competitiva. El precio de acceso a la API es de 0,14 USD por millón de tokens de entrada (acierto en caché) y 0,55 USD (fallo en caché), y 2,19 USD por millón de tokens de salida. Esta estrategia de precios es más atractiva que la de otros productos similares, y los usuarios la califican como un "cambio de juego". ¡El sitio web oficial y la API ya están disponibles! Visite https://chat.deepseek.com para experimentar DeepThink!

Comentarios de la comunidad y perspectivas futuras

El lanzamiento de DeepSeek-R1 ha generado un gran debate en la comunidad. Muchos usuarios han elogiado el carácter de código abierto del modelo y sus ventajas de costo, considerando que ofrece a los desarrolladores más opciones y libertad. Sin embargo, algunos usuarios también han planteado dudas sobre el tamaño de la ventana de contexto del modelo, y esperan que las futuras versiones se optimicen aún más.

El equipo de DeepSeek ha declarado que seguirá trabajando para mejorar el rendimiento y la experiencia del usuario del modelo, y planea lanzar más funciones en el futuro, incluido el análisis de datos avanzado, para satisfacer las expectativas de los usuarios en cuanto a la IAG (Inteligencia Artificial General).