Récemment, plusieurs chercheurs ont découvert une nouvelle technologie : les réseaux neuronaux physiques (PNN). Il ne s'agit pas des algorithmes numériques que nous connaissons, exécutés sur des ordinateurs, mais d'une toute nouvelle méthode de calcul intelligent basée sur des systèmes physiques.

Les PNN, comme leur nom l'indique, utilisent les propriétés des systèmes physiques pour effectuer des calculs de réseaux neuronaux. Bien qu'ils soient encore un domaine de niche dans le domaine de la recherche, ils pourraient représenter l'une des opportunités les plus sous-estimées de l'IA moderne.

Potentiel des PNN : grands modèles, faible consommation d'énergie, calcul en périphérie

Imaginez que nous puissions entraîner des modèles d'IA 1000 fois plus grands qu'aujourd'hui et effectuer des inférences locales et privées sur des appareils périphériques, tels que des smartphones ou des capteurs. Cela ressemble à de la science-fiction, mais des recherches montrent que ce n'est pas impossible.

Pour réaliser l'entraînement à grande échelle des PNN, les chercheurs explorent des méthodes basées sur la rétropropagation et des méthodes sans rétropropagation. Ces méthodes présentent chacune des avantages et des inconvénients, et aucune n'atteint encore l'échelle et les performances de l'algorithme de rétropropagation largement utilisé dans l'apprentissage profond. Mais la situation évolue rapidement, et un écosystème diversifié de techniques d'entraînement offre des pistes pour l'exploitation des PNN.

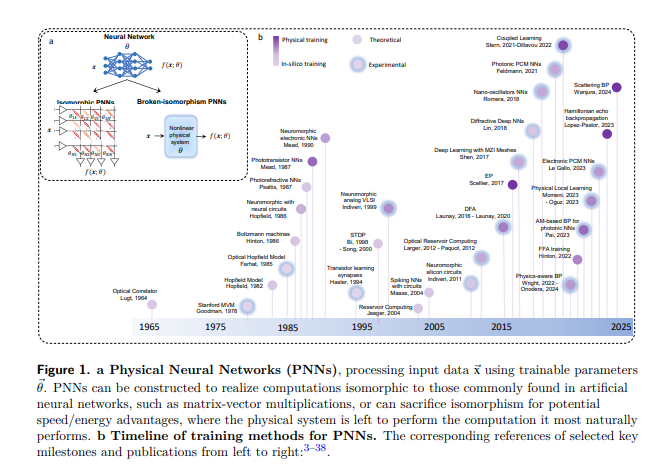

La mise en œuvre des PNN implique plusieurs domaines, notamment l'optique, l'électronique et le calcul neuromorphique. Ils peuvent effectuer des calculs tels que la multiplication matrice-vecteur de manière similaire aux réseaux neuronaux numériques, ou sacrifier cette similarité structurelle pour des avantages potentiels en termes de vitesse/énergie, en laissant le système physique effectuer le calcul le plus naturel pour lui.

L'avenir des PNN : dépasser les performances du matériel numérique

Les applications futures des PNN pourraient être très vastes, allant des grands modèles génératifs aux tâches de classification dans les capteurs intelligents. Ils devront être entraînés, mais les contraintes d'entraînement peuvent varier selon les applications. La méthode d'entraînement idéale serait indépendante du modèle, rapide, énergétiquement efficace et robuste aux variations, à la dérive et au bruit du matériel.

Bien que le développement des PNN soit plein de potentiel, il est également confronté à de nombreux défis. Comment garantir la stabilité des PNN pendant les phases d'entraînement et d'inférence ? Comment intégrer ces systèmes physiques aux infrastructures matérielles et logicielles numériques existantes ? Ce sont autant de questions qui doivent être résolues.

Adresse de l'article : https://arxiv.org/pdf/2406.03372