AI की दुनिया में, डेटा सोने की खान की तरह है, जितना अधिक और समृद्ध होगा, उतना ही चमकीला। हाल ही में, LLM360 ने एक ध्यान आकर्षित करने वाला डेटा सेट TxT360 लॉन्च किया है, जो बड़े भाषा मॉडल के प्रशिक्षण के लिए विशेष रूप से तैयार किया गया है। यह विशालकाय डेटा सेट न केवल विभिन्न उद्योगों से उच्च गुणवत्ता वाले टेक्स्ट डेटा को समाहित करता है, बल्कि एक वैश्विक स्तर पर डुप्लिकेट हटाने की प्रक्रिया से भी गुजरा है, जिसके परिणामस्वरूप 5.7 ट्रिलियन उच्च गुणवत्ता वाले टोकन एकत्रित हुए हैं, सचमुच इसे "डेटा की दुनिया का खजाना" कहा जा सकता है!

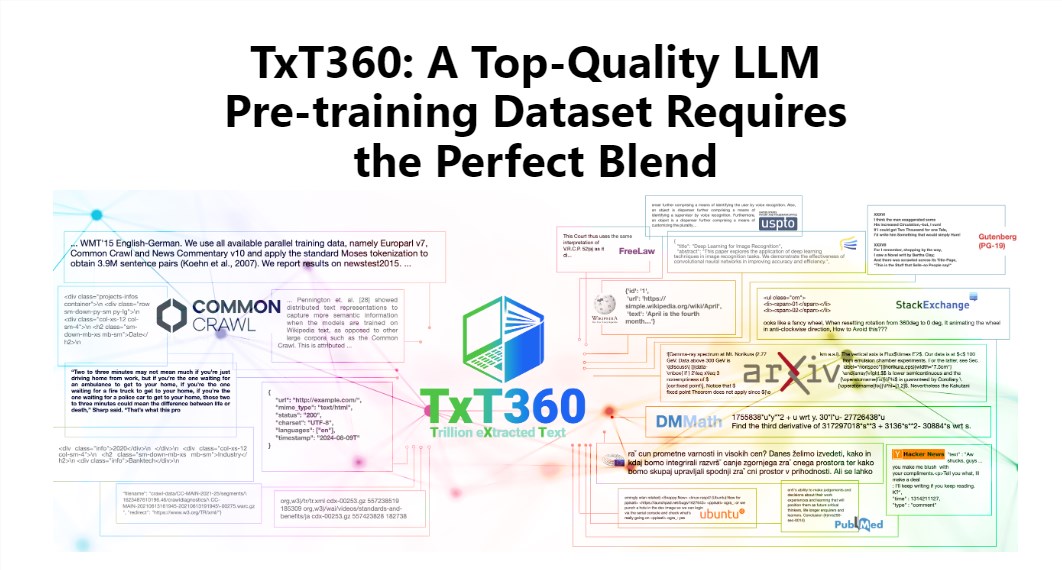

TxT360 की魅力 इसके विशाल आकार और उच्च गुणवत्ता में है, जो मौजूदा FineWeb और RedPajama जैसे डेटा सेटों को पीछे छोड़ देता है। यह डेटा सेट 99 Common Crawl स्नैपशॉट से इंटरनेट का सारांश खींचता है, और विशेष रूप से 14 उच्च गुणवत्ता वाले डेटा स्रोतों को चुना गया है, जैसे कानूनी दस्तावेज और विश्वकोश, जिससे इसकी सामग्री न केवल विविध है, बल्कि काफी विश्वसनीय भी है।

और भी दिलचस्प बात यह है कि TxT360 उपयोगकर्ताओं को "डेटा वेट एडजस्टमेंट फॉर्मूला" प्रदान करता है, जिससे आप अपनी आवश्यकताओं के अनुसार विभिन्न डेटा स्रोतों के वजन को लचीले ढंग से समायोजित कर सकते हैं। यह ऐसा है जैसे खाना बनाते समय, आप स्वाद के अनुसार विभिन्न सामग्रियों को मनचाहे तरीके से मिलाते हैं, यह सुनिश्चित करते हुए कि हर एक बाइट अविस्मरणीय स्वादिष्ट हो।

बेशक, डुप्लिकेट हटाने की तकनीक भी TxT360 की एक बड़ी विशेषता है। जटिल डुप्लिकेट हटाने की प्रक्रियाओं के माध्यम से, इस डेटा सेट ने प्रशिक्षण प्रक्रिया में डेटा के अधिशेष और जानकारी के दोहराव की समस्या को प्रभावी ढंग से हल किया है, यह सुनिश्चित करते हुए कि हर एक टोकन अद्वितीय है। साथ ही, परियोजना टीम ने नियमित अभिव्यक्ति के माध्यम से दस्तावेज़ों में व्यक्तिगत पहचान जानकारी, जैसे ईमेल और IP पते, को चतुराई से हटा दिया है, ताकि डेटा की गोपनीयता और सुरक्षा सुनिश्चित हो सके।

TxT360 का डिज़ाइन न केवल आकार पर ध्यान केंद्रित करता है, बल्कि गुणवत्ता को भी ध्यान में रखता है। यह नेटवर्क डेटा और चयनित डेटा स्रोतों के लाभों को मिलाकर, शोधकर्ताओं को डेटा के उपयोग और वितरण को सटीकता से नियंत्रित करने की अनुमति देता है, जैसे कि आपके पास डेटा के अनुपात को समायोजित करने के लिए एक जादुई रिमोट कंट्रोल हो।

प्रशिक्षण प्रभाव के मामले में, TxT360 भी पीछे नहीं है। यह सरल अपसैंपलिंग रणनीति के माध्यम से डेटा की मात्रा को बढ़ाता है, और अंततः 15 ट्रिलियन से अधिक टोकन का डेटा सेट बनाता है। एक श्रृंखला के प्रमुख मूल्यांकन मापदंडों पर, TxT360 का प्रदर्शन FineWeb से बेहतर है, विशेष रूप से MMLU और NQ जैसे क्षेत्रों में, जो इसकी उच्च सीखने की क्षमता को दर्शाता है। और कोड डेटा (जैसे Stack V2) के साथ मिलाने पर, सीखने की गति और भी स्थिर हो जाती है, और मॉडल के प्रदर्शन में स्पष्ट सुधार होता है।

विस्तृत जानकारी: https://huggingface.co/spaces/LLM360/TxT360