3 अप्रैल, 2025 की खबर: MathArena द्वारा हाल ही में जारी किए गए बड़े भाषा मॉडल की गणितीय क्षमता के मूल्यांकन के परिणामों के अनुसार, Google का Gemini-2.5-pro अद्भुत प्रदर्शन करते हुए, बिना किसी बाहरी मदद के कठिन गणितीय प्रतियोगिताओं में सबसे आगे है।

अभूतपूर्व उपलब्धि

MathArena प्लेटफ़ॉर्म पर कठोर मूल्यांकन में Gemini-2.5-pro ने 24.40% की सटीकता हासिल की है, यह उपलब्धि न केवल शीर्ष पर है, बल्कि दूसरे स्थान पर रहे DeepSeek-R1 के 4.76% से पाँच गुना अधिक है। यह अभूतपूर्व उपलब्धि दर्शाती है कि Gemini-2.5-pro ने उन्नत गणितीय तर्क क्षमता में गुणात्मक छलांग लगाई है।

कई प्रतियोगिताओं में उत्कृष्ट प्रदर्शन

विशेष रूप से उल्लेखनीय है कि Gemini-2.5-pro ने "AIME 2025 I" प्रतियोगिता परीक्षण में 93% का आश्चर्यजनक परिणाम प्राप्त किया, जो एक मान्यता प्राप्त कठिन गणितीय प्रतियोगिता है। साथ ही, इसने "USAMO 2025" में 50% का प्रदर्शन किया, जो अत्यधिक कठिन गणितीय समस्याओं को हल करने की इसकी क्षमता को दर्शाता है।

तकनीकी महत्व

MathArena मूल्यांकन की विशिष्टता इसकी कठोरता और निष्पक्षता में है, इसमें केवल मॉडल के जारी होने के बाद के गणितीय प्रतियोगिता के प्रश्नों का उपयोग करके परीक्षण किया जाता है, यह सुनिश्चित करने के लिए कि मॉडल को पूर्व-प्रशिक्षण सामग्री से कोई लाभ न मिले। इतनी कठोर परिस्थितियों में, Gemini-2.5-pro इतनी उच्च सफलता दर बनाए रखने में सक्षम है, जो Google द्वारा बड़े मॉडल की गणितीय तर्क क्षमता में एक बड़ी सफलता को दर्शाता है।

उद्योग पर प्रभाव

Gemini-2.5-pro का उत्कृष्ट प्रदर्शन न केवल उन्नत गणितीय सोच के क्षेत्र में बड़े भाषा मॉडल की विशाल क्षमता को सिद्ध करता है, बल्कि AI-सहायक शिक्षा, अनुसंधान और जटिल समस्याओं के समाधान के लिए नई संभावनाएँ भी खोलता है। यह उपलब्धि AI उद्योग में तर्क क्षमता और पेशेवर क्षेत्रों में अनुप्रयोगों के संबंध में प्रतिस्पर्धा और नवाचार को और आगे बढ़ाएगी।

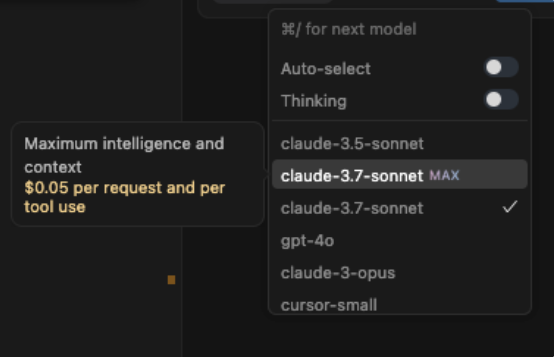

Claude-3.7-Sonnet (Think) के 3.65% और o1-pro (high) के 2.83% की सटीकता की तुलना में, Gemini-2.5-pro का अग्रणी लाभ और अधिक स्पष्ट है, जो दर्शाता है कि बड़े भाषा मॉडल की गणितीय क्षमता के विकास ने एक नए चरण में प्रवेश किया है।

डेटा स्रोत: https://matharena.ai/